다중인덱스 모델을 위한 데이터셋 증류: 저차원 구조의 효율적 인코딩

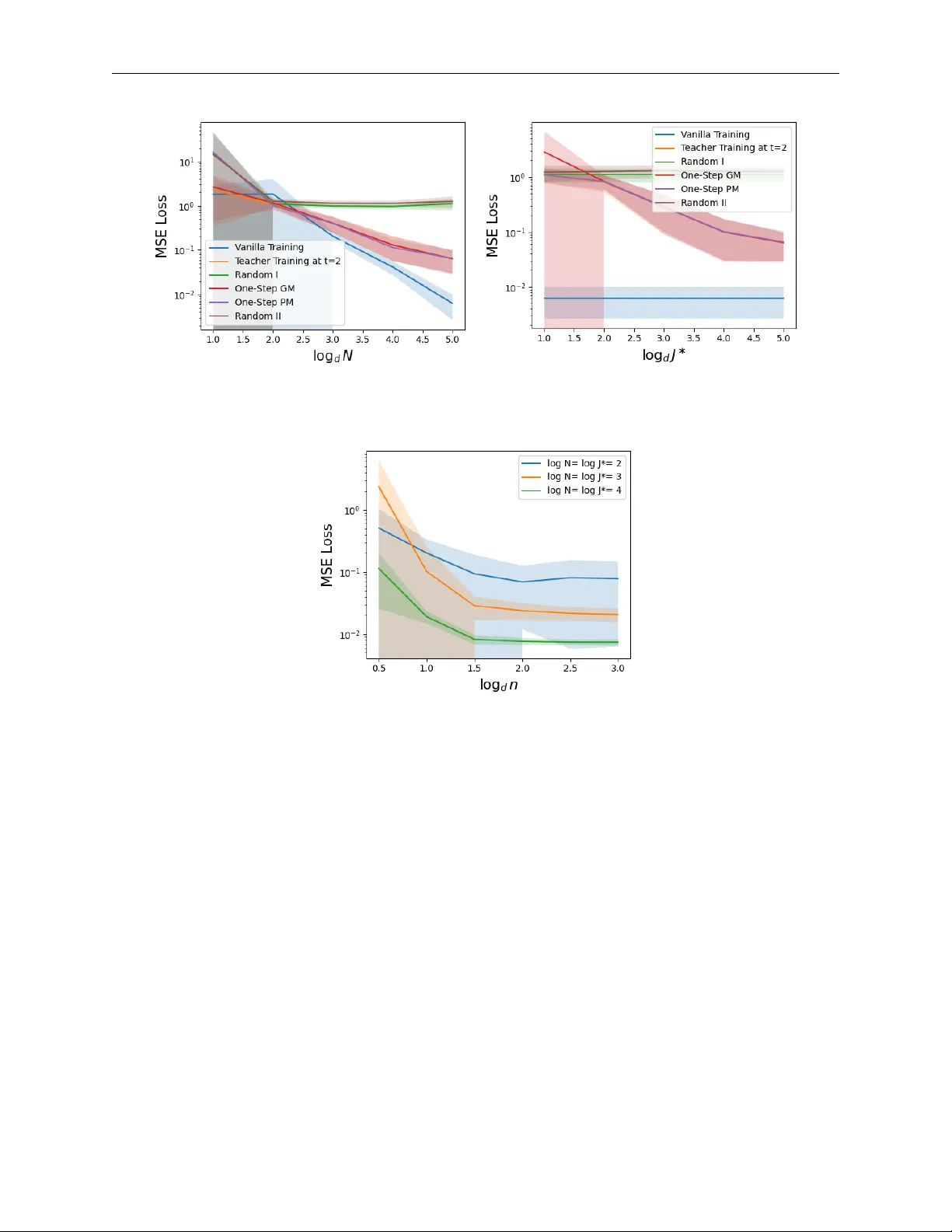

본 논문은 두 층 ReLU 신경망을 대상으로, 다중인덱스(다중선형) 구조를 갖는 비선형 회귀 문제에 대한 데이터셋 증류(DD) 이론을 전개한다. 성능 매칭(PM)과 그래디언트 매칭(GM) 두 알고리즘을 분석한 결과, 내재된 저차원( r 차원) 표현을 $\tilde\Theta(r^{2}d+L)$ 메모리 복잡도로 압축할 수 있음을 증명한다. 이는 기존 선형·커널 기반 결과보다 훨씬 높은 압축률이며, 실험을 통해 전이 학습 등 실제 응용에서도 유효함…

저자: Yuri Kinoshita, Naoki Nishikawa, Taro Toyoizumi

**1. 서론 및 배경**

데이터 규모가 급증함에 따라 학습·저장·전송 비용이 크게 늘어나고 있다. 데이터셋 증류(Dataset Distillation, DD)는 원본 데이터의 핵심 정보를 소수의 합성 데이터 포인트에 압축함으로써 이러한 비용을 감소시키는 기술이다. 기존 연구는 주로 경험적 성과에 집중했으며, 왜 소수의 합성 데이터가 원본 데이터와 동등한 학습 성능을 제공하는지에 대한 이론적 설명은 부족했다. 특히, 비선형 모델과 복잡한 태스크 구조가 증류 효율에 미치는 영향을 체계적으로 분석한 연구는 거의 없다.

**2. 연구 목표 및 기여**

본 논문은 두 층 ReLU 신경망을 대상으로, 입력 차원 d와 내재 차원 r을 갖는 다중인덱스 모델 $f^{*}(x)=\sigma^{*}(B^{\top}x)$을 학습 목표로 설정한다. 주요 기여는 다음과 같다.

- (i) 비선형 다중인덱스 모델을 명시적으로 고려한 최초의 DD 이론을 제시한다.

- (ii) 성능 매칭(PM)과 그래디언트 매칭(GM) 두 대표적인 DD 알고리즘을 분석해, 모두 동일한 메모리 복잡도 $\tilde\Theta(r^{2}d+L)$ 를 달성함을 증명한다.

- (iii) 증류 데이터가 원본 데이터와 동일한 일반화 오차를 보장함을 이론적으로 입증한다.

- (iv) 이론 결과를 전이 학습 등 실제 응용에 적용하고, 실험을 통해 압축 효율과 일반화 성능을 검증한다.

**3. 문제 설정**

- **데이터 모델**: $x_n\sim\mathcal N(0,I_d)$, $y_n = f^{*}(x_n)+\epsilon_n$, 여기서 $\epsilon_n\in\{\pm\zeta\}$는 작은 잡음이다.

- **다중인덱스 모델**: $f^{*}(x)=\sigma^{*}(B^{\top}x)$, $B\in\mathbb R^{d\times r}$는 직교($B^{\top}B=I_r$)이며, $\sigma^{*}$는 $r$‑차원 비선형 함수이다. $S^{*}=\text{span}\{\beta_1,\dots,\beta_r\}$를 주요 서브스페이스라 정의한다.

- **모델**: 두 층 ReLU 네트워크 $f_{\theta}(x)=\frac{1}{\sqrt L}\sum_{\ell=1}^{L}a_{\ell}\phi(w_{\ell}^{\top}x)$, 여기서 $\phi(z)=\max\{0,z\}$, $L$은 너비이다.

**4. 데이터셋 증류 알고리즘**

- **Performance Matching (PM)**: 합성 데이터 $D_S$를 이용해 한 번의 SGD 업데이트만으로 원본 손실을 최소화한다. 이는 $\tilde\theta^{(1)}(D_S)=\theta-\eta\nabla_{\theta}L(\theta;D_S)$ 로 정의되며, $D_S$는 $\nabla_{D_S}L(\tilde\theta^{(1)}(D_S),D_{tr})$ 를 최소화하도록 업데이트된다.

- **Gradient Matching (GM)**: 원본 학습 과정에서 얻은 그래디언트 집합 $G_{tr}$와 합성 데이터가 만든 그래디언트 $G_S(D_S)$ 사이의 코사인 유사도를 최소화한다. ReLU의 2차 미분 문제를 해결하기 위해 부드러운 대체 활성화 함수 $h$를 사용하거나, 1‑step 업데이트에 특화된 정의를 제시한다.

**5. 이론적 분석**

- **압축 한계**: 핵심 정리는 “임의 초기화와 충분히 큰 $L$에 대해, $M=O(r^{2}d+L)$ 개의 합성 샘플만으로도 원본 데이터와 동일한 최적 파라미터 $\theta^{*}$에 수렴한다”는 것이다. 여기서 $\tilde O$는 로그 항을 무시한 표기이다.

- **일반화 보장**: 증류된 데이터로 학습된 모델 $\tilde\theta$는 $\mathbb E_{(x,y)}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기