어감 인식 향상을 위한 적응형 레이어별 작업벡터 병합

본 논문은 사전 학습된 WavLM‑Large 모델에 ASR과 SER 전용 작업벡터를 레이어별 가중치로 적응적으로 결합하는 AdaLTM 프레임워크를 제안한다. 백본을 고정하고 각 층마다 학습 가능한 스케일링 파라미터를 통해 언어적 지식과 감정적 지식을 깊이‑의존적으로 조절함으로써 다중 과제 간의 최적화 충돌을 회피한다. MSP‑Podcast 데이터셋 실험에서 도메인 일치가 중요한 것을 확인하고, 레이어‑와이즈 병합이 전역 병합보다 우수함을 보였다…

저자: Chia-Yu Lee, Huang-Cheng Chou, Tzu-Quan Lin

본 논문은 음성 감정 인식(SER) 성능을 향상시키기 위해 자동 음성 인식(ASR) 지식을 효과적으로 통합하는 새로운 프레임워크인 Adaptive Layer‑wise Task Vector Merging(AdaLTM)을 제안한다. 기존 연구에서는 ASR 출력과 음향 특징을 단순히 결합하거나, 다중 과제 학습(MTL) 방식으로 하나의 백본을 공동 최적화하는 접근이 주를 이뤘다. 그러나 전자는 ASR 전사 오류에 취약하고, 후자는 ASR이 감정에 무관한 표현을 학습하려는 경향 때문에 두 과제 간의 gradient interference가 발생한다.

AdaLTM은 이러한 문제를 “가중치 공간에서의 작업벡터 병합”이라는 관점으로 전환한다. 구체적으로, 사전 학습된 WavLM‑Large 모델을 백본(W_base)으로 사용하고, 동일한 데이터셋(MSP‑Podcast)에서 두 개의 파인튜닝 모델을 만든다. 하나는 텍스트 전사에 초점을 맞춘 ASR 모델(W_ASR), 다른 하나는 감정 레이블에 초점을 맞춘 SER 모델(W_SER)이다. 두 모델의 가중치와 백본 가중치의 차이를 각각 ΔW_ASR와 ΔW_SER라는 작업벡터로 정의한다.

이후 각 트랜스포머 층(l)마다 두 작업벡터를 레이어‑와이즈 스케일링 파라미터 λ_l^ASR, λ_l^SER와 곱해 백본 가중치에 더한다. 즉,

θ_l^merged = θ_l^base + λ_l^ASR·Δθ_l^ASR + λ_l^SER·Δθ_l^SER.

λ 파라미터는 연속적인 실수값이며, 초기값 0.5로 설정해 백본의 기본 성능을 유지하면서 점진적으로 두 작업벡터의 영향을 조절한다. 이 설계는 깊이가 깊어질수록 고수준 의미 정보와 저수준 음향 정보의 중요도가 달라지는 점을 반영한다.

병합된 가중치를 이용해 24개의 트랜스포머 층에서 은닉 표현 H(l)을 추출하고, 학습 가능한 가중치 α_l로 가중합해 최종 특징 H_out을 만든다. H_out은 감정 분류 헤드에 입력되어 8가지 감정 클래스를 예측한다. 중요한 점은 백본과 작업벡터 자체는 전 과정에서 고정(frozen)된다는 것이다. 따라서 학습은 λ 파라미터, α 파라미터, 그리고 분류 헤드 파라미터에만 국한되어, ASR과 SER 사이의 gradient 충돌을 완전히 차단한다.

실험은 MSP‑Podcast(v1.12) 데이터셋을 사용해 수행했다. 데이터는 인간이 직접 전사한 텍스트와 8가지 감정 라벨을 포함한다. 비교 대상은 (1) 완전 학습 가능한 WavLM‑Large 기반 MTL, (2) 정적 초기화(0.5·ΔW) 후 전체 파라미터를 학습하는 방식, (3) AdaLTM의 다양한 변형이다. 주요 평가지표는 Unweighted Average Recall(UAR), Precision, Macro‑F1이다.

결과는 다음과 같다. 전통적인 MTL은 백본을 공동 최적화하면서 UAR이 29.6%에 머물렀으며, 이는 “seesaw effect”라 불리는 과제 간 성능 저하 현상을 보여준다. 반면 AdaLTM은 백본을 고정하고 레이어‑와이즈 병합만 수행함으로써 UAR 38.6%를 달성, MTL 대비 8% 이상의 절대 향상을 기록했다. 파라미터 업데이트 비율도 전체 파라미터의 1% 미만에 불과해 효율성도 뛰어나다.

작업벡터 자체의 효과를 검증하기 위해 ASR‑only, SER‑only, 그리고 Dual‑vector(두 벡터 동시) 설정을 비교했다. SER‑only가 가장 높은 UAR 39.09%를 보였으며, ASR‑only는 37.57%로 언어 정보가 일정 부분 기여함을 확인했다. Dual‑vector는 38.94%로 SER‑only보다 약간 낮지만, 두 지식이 동시에 활용될 수 있음을 증명한다. 이는 모델 용량 한계 내에서 두 작업벡터가 일정 정도 경쟁한다는 해석을 가능하게 한다.

또한 도메인 일치의 중요성을 확인하기 위해 LibriSpeech로 파인튜닝한 외부 ASR 모델을 사용했다. 이 경우 UAR가 38.68%로 감소, 인‑도메인 ASR 벡터가 더 유리함을 보여준다.

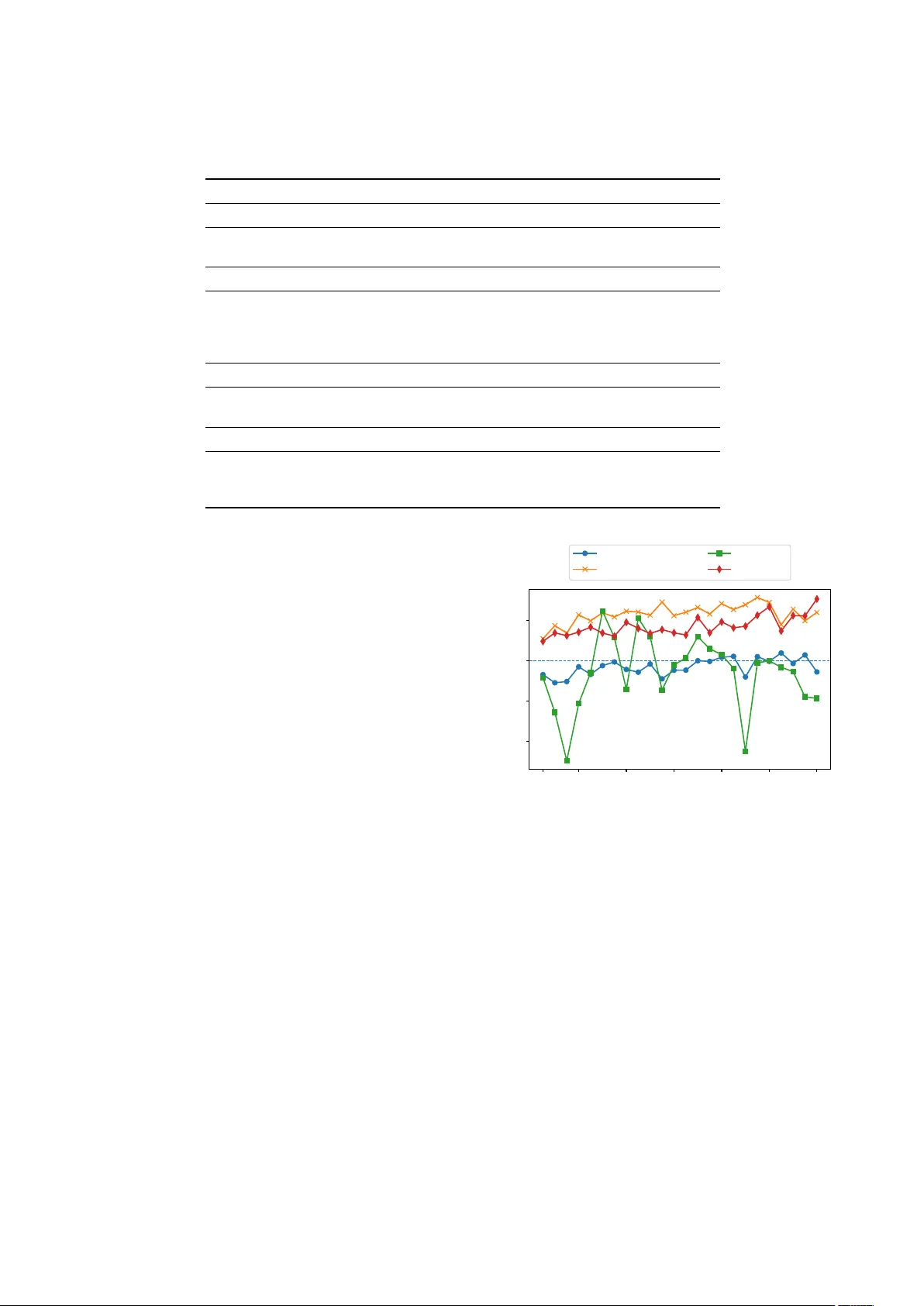

마지막으로 병합 방식의 granularity를 비교했다. (a) Static Global(λ=0.5 고정), (b) Adaptive Global(단일 λ 학습), (c) Adaptive Layer‑wise(제안 방식)이다. Layer‑wise 방식이 가장 높은 UAR 38.94%와 Macro‑F1 35.20%를 기록, 층별 특성을 반영한 스케일링이 효과적임을 입증한다. 시각화된 λ 값은 상위 층에서 ASR 벡터 비중이 높고, 하위 층에서는 SER 벡터 비중이 높아지는 패턴을 보였다.

종합하면, AdaLTM은 (1) 다중 과제 간 최적화 충돌을 완전히 회피, (2) 작업벡터를 레이어‑와이즈로 적응적으로 결합해 언어와 감정 정보를 깊이‑의존적으로 통합, (3) 도메인 일치가 성능에 큰 영향을 미침, (4) 전체 파라미터 대비 매우 적은 양만 학습해 효율적인 적응을 가능하게 한다는 장점을 가진다. 이러한 접근은 대규모 사전 학습 음성 모델을 다양한 도메인·과제에 빠르게 적용하고자 하는 실무 및 연구 현장에서 유용하게 활용될 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기