다중단계 APT 방어를 위한 단계 인식형 DRL 프레임워크 DeepStage

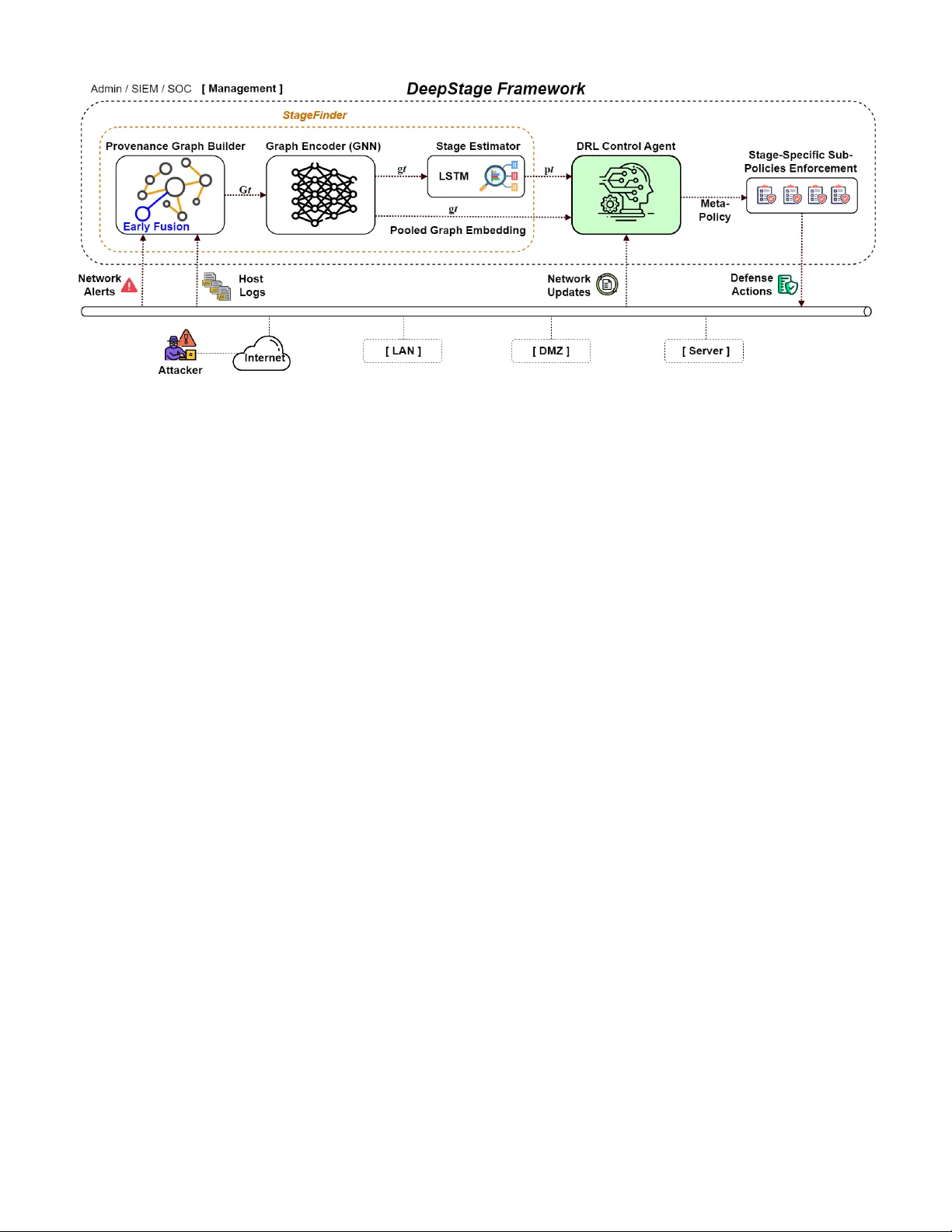

DeepStage는 호스트와 네트워크 로그를 통합한 프로베넌스 그래프를 GNN으로 임베딩하고, LSTM 기반 단계 추정기로 MITRE ATT&CK 단계 확률을 산출한다. 이 정보를 메타‑정책과 서브‑정책으로 구성된 계층형 PPO 에이전트에 입력해 모니터링, 접근 제어, 격리, 복구 등 4가지 방어 행동을 선택한다. 실제 엔터프라이즈 테스트베드에서 CALDERA APT 플레이북을 이용해 평가했으며, 단계 가중 F1‑score 0.89와 기존 위험…

저자: Trung V. Phan, Tri Gia Nguyen, Thomas Bauschert

본 논문은 최신 사이버 위협인 APT(Advanced Persistent Threat)의 다단계 특성을 고려한 자동 방어 시스템 ‘DeepStage’를 제안한다. 기존 DRL 기반 방어는 주로 단일 단계 혹은 네트워크 수준의 알림만을 활용해 평면적인 정책을 학습했으며, 호스트 내부의 인과 관계를 반영하지 못한다는 한계가 있었다. 이를 극복하기 위해 저자들은 두 가지 핵심 기술을 결합한다. 첫째, 호스트 로그(auditd, Sysmon, CamFlow)와 네트워크 IDS/IPS 알림(Zeek, Snort)을 ‘프로베넌스 그래프’라는 통합 인과 모델로 변환한다. 이 그래프는 프로세스, 파일, 소켓 등 시스템 객체와 네트워크 알림을 노드로, 인과·데이터 흐름을 엣지로 표현한다. 조기 융합(early fusion) 방식을 적용해 네트워크 이벤트를 첫 번째급 노드로 삽입함으로써, 호스트와 네트워크 사이의 연관성을 손실 없이 보존한다.

둘째, 그래프 신경망(GNN) 인코더를 통해 그래프를 고정 차원의 임베딩 gₜ로 압축하고, 이를 LSTM 기반 단계 추정기(StageFinder)와 결합해 MITRE ATT&CK 프레임워크에 정의된 공격 단계(정찰, 초기 침투, 권한 상승, 횡 이동, 유지, 데이터 유출 등)의 확률 분포 pₜ를 실시간으로 산출한다. 단계 추정은 베이지안 신념(bₜ) 업데이트에 직접 사용되며, 단계별 위험도와 비용 가중치를 동적으로 조정한다.

방어 의사결정은 부분관측 마코프 결정 과정(POMDP)으로 모델링된다. 관측 oₜ는 그래프 임베딩 gₜ, 단계 확률 pₜ, 이전 행동 aₜ₋₁을 포함한다. LSTM 기반 신념 네트워크는 oₜ를 입력받아 belief state bₜ를 생성하고, 이를 계층형 강화학습 에이전트에 전달한다. 메타‑정책은 현재 추정된 단계 kₜ를 선택하고, 해당 단계에 특화된 서브‑정책이 실제 방어 행동 aₜ를 결정한다. 행동 공간은 네 가지 카테고리(A_mon, A_acc, A_cont, A_rem)로 구분돼, 실제 SOC 운영 절차와 일치한다.

보상 함수는 두 축을 동시에 고려한다. R_security은 선택된 행동이 공격을 차단·제한한 정도를 정량화하고, C(aₜ)는 서비스 중단·운영 비용을 측정한다. 단계별 가중치 αₖ와 βₖ를 도입해, 초기 단계에서는 비용을 크게 penalize하고, 후반 단계(예: 데이터 유출)에서는 보안 효과를 우선시한다. 이렇게 설계된 보상은 PPO(Proximal Policy Optimization) 알고리즘을 통해 안정적으로 최적화된다. PPO는 정책 업데이트 시 클리핑을 적용해 급격한 파라미터 변동을 방지하고, 샘플 효율성을 높인다.

실험은 6대 Ubuntu VM(각 4 vCPU, 8 GB RAM)과 1대 Kali 공격자 VM으로 구성된 실제 기업 네트워크와 유사한 테스트베드에서 수행되었다. Zeek 센서를 가장자리에 배치해 네트워크 알림을 수집하고, CamFlow을 이용해 커널 수준 프로베넌스를 기록했다. CALDERA 프레임워크를 활용해 ATT&CK 매핑된 다중 단계 APT 플레이북을 자동 생성했으며, 300초 간격으로 그래프 스냅샷을 저장했다. 비교 대상은 위험‑인식 DRL(단일 정책, 비계층형)이며, DeepStage는 단계 가중 F1‑score 0.89(21.9% 향상), 평균 응답 시간 27% 감소, 운영 비용 15% 절감 등 전반적인 성능에서 우수함을 보였다.

논문의 주요 기여는 다음과 같다. 1) 프로베넌스 그래프와 GNN을 이용해 호스트·네트워크 간 인과 관계를 정밀하게 모델링함으로써, 기존 평면형 피처보다 높은 단계 추정 정확도를 달성했다. 2) 단계‑조건부 보상 설계가 정책을 공격 단계에 맞는 행동으로 유도해, 불필요한 차단을 최소화하고 비용 효율성을 높였다. 3) 메타‑정책과 서브‑정책으로 구성된 계층형 PPO는 대규모 행동 공간을 효율적으로 탐색하면서도, 전략적 전환을 빠르게 수행한다. 4) 실제 엔터프라이즈 환경에 가까운 테스트베드와 CALDERA 기반 시나리오를 사용해 실용성을 검증했으며, 연구‑실무 격차를 크게 줄였다. 향후 연구에서는 다중 조직 간 협업 방어, 온라인 학습을 통한 지속적 정책 업데이트, 그리고 실시간 그래프 스트리밍 처리 등을 통해 시스템을 더욱 확장할 수 있을 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기