프레젠테이션 자동생성을 위한 역스펙 보상 학습

본 논문은 LLM 에이전트가 연구·계획·슬라이드 생성·수정을 순차적으로 수행하도록 설계된 OpenEnv 호환 강화학습 환경을 제시한다. 14개의 도구와 5단계 워크플로우를 활용해 HTML 및 PPTX 형식의 전문 프레젠테이션을 자동으로 만들며, 구조·렌더링·미학·내용·역스펙 등 6가지 품질 차원을 결합한 다중 보상 체계를 도입한다. 특히 역스펙 보상은 생성된 슬라이드만으로 원래 브리프를 복원하도록 LLM 을 재활용해 전체적인 목적 전달력을 평가…

저자: Karthik Ragunath An, a Kumar, Subrahmanyam Arunachalam

프레젠테이션 자동생성은 내용 구성, 시각 디자인, 청중 맞춤형 커뮤니케이션 등 복합적인 요구를 동시에 만족시켜야 하는 어려운 과제이다. 기존 LLM 기반 자동화는 텍스트 생성에 강점이 있지만, 구조적 일관성, 디자인 품질, 도구 연계 등 전반적인 워크플로우를 포괄적으로 다루지는 못했다. 이를 해결하고자 저자들은 OpenEnv와 호환되는 강화학습 환경을 설계하고, 14개의 도구를 5개의 작업 단계(연구, 계획, 생성, 정제, 최종화)로 조직하였다. 각 단계는 JSON 형태의 툴 호출을 통해 에이전트가 직접 제어하며, 연구 단계에서는 웹 검색과 URL 가져오기, 계획 단계에서는 아웃라인 생성·수정, 디자인 단계에서는 슬라이드 생성·편집·테마 설정, 구조 단계에서는 슬라이드 삽입·삭제·재배열·복제, 메타 단계에서는 전체 검토·최종화를 수행한다.

핵심 기여는 다중 보상 체계이다. 구조 검증(code_rules)에서는 제목 존재, 섹션 수, 단어 수, 비어 있지 않은 섹션 등을 정량화하고, 렌더링 품질(render_quality)에서는 슬라이드 수 대비 목표 수, 실제 렌더링 성공 여부, HTML 요소 존재 여부를 평가한다. 미학 평가는 LLM‑as‑judge(Claude Opus 4.6)를 활용해 HTML 구조와 렌더링된 PNG 이미지 각각에 대해 레이아웃, 색상·타이포그래피, 전문성 등을 0~1 점수로 매긴다. 내용 품질(content_quality)은 주제 관련성, 사실적 근거, 고유성, 내러티브 흐름을 가중치별로 측정한다. 가장 혁신적인 역스펙 보상(spec_reconstruction)은 생성된 슬라이드만을 입력으로 원래 브리프(주제, 청중, 슬라이드 수, 핵심 테마)를 복원하도록 LLM을 프롬프트하고, 복원 정확도를 토픽, 청중, 슬라이드 수, 테마 커버리지에 따라 가중합한다. 이 보상은 프레젠테이션이 목적을 얼마나 명확히 전달했는지를 전체적인 지표로 제공한다.

보상 신호는 단계별 밀도 보상(step reward)으로 설계돼, 각 행동 직후 품질 점수 변화량을 즉시 피드백한다. 이는 잠재 기반 보상 shaping 이론에 기반해 최적 정책을 보존하면서 학습 효율을 크게 향상시킨다. 또한 행동 성공·실패에 대한 작은 보너스·패널티를 부여해 탐색을 유도한다. 이러한 설계는 20~35턴에 걸친 긴 에피소드에서도 신용 할당 문제를 완화한다.

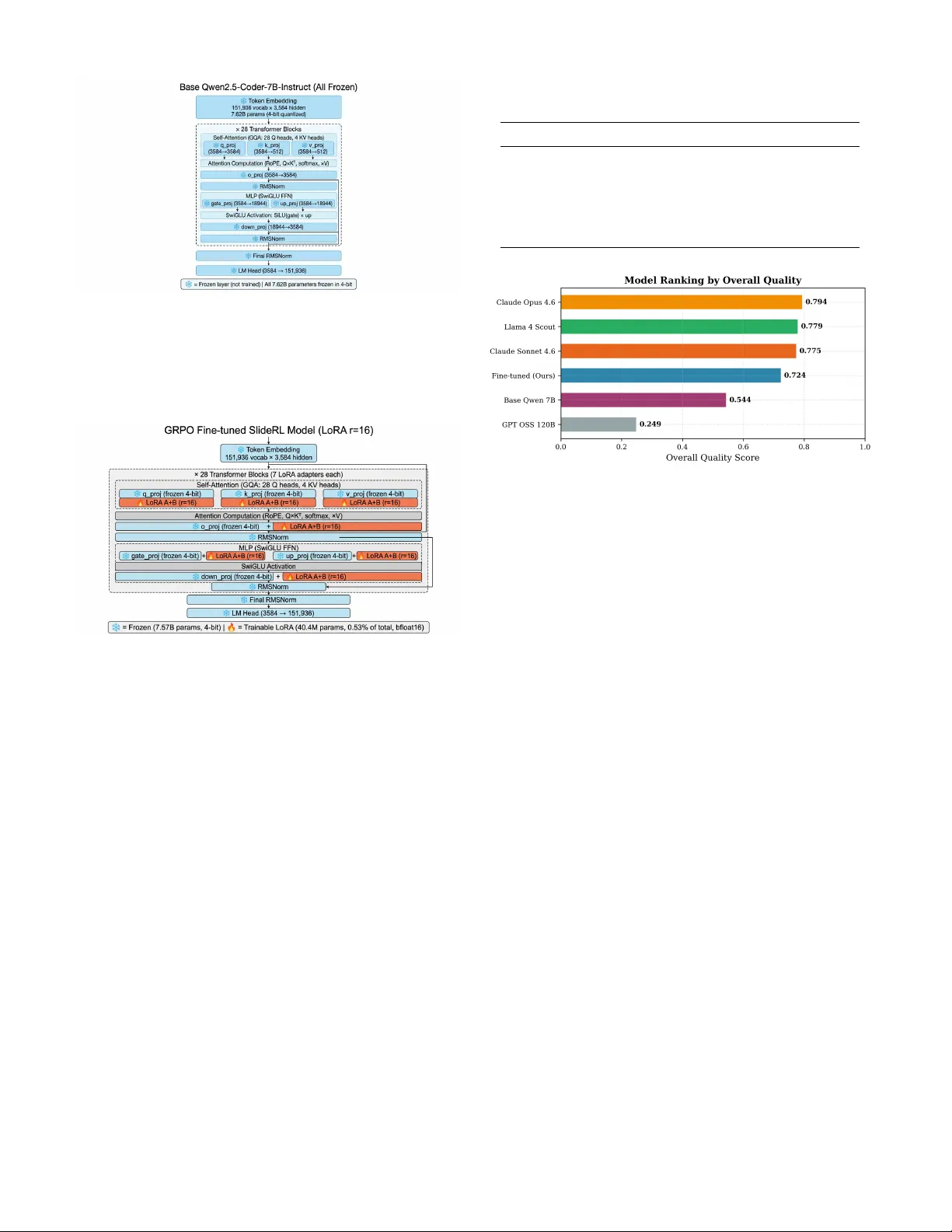

모델 학습에는 Qwen2.5‑Coder‑7B를 선택하고, GRPO(Gradient‑Reward‑Policy‑Optimization) 방식을 적용해 파라미터의 0.5%만 LoRA 형태로 미세조정했다. 전문가 트래젝터리는 Claude Opus 4.6을 사용해 48개의 비즈니스 브리프에 대해 완전한 에피소드를 생성했으며, 이를 기반으로 단계별 보상과 행동 로그를 수집했다. 실험에서는 동일한 48개 브리프에 대해 Claude Opus 4.6, Claude Sonnet 4.6, Llama 4 Scout, GPT‑OSS 120B, 기본 Qwen 7B 등 총 6개 모델을 비교했다. 결과는 미세조정된 7B 모델이 Claude Opus 4.6 대비 91.2%의 품질을 달성하고, 기본 Qwen 7B 대비 33.1% 향상된 점수를 기록했다. 특히 파라미터 규모보다는 도구 사용 준수와 명령어 이행 정도가 성능을 좌우한다는 결론을 도출했다.

데이터 측면에서 저자들은 288개의 멀티턴 롤아웃(48 브리프 × 6 모델)을 포함하는 SlideRL 데이터셋을 공개했다. 각 트래젝터리는 툴 호출, 환경 관측, 단계별 보상, 최종 품질 점수를 포함해 재현 및 확장 연구에 활용 가능하도록 설계되었다. 코드와 환경 구현도 GitHub에 공개돼, 연구자들이 동일한 OpenEnv 기반 환경에서 새로운 보상 설계나 정책 학습을 손쉽게 진행할 수 있다.

결론적으로, 이 논문은 프레젠테이션 자동생성을 강화학습과 LLM‑tool 연계로 체계화한 최초 사례이며, 역스펙 보상이라는 새로운 평가 메커니즘을 도입해 전체적인 목적 전달력을 정량화한다. 다중 보상과 밀도 보상 설계는 복합적인 생성 작업에서 신용 할당 문제를 해결하고, 파라미터 효율적인 미세조정이 대형 모델에 필적하는 성능을 낼 수 있음을 실증한다. 향후 연구는 더 다양한 디자인 도구, 사용자 피드백 기반 보상, 그리고 멀티모달(텍스트·이미지·음성) 프레젠테이션 생성으로 확장될 여지가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기