답변 조건부 반증 검색을 활용한 추론 시 지식 수리

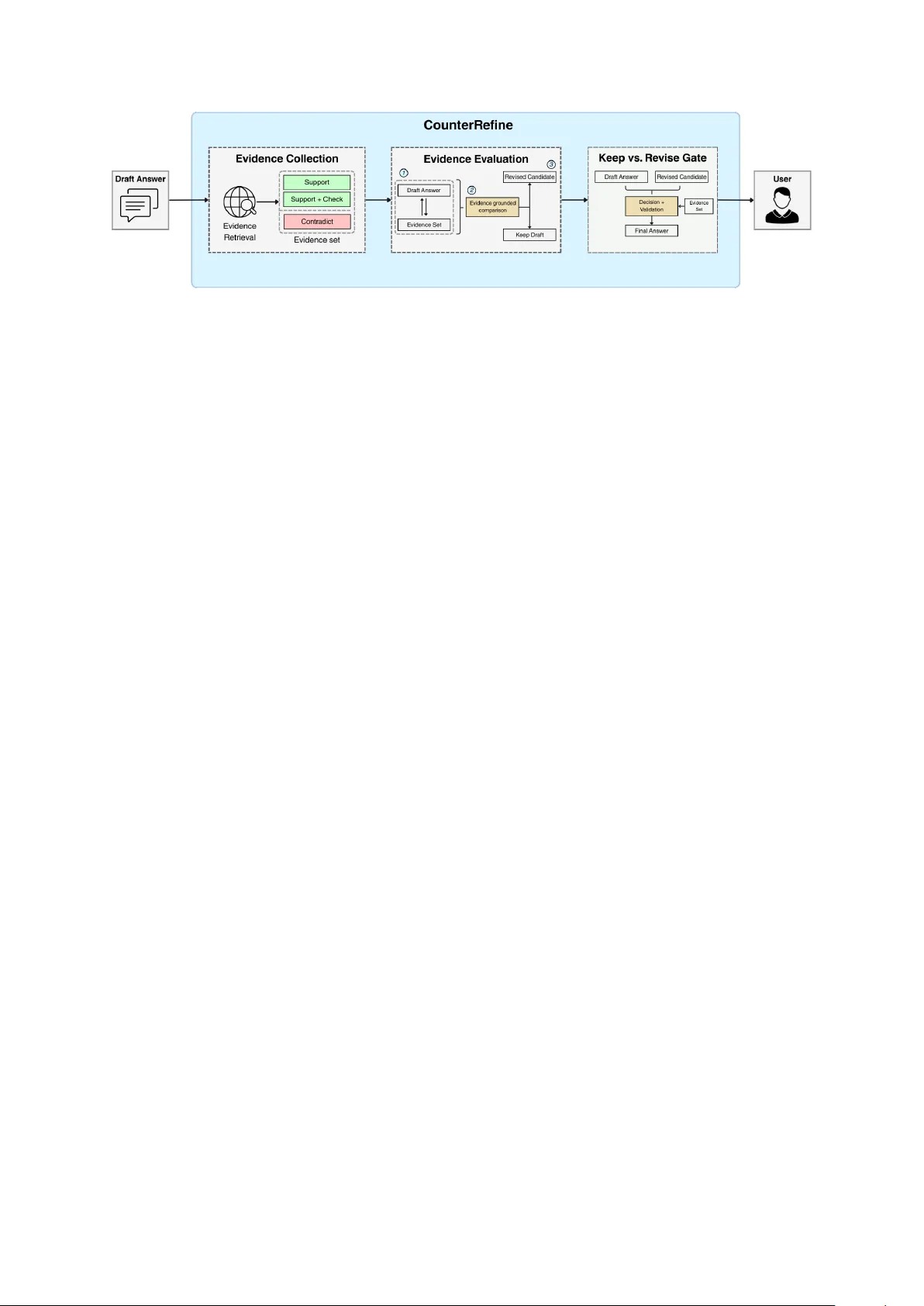

CounterRefine은 최초 답안을 만든 뒤, 그 답안을 조건으로 추가 검색을 수행해 지지·반증 증거를 모은다. 검증된 증거가 기존 답안을 약화시키면 “REVISE”를, 그렇지 않으면 “KEEP”을 선택하고, 수정안은 정형화된 검증 절차를 통과해야만 최종 답으로 채택된다. SimpleQA 전체 테스트에서 기존 RAG 기반 모델 대비 정확도가 5.8%p 상승했으며, HotpotQA에서도 전이 효과를 보였다.

저자: Tianyi Huang, Ying Kai Deng

본 논문은 사실 기반 질문응답(Factual QA) 시스템이 종종 “커밋 오류”(commitment error)라 불리는 현상에 빠진다는 점을 지적한다. 즉, 시스템이 질문과 관련된 문서를 성공적으로 검색했음에도 불구하고, 검색된 증거를 바탕으로 만든 초안 답안이 실제 정답과 일치하지 않는 경우이다. 이러한 오류는 특히 짧은 형태의 정답을 요구하는 SimpleQA와 같은 벤치마크에서 치명적이며, 연도, 인물, 수치 등 작은 차이만으로도 정답 여부가 완전히 달라진다. 기존의 Retrieval‑Augmented Generation(RAG) 파이프라인은 질문‑문서 매칭에 초점을 맞추어 초안 답안을 생성하고, 추가적인 검증 없이 이를 최종 출력한다. 따라서 “정답을 찾는 과정”과 “정답을 검증하는 과정”이 분리되지 않아, 초안 답안이 잘못된 경우 이를 바로잡을 메커니즘이 부재하다.

CounterRefine은 이러한 문제를 해결하기 위해 두 단계의 경량화된 후처리 레이어를 제안한다. 첫 번째 단계는 기존 RAG와 동일하게 질문에 대해 상위 k 개의 웹 스니펫을 검색하고, 짧은 정답을 생성한다. 여기서 “짧은 정답”은 길이와 형식이 제한된 문자열이며, 모델에게는 힌트 없이 직접 답을 제시하도록 강제한다. 두 번째 단계는 초안 답안을 조건으로 추가 검색을 수행한다. 질문 유형을 사전 정의된 카테고리(Who, Where, When, Year, Number 등)와 매칭시켜, “질문 + ‘답안’” 혹은 “‘답안’만”을 새로운 쿼리로 만든다. 이렇게 생성된 쿼리 집합 Q(q, a₀)는 각각 최대 kᵣ 개의 스니펫을 다시 검색하고, 기존 스니펫과 병합·중복 제거하여 R₁을 만든다. 이 단계의 핵심 아이디어는 “답안을 검증하기 위한 증거를 직접 끌어오는” 것이다. 예를 들어, 초안 답안이 “1999년”이라고 하면 “1999년”이라는 키워드가 포함된 문서를 검색함으로써 해당 연도가 맞는지 바로 확인할 수 있다.

R₁이 준비되면, 모델은 질문, 초안 답안, 그리고 R₁ 전체를 입력받아 세 가지 필드를 출력한다: DECISION(KEEP/REVISE), ANSWER(새로운 짧은 답), EVIDENCE(증거 스니펫 혹은 NONE). DECISION이 KEEP이면 초안 답안을 그대로 사용하고, REVISE이면 제시된 새로운 답안을 검증 단계로 넘긴다. 검증기는 6가지 규칙을 적용한다. 첫째, 답안이 비어 있거나 초안과 동일하면 거부한다. 둘째, Yes/No 질문에 대해 “yes” 혹은 “no”가 아닌 다른 형태는 거부한다. 셋째, 엔터티 질문에 대해 지나치게 긴 구절이나 서술형 문장은 거부한다. 넷째, 날짜·숫자 질문에 명시적 마커가 없으면 거부한다. 다섯째, 증거 스니펫이 제공되지 않으면 거부한다. 여섯째, 답안과 증거 간 어휘 겹침이 충분히 강하지 않으면 거부한다. 이러한 규칙을 모두 통과한 경우에만 답안을 정규화(canonicalization)한다. 정규화 과정은 질문 유형에 따라 연도는 4자리 숫자만 추출하고, 수치는 소수점 이하를 정리하며, 위치명은 전치사를 제거하는 등 형태를 일관되게 만든다. 최종 출력은 검증을 통과한 경우 수정된 답안, 그렇지 않으면 원래 초안 답안이다.

실험은 두 가지 주요 벤치마크에서 수행되었다. 첫 번째는 4,326개의 질문으로 구성된 SimpleQA이며, 공식 평가 스크립트를 사용해 정확도(Correct Rate)와 F1 점수를 측정했다. 두 번째는 HotpotQA의 distractor development set에서 100문제와 300문제 샘플을 추출해 전이 성능을 평가했다. 백본 모델로는 Claude Sonnet 4.6과 GPT‑5를 사용했으며, 검색 엔진은 OpenAI 웹 검색 API를 활용했다. 결과는 일관되게 CounterRefine이 기존 RAG 대비 성능을 향상시켰음을 보여준다. SimpleQA 전체에서는 Claude 4.6 기준 정확도가 63.7%→67.7%(+4.0p), F1이 64.1%→68.1%(+4.0p)로 상승했으며, GPT‑5에서는 정확도가 67.3%→73.1%(+5.8p), F1이 58.6%→72.1%(+13.5p)로 크게 개선되었다. HotpotQA에서도 EM이 5~4%p, F1이 1~3%p 상승했다. 특히 CounterRefine이 전체 예시 중 약 5.6%만을 수정했음에도 불구하고, 수정된 사례 중 180건이 정답으로 전환되고 8건만이 오히려 틀려서, 수정 비율 대비 효과가 매우 높았다(22.5:1). 오류 분석에서는 성공 사례가 주로 엔터티, 연도, 수치와 같은 정확한 값 교정에 해당했으며, 남은 실패는 관계 혼동이나 이벤트 시점 오류 등 복합적인 추론이 필요한 경우였다.

논문의 기여는 세 가지로 정리된다. (1) 답안‑조건부 반증 검색을 “KEEP/REVISE” 레이어로 공식화함으로써, 기존 RAG 파이프라인에 최소한의 비용으로 신뢰성 향상 메커니즘을 추가했다. (2) SimpleQA와 HotpotQA 두 벤치마크에서 백본 모델에 구애받지 않고 일관된 성능 향상을 입증했다. (3) 정형화된 검증기와 정규화 과정을 통해 모델이 제시하는 수정안을 엄격히 필터링함으로써, 무분별한 수정으로 인한 성능 저하를 방지했다. 향후 연구에서는 다중 단계의 반증 검색, 더 복잡한 증거 통합 방법, 그리고 다른 언어·도메인에 대한 전이 가능성을 탐색할 여지가 있다. CounterRefine은 “답안 → 증거 → 답안” 순환을 통해 추론 시점에서 지식 수리를 가능하게 하는 실용적인 접근법으로, 사실 기반 QA 시스템의 신뢰성을 크게 높일 수 있는 방향을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기