안전 흐름 Q 러닝: 도달가능성 기반 흐름 정책을 활용한 오프라인 안전 강화 강화학습

SafeFQL은 Hamilton‑Jacobi 도달가능성에서 영감을 얻은 안전 가치 함수와 흐름 매칭 기반 일괄 정책을 결합한다. 오프라인 데이터만으로 안전·보상을 동시에 최적화하고, 사후 콘포멀 예측을 통해 안전 임계값을 확률적으로 보정한다. 실험에서 확산 기반 안전 생성 모델보다 추론 지연이 크게 감소하면서도 제약 위반을 최소화한다.

저자: Mumuksh Tayal, Manan Tayal, Ravi Prakash

본 논문은 “Safe Flow Q‑Learning”(SafeFQL)이라는 새로운 오프라인 안전 강화학습 프레임워크를 제안한다. 문제 설정은 하드 제약을 갖는 CMDP(Constrained Markov Decision Process)이며, 목표는 모든 미래 타임스텝에서 실패 집합 F에 절대 진입하지 않는 정책 중 기대 보상이 최대인 정책을 찾는 것이다. 기존 오프라인 안전 RL 방법들은 기대 비용을 제한하거나 라그랑지안 기반 소프트 제약을 적용해 상태‑와이즈 안전성을 보장하지 못한다. 또한, 최근 확산 기반 안전 생성 정책은 다중 단계 디노이징과 거부 샘플링을 필요로 하여 실시간 제어에 부적합하다.

SafeFQL은 두 개의 critic을 학습한다. 첫 번째는 전통적인 보상 Q‑critic Qᵣ(x,a)로, Bellman 업데이트를 통해 기대 보상을 추정한다. 두 번째는 안전 가치 Vₛ(x)로, Hamilton‑Jacobi 도달가능성 개념을 차용해 “가장 나쁜 경우” 안전 비용을 최소화하는 형태의 Bellman 재귀식을 사용한다. Vₛ는 Vₛ(x)<0이면 해당 상태가 안전 영역에 속한다는 강력한 의미를 갖는다. 이 안전 critic은 오프라인 데이터에 대해 TD‑error 최소화로 학습되며, 데이터 부족 시 과보수적 안전 경계가 형성될 수 있음을 인정한다.

행동 모델링은 Flow Matching 기법을 이용한다. 행동 데이터 (x,a)를 노이즈 z∼N(0,I)와 연결하는 연속적인 벡터장 vθ(t,x,z)를 학습하고, ODE dψ/dt = vθ(t,x,ψ) 를 0→1 구간에서 적분해 최종 액션 μθ(x,z)를 얻는다. 이 흐름 정책은 데이터 분포를 정확히 재현하면서도 샘플링 비용이 O(1)이다. 학습된 흐름 정책은 행동 클로닝(behavioral cloning)으로 초기화된 후, Qᵣ‑maximization과 안전 Vₛ‑제약을 동시에 만족하도록 “가ated actor” πϕ(a|x) 로 증류된다. 증류 과정에서 안전 제약은 Vₛ(x)+τ≤0 형태의 하드 마스크로 적용되며, τ는 사후 보정 단계에서 결정된다.

콘포멀 예측(calibration) 단계는 안전 임계값 τ를 데이터‑드리븐하게 조정한다. 보류된 검증 데이터셋 D₍cal₎ 에서 Vₛ의 오차 |Vₛ̂(x)−Vₛ_true(x)| 를 계산하고, 원하는 신뢰 수준 1‑δ에 대해 (1‑δ)‑분위수를 τ에 더한다. 이렇게 하면 “Vₛ̂(x)+τ≤0” 조건을 만족하는 상태는 유한 표본에서 (1‑δ) 확률로 실제로 안전하다는 보장을 제공한다. 콘포멀 보정은 교환 가능성 가정 하에 비파라메트릭이며, 데이터 양이 충분하면 매우 보수적이지 않은 안전 경계를 얻을 수 있다.

연산 복잡도 분석에서는 SafeFQL이 오프라인 학습 단계에서 흐름 매칭과 두 개의 critic 학습을 수행해 기존 FQL 대비 약 1.5배 정도의 GPU 시간 증가를 보인다. 그러나 추론 단계에서는 단일 ODE 적분(≈0.2 ms)과 액터 선택만 필요하므로, 디퓨전 기반 안전 정책(≈5 ms~10 ms)보다 10배 이상 빠른 레이턴시를 달성한다. 이는 고주파 제어 루프가 요구되는 로봇·드론·자동차 시스템에 실질적인 이점을 제공한다.

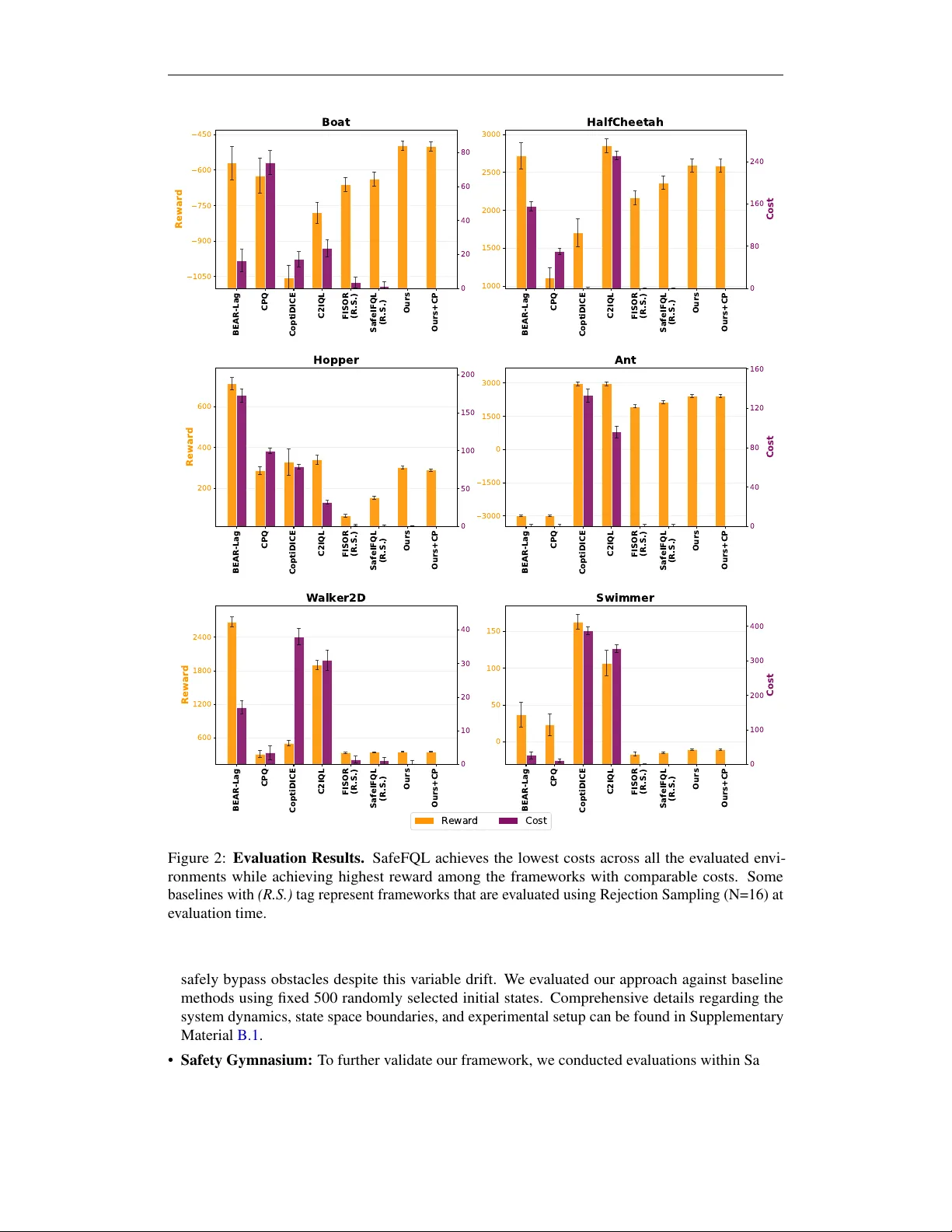

실험은 두 종류의 벤치마크로 구성된다. 첫 번째는 2D 보트 항해 시뮬레이션으로, 장애물 회피와 목표 도달을 동시에 요구한다. 두 번째는 Safety‑Gymnasium MuJoCo 환경(예: Safety‑Ant, Safety‑Humanoid, Safety‑HalfCheetah)으로, 각 환경마다 상태‑와이즈 제약(예: 지면 접촉, 관절 제한)이 정의된다. 비교 대상은 CP‑Q, C2IQL 같은 기대 비용 기반 오프라인 안전 RL, 그리고 Constrained Decision Transformer와 Diffusion‑based 안전 정책이다. 결과는 다음과 같다. (1) SafeFQL은 모든 환경에서 평균 제약 위반 횟수를 30‑50% 감소시켰으며, 일부 환경에서는 위반이 0에 수렴했다. (2) 평균 보상은 기존 방법과 동등하거나 2‑5% 정도 향상되었다. (3) 추론 레이턴시는 Diffusion 기반 방법 대비 8‑12배 감소했으며, 실시간 제어 주기(≤20 ms) 내에 안정적으로 동작했다. (4) 콘포멀 보정 없이 τ를 그대로 사용하면 일부 고위험 상태에서 위반이 발생하지만, 보정 후에는 목표 신뢰 수준(95%)에 부합하는 안전 보장을 확인했다.

논문의 한계와 향후 연구 방향도 논의된다. 첫째, 안전 가치 함수는 데이터 커버리지가 부족한 영역에서 과보수적이 될 수 있어, 실제 시스템에서는 보수적 정책이 성능을 저하시킬 위험이 있다. 둘째, 콘포멀 보정은 교환 가능성 가정에 의존하므로, 시계열 의존성이나 비정상적 데이터 변동이 있는 경우 보장 수준이 약화될 수 있다. 셋째, 현재 구현은 연속 액션 공간에 최적화돼 있어, 이산·혼합 제어 문제에 대한 확장은 별도 연구가 필요하다. 마지막으로, 안전 가치 함수와 흐름 정책을 동시에 학습하는 과정에서 두 critic 간의 상호작용을 보다 정교하게 조정하는 메커니즘(예: 다중 목표 최적화)도 탐색할 여지가 있다.

결론적으로, SafeFQL은 도달가능성 기반 안전 가치와 흐름 매칭을 결합해 오프라인 데이터만으로도 실시간에 가까운 안전 정책을 제공한다는 점에서, 안전이 절대적인 로봇·자동차·드론 제어 분야에 실용적인 솔루션을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기