베이즈 신경망의 대편차와 특징 학습 고정 커널을 넘어

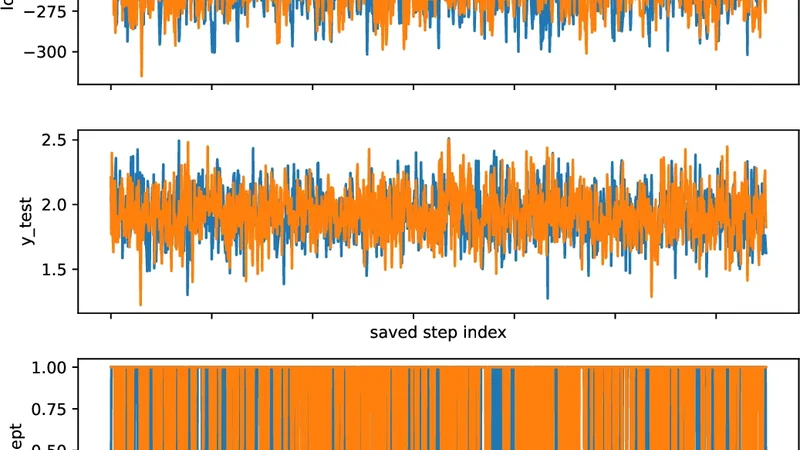

이 논문은 넓은 베이즈 신경망에서 가우시안 프로세스 한계를 넘어서는 희귀하지만 지배적인 변동을 대편차 이론으로 분석한다. 저자들은 예측기와 내부 커널을 동시에 최적화하는 새로운 변분 목표함수(레이트 함수)를 제시하고, 이를 통해 기능 수준에서 복잡도와 특징 학습을 정의한다. 실험 결과는 중간 규모 네트워크의 비가우시안 꼬리, 사후 분포 변형, 데이터 의존적 커널 선택 효과를 정확히 포착한다.

저자: Katerina Papagiannouli, Dario Trevisan, Giuseppe Pio Zitto

본 논문은 베이즈 신경망(Bayesian Neural Networks, BNN)의 폭이 무한대로 커질 때 가우시안 프로세스(NNGP)로 수렴한다는 기존 이론을 출발점으로 삼는다. 그러나 실제 적용에서는 네트워크 폭이 유한하고, 특히 중간 규모(수십에서 수백 뉴런)일 때는 NNGP가 예측하는 가우시안 분포와는 현저히 다른 비가우시안 현상이 관찰된다. 이러한 현상을 설명하기 위해 저자들은 대편차 이론(Large‑Deviation Theory)을 도입한다. 대편차 이론은 확률 분포의 희귀 사건이 지배적인 역할을 할 때, 그 사건의 확률을 지수적으로 감소시키는 레이트 함수(rate function)를 정의한다.

논문은 먼저 베이즈 신경망의 사후 분포 \(p(f|D)\)를 폭의 역수 \(\epsilon = 1/N\)에 대한 비대칭 전개로 표현한다. 여기서 \(f\)는 입력‑출력 함수, \(D\)는 데이터셋이다. 전개 결과는

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기