제한된 API 호출로 대규모 언어 모델을 고성능으로 튜닝하는 새로운 블랙박스 기법

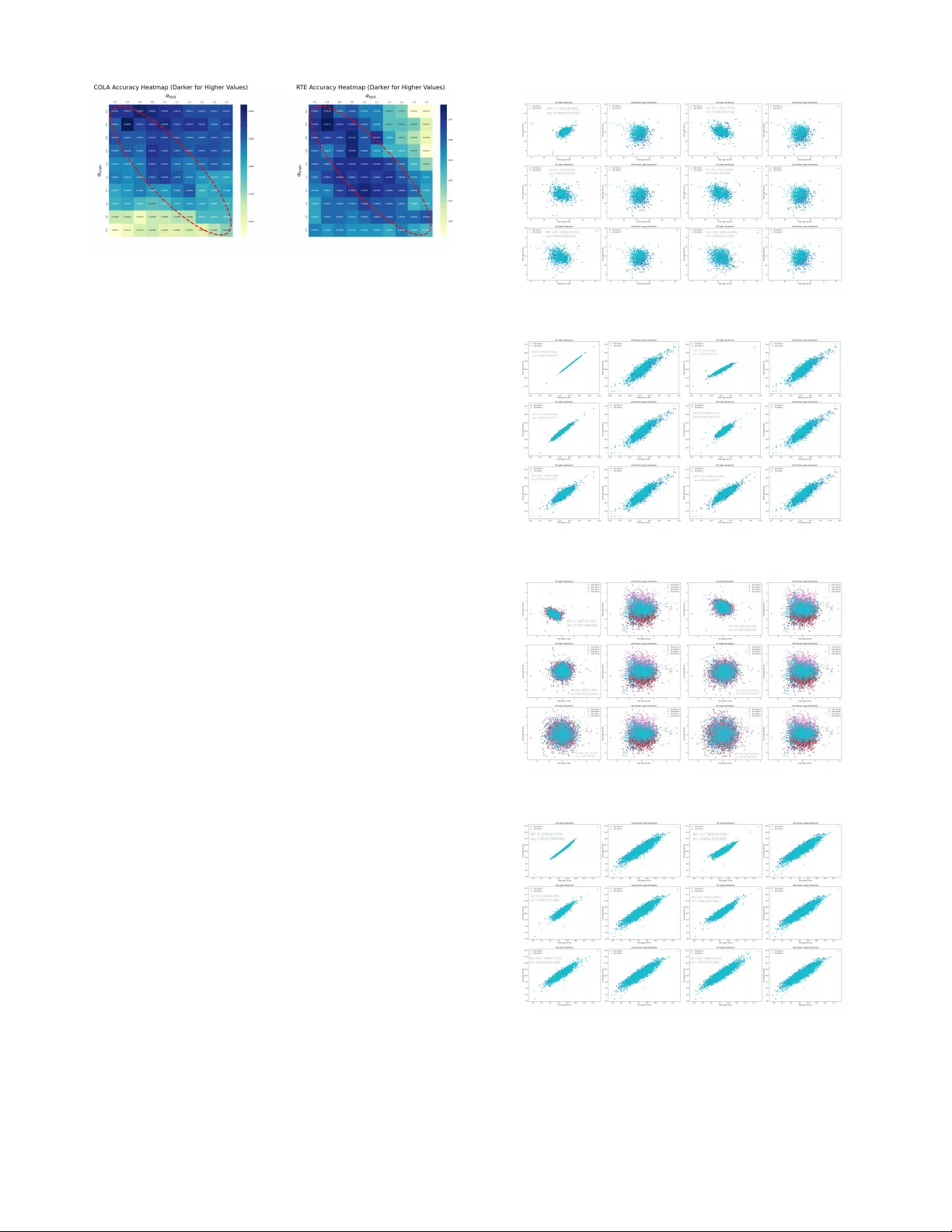

본 논문은 대규모 언어 모델(LLM)을 직접 파라미터에 접근하지 못하는 상황에서, 소수의 고품질 API 호출만으로 프록시 모델을 효과적으로 학습시키는 방법을 제안한다. 핵심은 “LogitMap Pair”를 이용해 구축한 가우시안 프로세스(GP) 서브게이트 모델이며, 이를 통해 대형 모델의 로짓 출력을 근사한다. 실험 결과, 기존 오프라인 방식 대비 정확도가 55.92%→86.85%로 크게 상승하고, API 호출량은 전체의 1.38% 수준으로 크…

저자: Zhikang Xie, Weilin Wan, Peizhu Gong

본 논문은 대규모 언어 모델(LLM)을 블랙박스 형태로 활용할 때, 파라미터에 직접 접근하지 못하는 제약 하에서 효율적인 튜닝 방법을 제시한다. 기존에는 (1) 오프라인 방식—작은 프록시 모델을 독립적으로 학습시켜 대형 모델의 출력에 보정값을 더하는 방법—과 (2) 온라인 방식—Consistent Proxy Tuning(CPT)처럼 매 학습 단계마다 대형 모델에 API 호출을 수행해 프록시 모델을 일관되게 학습시키는 방법—이 존재했지만, 전자는 성능이 제한적이고 후자는 비용이 과다했다.

이를 해결하기 위해 저자들은 “LogitMap Pair”라는 새로운 데이터 구조와 가우시안 프로세스(GP) 서브게이트 모델을 결합한 두 단계 학습 파이프라인을 설계했다. 첫 단계에서는 전체 학습 데이터 D 중 약 1%에 해당하는 고정보집성을 가진 샘플 집합 D′를 선택한다. 선택 알고리즘은 (a) 프록시 모델 M⁻ₛ의 임베딩 거리 기반 다양성 확보, (b) 대형 모델 Mₗ의 예측 불확실도(예: 로짓 분산) 기반 중요도 평가를 결합한다. 이렇게 추출된 LogitMap Pair는 입력 임베딩과 해당 입력에 대한 대형 모델의 로짓을 쌍으로 저장한다.

두 번째 단계에서는 이 LogitMap Pair를 이용해 다차원 로짓을 각각 독립적인 GP로 모델링한다. GP는 비모수 베이지안 회귀로, 커널 함수(k)와 노이즈 파라미터(σ²)를 통해 입력 임베딩 공간에서 로짓 값을 매끄럽게 추정한다. 다차원 로짓을 독립적으로 다루는 이유는 계산 효율성을 높이고, 실제 실험에서 충분히 좋은 근사 성능을 보였기 때문이다. GP는 예측 평균과 함께 불확실도(분산)를 제공한다. 논문은 이 불확실도를 활용해, 예측 분산이 사전 정의된 임계값 θ를 초과하는 경우에만 실제 API 호출을 수행하도록 설계하였다. 따라서 대부분의 학습 단계에서는 GP가 제공하는 근사 로짓을 사용하고, 필요한 경우에만 비용이 큰 대형 모델 호출을 수행한다.

학습된 GP 서브게이트는 프록시 모델 M⁺ₛ의 손실 함수에 직접 삽입된다. 구체적으로, 기존 CPT의 손실식

θ⁺ₛ = arg min θ⁺ₛ E₍ₓ, y₎∈D L( M⁺ₛ(x; θ⁺ₛ) + α·

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기