연속형 방어 공격 게임을 위한 증강 확률 시뮬레이션 기법

본 논문은 두 단계 방어‑공격(스택엘버그) 게임에서 기존 몬테카를로 방식의 비효율성을 극복하고, 연속형·고차원 의사결정 공간에서도 확장 가능한 증강 확률 시뮬레이션(APS) 알고리즘을 제안한다. 완전 정보 하의 균형 계산, 해석 민감도 분석, 그리고 정보가 불완전할 때의 적대적 위험 분석(ARA)까지 통합하는 프레임워크를 제시한다.

저자: Tahir Ekin, Roi Naveiro, Alberto Torres-Barran

본 논문은 순차적 방어‑공격 게임, 특히 두 단계 스택엘버그 구조를 대상으로 한 새로운 계산 프레임워크를 제시한다. 서론에서는 순차 게임이 비협력적 상황에서 의사결정자들이 번갈아 행동하고, 그 결과가 확률적 요인에 의해 좌우된다는 점을 강조한다. 완전 정보 게임에서는 Nash 균형 혹은 서브게임 완전균형(Subgame Perfect Equilibrium)을 구하는 것이 전통적 목표이며, 이를 위해서는 공격자의 최적 반응을 먼저 계산하고 그에 대한 방어자의 최적 방어를 찾는 이중 최적화가 필요하다. 그러나 이러한 이중 최적화는 결정 집합이 크거나 연속형일 경우 NP‑hard 문제로 전환돼, 기존의 열거법이나 진화 알고리즘은 확장성이 부족하다.

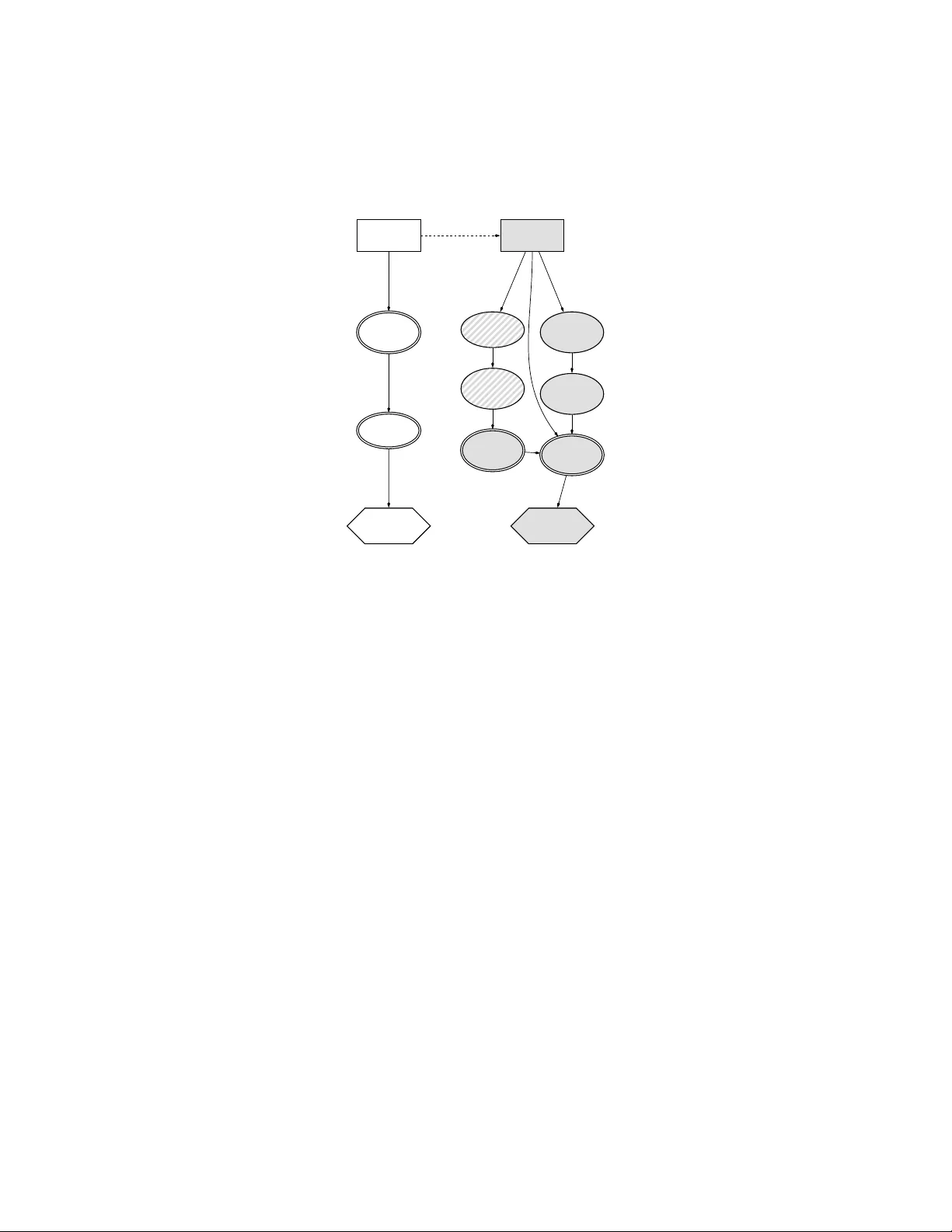

이에 대한 대안으로 저자들은 ‘증강 확률 시뮬레이션(Augmented Probability Simulation, APS)’을 도입한다. APS는 의사결정 변수와 불확실성 변수를 결합한 확장 공간에 ‘증강 분포’를 정의한다. 이 증강 분포는 원래 확률 밀도와 효용 함수의 곱으로 구성되며, 효용이 양수이고 적분 가능하면 정규화가 가능하다. 중요한 수학적 성질은 증강 분포의 주변 분포가 각 플레이어의 기대 효용에 비례한다는 점이다. 따라서 플레이어의 최적 행동은 증강 분포의 주변 분포에서 모드(mode)를 찾는 것으로 바로 얻을 수 있다.

구현 단계에서는 두 단계 각각에 메트로폴리스‑헤이스팅스(Metropolis‑Hastings, MH) 기반 MCMC 샘플링을 적용한다. 외부 APS는 방어자의 증강 분포 π_D(d,θ|a*)에서 샘플링하고, 내부 APS는 주어진 방어(d) 하에서 공격자의 증강 분포 π_A(a,θ|d)에서 샘플링한다. 이중 샘플링 구조는 ‘추정 + 최적화’를 동시에 수행하게 하여, 별도의 최적화 루프 없이 기대 효용의 최대값을 근사한다. 또한, 증강 분포는 효용이 큰 영역에 샘플을 집중시키는 파워 변환 효과가 있어, 모드 탐색이 빠르고 분산이 작다.

완전 정보 상황에서 저자들은 APS와 전통적인 몬테카를로(MC) 기반 알고리즘을 비교한다. 실험 결과, APS는 동일한 정확도 수준에서 필요한 샘플 수가 10배 이상 감소했으며, 특히 연속형 방어·공격 변수와 수백 차원의 고차원 설정에서도 이산화 없이 직접 샘플링이 가능해 메모리와 시간 복잡도가 선형에 가깝게 유지된다. 이는 사이버 보안, 대규모 물류 방어, 적대적 머신러닝(Adversarial Machine Learning, AML) 등 연속적·고차원 의사결정이 요구되는 분야에 큰 장점을 제공한다.

불완전 정보 상황에서는 적대적 위험 분석(Adversarial Risk Analysis, ARA) 프레임을 적용한다. ARA는 상대의 유형에 대한 사전을 의사결정자의 주관적 판단으로 구성하고, 이를 베이지안 업데이트 없이 직접 효용에 통합한다. 논문은 APS를 이용해 ARA의 사전·우도·후험을 모두 증강 분포에 포함시켜, ‘불완전 정보 게임’에서도 동일한 샘플링 절차로 근사해낸다. 이를 통해 방어자는 상대의 유형에 대한 불확실성을 정량화하고, 최적 방어 전략을 도출할 수 있다.

민감도 분석 부분에서는 증강 분포의 샘플을 재가중하거나 효용·확률 모델의 파라미터를 변형함으로써, 결과가 어떻게 변하는지를 즉시 확인할 수 있다. 이는 별도 시뮬레이션을 수행할 필요 없이 하나의 샘플 집합으로 다양한 시나리오를 평가할 수 있게 해, 정책 입안자와 보안 전문가에게 실용적인 도구가 된다.

논문의 구조는 다음과 같다. 2‑3절에서는 완전 정보 하의 균형 계산, APS 기반 알고리즘, 그리고 MC와의 비교를 상세히 기술한다. 4절에서는 불완전 정보와 ARA 적용 방법을 제시하고, 증강 분포를 이용한 사전·우도 통합 방식을 설명한다. 5절에서는 실험 설계와 성능 평가 결과를 제시하며, 6절에서는 사이버 보안 사례 연구(예: 네트워크 방어와 침입 탐지)에서 실제 데이터와 시뮬레이션을 통해 APS가 어떻게 방어 전략을 개선하는지를 보여준다. 부록에서는 주요 정리와 증명, 추가 알고리즘, 그리고 GitHub 저장소에 공개된 코드와 데이터에 대한 안내가 포함된다.

결론에서는 APS가 (1) 연속·고차원 의사결정 공간에서의 확장성, (2) 완전·불완전 정보 모두를 포괄하는 통합 프레임워크, (3) 민감도 분석을 별도 비용 없이 수행할 수 있는 장점, (4) 기존 MC 대비 샘플 효율성 향상을 제공한다는 점을 강조한다. 향후 연구 과제로는 다단계 게임으로의 확장, 다중 공격자·다중 방어자 시나리오, 그리고 실시간 온라인 의사결정에 대한 적응형 MCMC 기법 개발을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기