신경망 구조 탐색을 위한 서브아키텍처 앙상블 프루닝

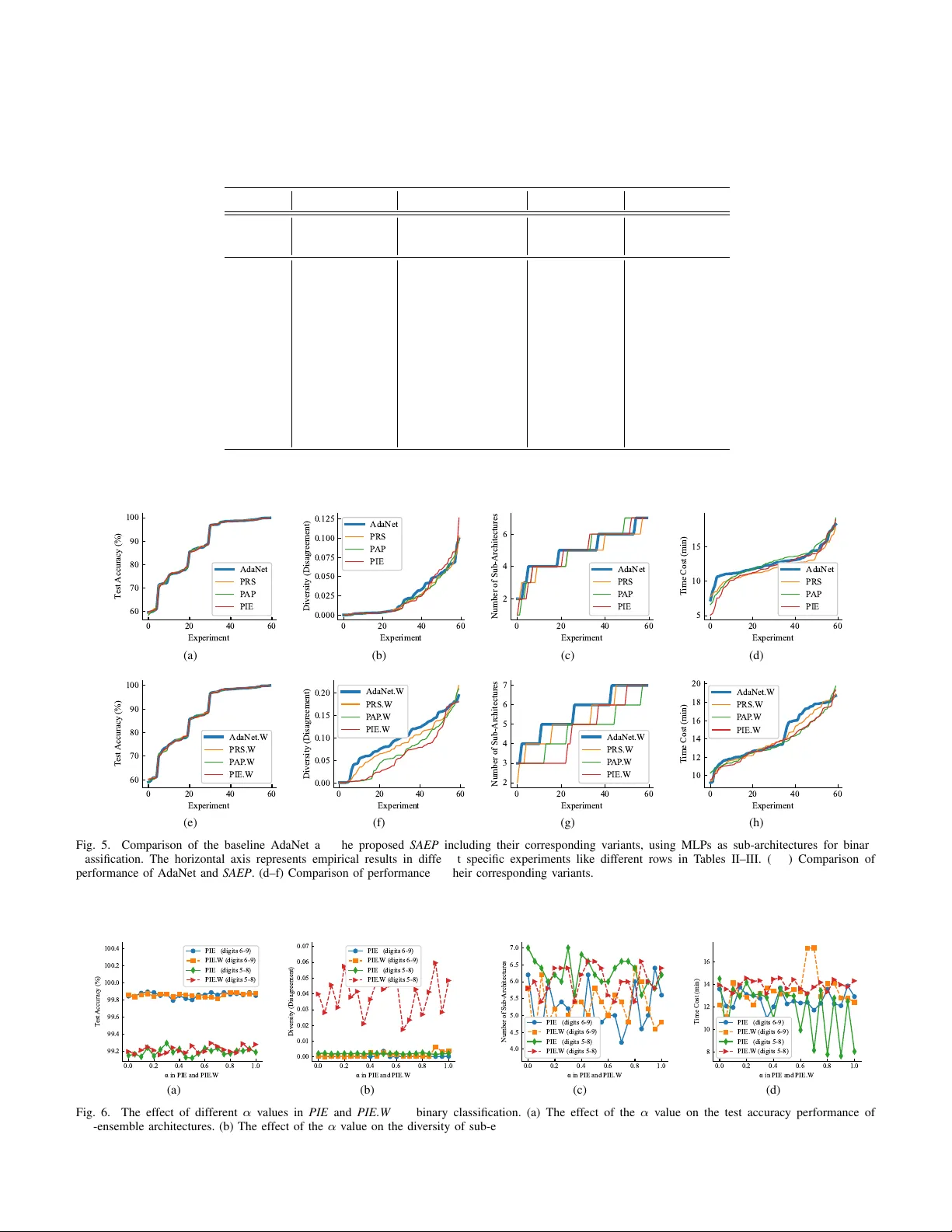

** 본 논문은 NAS(Neural Architecture Search) 과정에서 생성되는 다수의 서브아키텍처를 다양성 기반으로 효율적으로 정제하는 SAEP( Sub‑Architecture Ensemble Pruning) 방법을 제안한다. 무작위, 정확도 기반, 정보엔트로피 기반의 세 가지 프루닝 기준을 도입해 불필요한 서브모델을 제거하고, 적은 수의 서브아키텍처로도 원래 앙상블과 동등한 성능을 달성한다는 실험 결과를 제시한다. **

저자: Yijun Bian, Qingquan Song, Mengnan Du

**

본 논문은 최근 NAS(Neural Architecture Search) 분야에서 앙상블 학습을 도입해 개별 서브아키텍처를 저비용으로 학습하고, 이를 결합해 강력한 모델을 구성하는 접근법(AdaNet 등)의 한계를 극복하고자 한다. 기존 앙상블 기반 NAS는 주로 정확도와 모델 복잡도만을 최적화 목표에 포함시키며, 서브아키텍처 간의 상관관계, 즉 다양성을 고려하지 않는다. 다양성이 부족하면 서로 비슷한 서브모델이 다수 포함되어 불필요한 연산과 파라미터가 증가하고, 실제 성능 향상에 기여하지 못한다는 점이 문제점으로 지적된다.

이에 저자들은 “Sub‑Architecture Ensemble Pruning in Neural Architecture Search”(SAEP)라는 새로운 프루닝 프레임워크를 제안한다. SAEP는 AdaNet과 같은 기존 NAS‑Ensemble 방법을 기반으로 하면서, 탐색 과정 자체에 프루닝 메커니즘을 삽입한다는 점에서 차별화된다. 구체적으로, 매 탐색 단계에서 새로운 서브아키텍처 후보를 생성하고, 목표함수 L_g(w)=\hat R_{S,\rho}(f)+\Gamma 를 최소화해 가장 유망한 후보를 선택한다. 이후 선택된 후보와 기존 모델을 결합한 뒤, 세 가지 프루닝 기준 중 하나를 적용해 불필요한 서브아키텍처를 즉시 제거한다.

세 가지 프루닝 기준은 다음과 같다.

1. **PRS (Pruning by Random Selection)**: 가장 단순한 무작위 프루닝으로, 일정 확률에 따라 서브아키텍처를 제거한다. 이는 프루닝 효과 자체를 검증하기 위한 베이스라인 역할을 한다.

2. **PAP (Pruning by Accuracy Performance)**: 각 서브아키텍처가 전체 앙상블에 기여하는 정확도 향상을 정량화한다. 구체적으로, 손실 감소량 L_d(w)=\frac1m\sum_i

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기