메타학습 기반 딥 에너지 기억 모델

본 논문은 메타학습을 이용해 임의의 신경망을 에너지 함수로 활용하고, 짧은 단계의 경사 하강으로 패턴을 빠르게 저장·검색하는 새로운 연관 기억 체계인 EBMM을 제안한다. 합성 및 자연 이미지에 대해 압축 효율과 재구성 정확도에서 기존 기억 모델들을 능가한다.

저자: Sergey Bartunov, Jack W Rae, Simon Osindero

본 논문은 연관 기억(Associative Memory) 문제를 에너지 기반 모델(Energy‑Based Model, EBM)과 메타학습(Meta‑Learning)을 결합해 해결하고자 한다. 연관 기억은 손상되거나 부분적인 입력(쿼리)으로부터 원본 패턴을 복원하는 기능을 말한다. 전통적인 Hopfield 네트워크는 에너지 함수를 최소화하는 동적 시스템을 통해 패턴을 attractor(흡인점)로 저장한다. 그러나 Hopfield은 (1) 파라미터 수가 입력 차원의 제곱에 비례해 비효율적이며, (2) 고차원 데이터(예: 자연 이미지)의 복잡한 통계 구조를 포착하지 못한다는 한계가 있다. 반면, RBM·VAE·딥 Boltzmann 머신 등은 표현력이 뛰어나지만, 파라미터를 업데이트하는 데 수천 번 이상의 반복이 필요해 “쓰기” 단계가 매우 느리다.

저자들은 이러한 딜레마를 해결하기 위해 “Meta‑Learning Gradient‑Based Writing Rules”라는 새로운 프레임워크, 즉 EBMM(Energy‑Based Memory Model)을 제안한다. 핵심 아이디어는 다음과 같다.

1. **에너지 함수 정의**: 임의의 스칼라 출력 신경망 E(x;θ)를 에너지 함수로 사용한다. 네트워크는 일반적인 활성화 함수(tanh 등)를 사용해 미분 가능하고, 입력 x에 대해 에너지 값을 반환한다.

2. **쓰기 손실 설계**: 저장하고자 하는 패턴 집합 X={x₁,…,x_N}에 대해

W(x,θ)=E(x;θ)+α‖∇ₓE(x;θ)‖²+β‖θ−θ̄‖²

를 정의한다. 첫 항은 저장 패턴의 에너지를 낮추어 다른 패턴보다 우선순위를 부여하고, 두 번째 항은 그라디언트가 0에 가깝게 하여 로컬 최소점임을 강제한다. 세 번째 항은 메타 초기값 θ̄와의 거리 제한으로 과도한 파라미터 변화를 억제한다.

3. **쓰기 알고리즘**: 쓰기 손실에 대해 T=5번의 트렁케이티드 경사 하강을 수행한다.

θ(t+1)=θ(t)−η(t)·(1/N)∑ₙ∇_θW(xₙ,θ(t)), θ(0)=θ̄

이렇게 얻어진 θ(T)는 입력 패턴이 에너지 함수의 로컬 최소점이 되도록 조정된 파라미터이다.

4. **읽기 알고리즘**: 저장된 파라미터 θ를 이용해 왜곡된 쿼리 ˜x에 대해 K=5번의 경사 하강(또는 모멘텀·프로젝션 변형)으로 원본 패턴을 복원한다.

x(k+1)=x(k)−γ(k)∇ₓE(x(k);θ), x(0)=˜x

최종 x(K)를 read(˜x;θ)라 정의한다.

5. **메타 학습**: 쓰기·읽기 모두가 미분 가능하므로, 전체 재구성 손실 L(X,θ)=E_{˜x∼p(·|x)}‖x−read(˜x;θ)‖²에 대해 역전파한다. 메타 파라미터(θ̄, 학습률 스케줄 {γ(k)},{η(t)}, α,β)를 최적화해 “빠른 적응”을 위한 좋은 초기값과 단계 크기를 학습한다. 메타 학습은 다양한 배치 X를 샘플링해 수행되며, 실제 테스트 시에는 메타 학습이 끝난 θ̄와 학습률만을 사용한다.

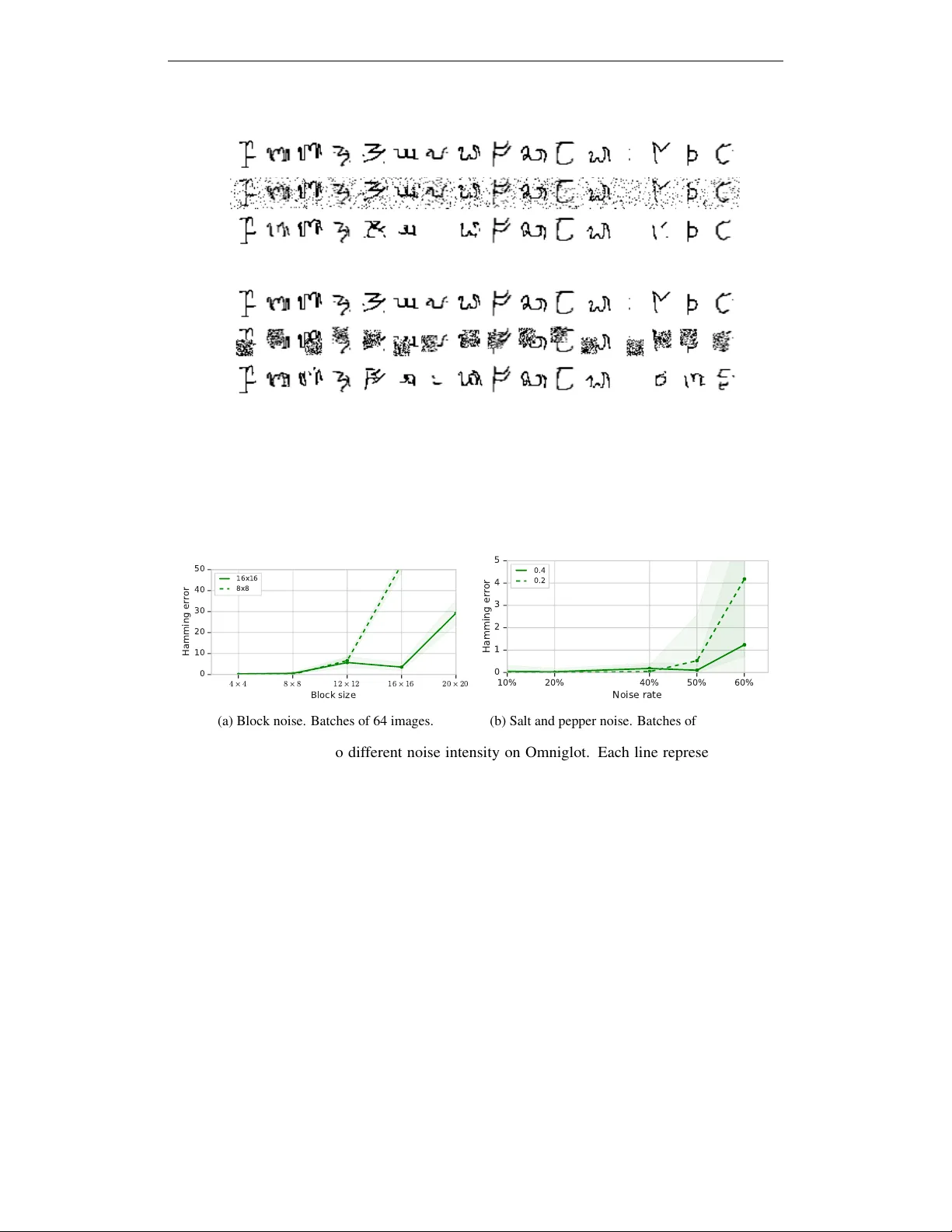

6. **실험 설정**: Omniglot 문자와 CIFAR‑10/100 이미지 배치를 사용해 메모리 용량 대비 재구성 오류를 측정하였다. 메모리 크기는 가중치의 수정 가능한 부분(플로트32 수)으로 정의했으며, EBMM은 동일한 메모리 양에서 MANN, Memory Network, Differentiable Plasticity 등 최신 메모리‑증강 모델들을 크게 앞섰다. 특히, 자연 이미지에서 압축률(메모리 사용량)과 재구성 정확도 사이의 트레이드오프를 최적화했으며, 5단계 이내의 쓰기·읽기로 O(N) 연산 복잡도를 유지했다.

7. **결과 및 분석**:

- **압축 효율**: EBMM은 동일 메모리 용량에서 다른 모델보다 낮은 Hamming/Mean‑Squared Error를 기록했다.

- **속도**: 쓰기와 읽기 모두 5단계의 경사 하강으로 수렴했으며, 이는 기존 모델이 수백~수천 단계가 필요한 것에 비해 현저히 빠르다.

- **스파이러시 억제**: 메타 학습된 단계 크기 γ(k)가 로컬 최소점 주변의 불필요한 attractor를 회피하도록 학습돼, 실제 실험에서 spurious attractor가 거의 관찰되지 않았다.

8. **한계 및 향후 연구**: 메타 학습 단계에서 대규모 데이터와 다양한 왜곡 모델에 대한 샘플링 비용이 높으며, 에너지 함수가 비선형이므로 이론적 수렴 보장이 약하다. 향후 연구에서는 (a) 메타 학습 비용을 줄이는 효율적인 샘플링 전략, (b) 에너지 함수에 대한 정규화·스파이러시 억제 기법, (c) 연속‑시간 또는 확률적 동역학을 결합한 확장 모델을 탐구할 수 있다.

요약하면, 본 논문은 “임의 딥 네트워크를 에너지 기반 기억 매체로 활용하고, 메타학습을 통해 짧은 단계의 경사 하강으로 빠르게 쓰고 읽는” 새로운 기억 프레임워크 EBMM을 제시한다. 이는 기존의 표현력·속도·압축 효율 사이의 트레이드오프를 크게 개선했으며, 연관 기억을 실제 고차원 데이터에 적용할 수 있는 실용적인 길을 열었다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기