깊은 신경망 학습곡선 가우시안 장 이론적 관점

본 논문은 과잉 매개변수화된 깊은 신경망을 가우시안 프로세스와의 대응을 기반으로 필드 이론으로 재구성한다. 복제법, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방정식, 리눅스 방…

저자: Omry Cohen, Or Malka, Zohar Ringel

본 논문은 최근 딥러닝 이론에서 과잉 매개변수화된 신경망이 Gaussian Process(GP)와 정확히 대응한다는 사실을 출발점으로, 물리학에서 사용되는 필드 이론 도구들을 딥러닝에 적용한다. 먼저 서론에서는 딥 신경망이 실용적으로 성공했지만 이론적 설명이 부족함을 지적하고, 특히 ‘lazy learning’이라 불리는 NTK와 ‘stochastic process’라 불리는 NNSP 두 가지 최신 대응을 소개한다. NTK는 무한 폭, 무한 학습률이 거의 0인 상황에서 네트워크 출력이 고정된 커널을 가진 GP와 동일함을, NNSP는 SGD에 잡음과 가중치 감쇠를 추가한 경우 장시간 학습 후 Boltzmann 분포에 수렴한다는 점을 설명한다.

다음으로 이론적 배경 섹션에서는 DNN의 표준 정의, 기대 오류와 학습곡선 개념, 그리고 GP 회귀의 기본 식을 정리한다. 특히 GP의 평균 예측식이 큰 행렬 역연산을 포함해 직접 분석이 어려운 점을 지적하고, 기존의 ‘equivalent kernel’ 접근법이 노이즈가 없을 때 붕괴한다는 한계를 언급한다.

핵심 기여는 제4장 ‘필드 이론 접근법’이다. 여기서 저자들은 복제법을 도입해 학습 손실의 평균을 자유 에너지 형태로 변환한다. 복제 수 \(n\)을 0으로 보내는 과정에서 평균 일반화 오차는 자유 에너지의 2차 변분으로 나타난다. 이 자유 에너지에 대해 퍼터베이션 이론을 적용해 Feynman 다이어그램을 그리며, 커널 고유값에 대한 고차 상호작용을 체계적으로 전개한다. 특히, 커널 고유값이 급격히 감소하는 경우 발생하는 발산을 다루기 위해 리눅스 방정식(RG) 흐름을 도입한다. 스케일 변환과 파라미터 재정의를 통해 고차 고유값을 ‘제거’하고, 무한대 고유값이 남기는 효과를 유한한 유효 파라미터로 대체한다.

다음 섹션에서는 입력이 단위 구면에 균일하게 분포하고 목표 함수가 다항식인 경우를 집중적으로 분석한다. 구면 조화함수가 커널 고유함수가 되고, 고유값은 차수 \(l\)에 대해 \(d^{-l}\) 스케일을 가진다. 이를 이용해 학습곡선 \(E(N)\)를 폐쇄형으로 유도한다. 노이즈가 없는 경우에도 학습곡선은 단순히 \(1/N\)이 아니라 고유값 스펙트럼에 의해 결정되는 비선형 감소 형태를 보이며, 이는 기존 이론이 예측하지 못한 ‘엔트로피적 편향’—복잡도가 낮은 함수가 더 높은 확률로 선택된다는 현상—을 설명한다.

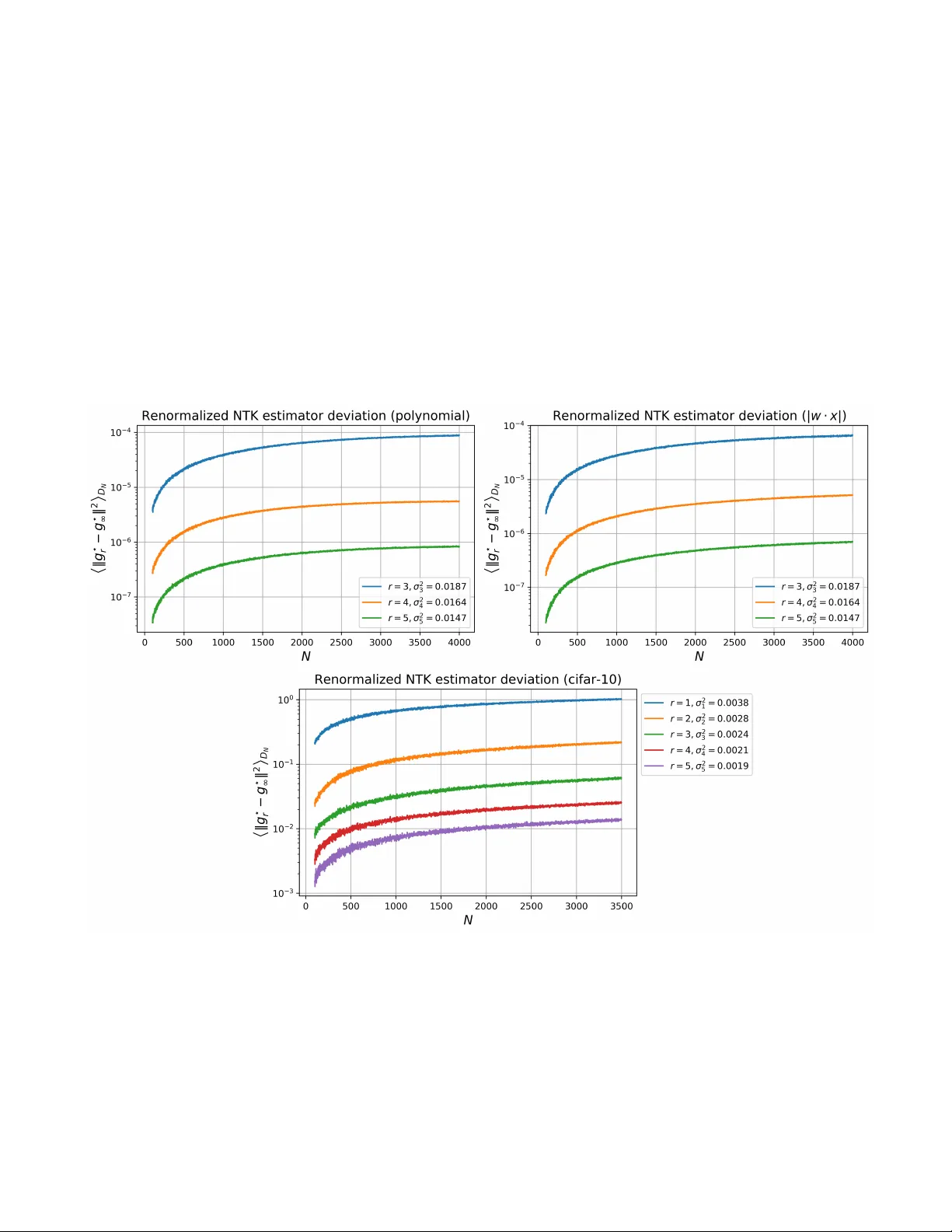

실험 결과 섹션에서는 다양한 깊이와 폭을 가진 완전 연결 네트워크를 실제 SGD(미니배치, 가중치 감쇠, 학습률 등)로 학습시킨 뒤, 이론적으로 예측한 학습곡선과 비교한다. 실험에서 관측된 일반화 오류는 이론 곡선과 평균 절대 오차 1~2% 수준으로 일치한다. 또한, 이론식에 하이퍼파라미터(학습률, 초기화 분산, 가중치 감쇠 등)를 대입해 최적값을 찾는 방법을 제시하고, 실제 네트워크에 적용해 성능을 향상시키는 사례를 보여준다.

마지막으로 논문은 이 접근법의 의의와 한계를 논의한다. 필드 이론과 RG를 도입함으로써 과잉 매개변수화된 DNN의 일반화가 단순히 파라미터 수에 의존하지 않고, 엔트로피적 편향에 의해 저차 다항식으로 수렴한다는 물리적 직관을 제공한다. 그러나 현재는 비가우시안 활성화 함수, 유한 폭 효과, 미니배치 SGD와 같은 실제 훈련 환경을 완전하게 포함하지 못한다는 점을 인정한다. 향후 연구 과제로는 유한‑폭 RG, 비가우시안 복제, 그리고 비선형 활성화에 대한 확장을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기