DRLViz 딥 강화학습 의사결정과 메모리 이해

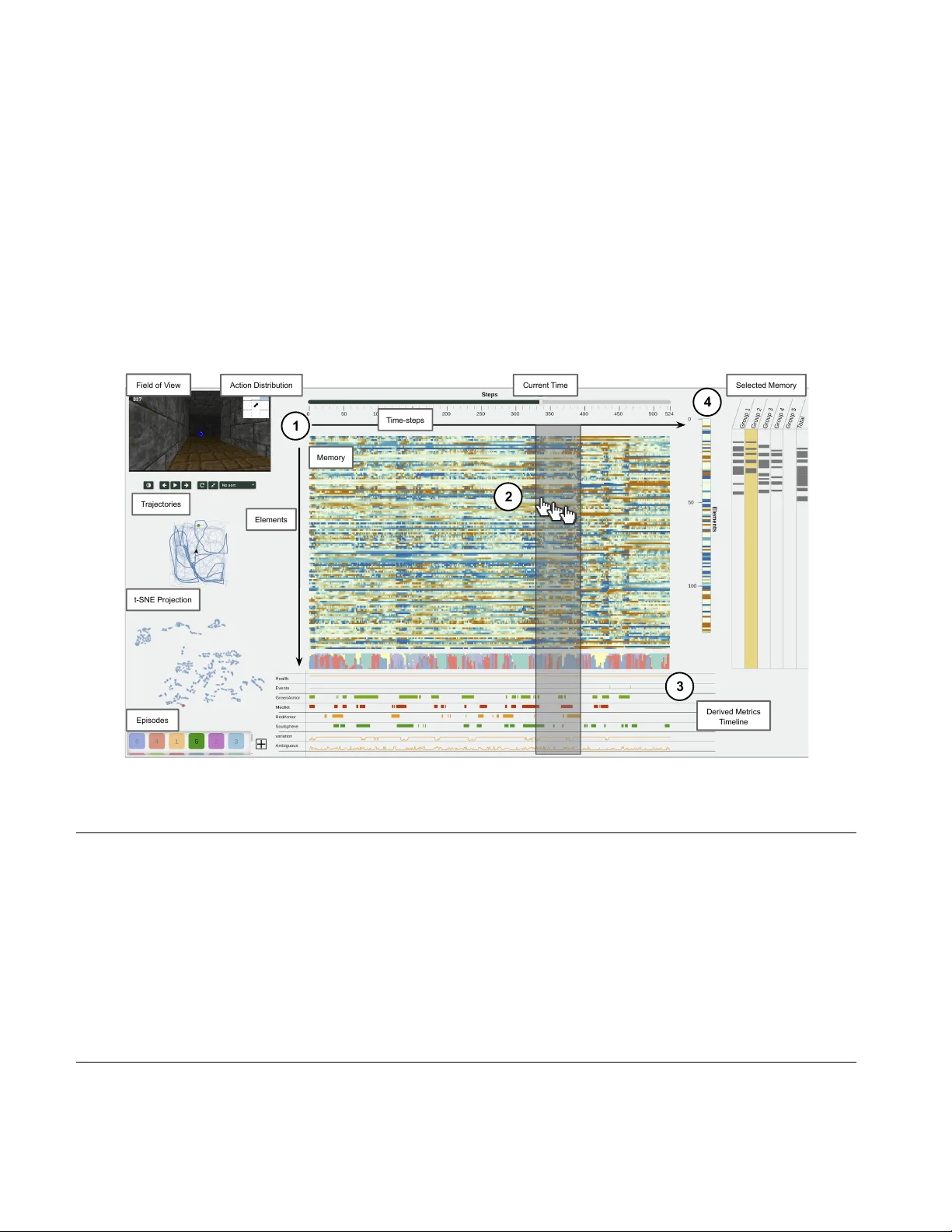

DRLViz는 깊은 강화학습(Deep Reinforcement Learning) 에이전트의 내부 메모리를 시각적으로 분석할 수 있는 인터페이스이다. 메모리 벡터를 히트맵, t‑SNE 투영, 타임라인 등으로 표현하고, 행동, 관측, 보상 등 파생 메트릭과 연동해 전문가가 결정 과정을 추적·해석하도록 돕는다. ViZDoom 기반 네비게이션 시나리오와 전문가 평가를 통해 시스템의 유용성을 검증하였다.

저자: Theo Jaunet, Romain Vuillemot, Christian Wolf

본 논문은 딥 강화학습(Deep Reinforcement Learning, DRL) 에이전트가 환경과 상호작용하면서 축적하는 고차원 시계열 메모리를 인간이 직관적으로 이해할 수 있도록 돕는 시각 분석 시스템 **DRLViz**를 제안한다. 논문은 크게 네 부분으로 구성된다.

**1. 연구 배경 및 문제 정의**

강화학습은 에이전트가 관측(oₜ), 행동(aₜ), 보상(rₜ)이라는 순환 구조 속에서 최적 정책 π(a|o) 를 학습한다. 최근 A2C, DQN, PPO 등 다양한 DRL 알고리즘이 복잡한 3D 환경에서 인간 수준의 성능을 보이고 있지만, 내부 상태—특히 메모리(예: LSTM 은닉 상태)—는 수백에서 수천 차원의 실수 벡터로 표현된다. 이러한 메모리는 과거 관측, 행동, 보상의 복합적인 요약이며, 차원 간 상관관계와 시간적 의존성이 얽혀 있어 “왜 특정 행동을 선택했는가”를 해석하기 어렵다. 기존 시각화 도구는 이미지 입력·출력 혹은 CNN 필터 시각화에 초점을 맞추었고, 메모리 기반 정책을 다루는 도구는 거의 없었다.

**2. DRLViz 설계 목표**

- **시간적 연속성**: 메모리 벡터를 시간 축에 따라 히트맵 형태로 보여, 전체 에피소드 동안 메모리 변화 흐름을 한눈에 파악한다.

- **컨텍스트 연동**: 행동 분포, 보상, 아이템 시야 등 파생 메트릭을 메모리와 동기화해 특정 상황에서 메모리 패턴을 강조한다.

- **차원 축소·클러스터링**: t‑SNE 투영을 이용해 고차원 메모리를 2D 평면에 배치하고, 유사한 메모리 상태를 클러스터링해 선택·하이라이트한다.

- **인터랙티브 필터링**: 사용자는 시간 구간, 행동 종류, 보상 구간 등을 조합해 메모리 서브셋을 추출하고, 해당 서브셋에 대한 상세 정보를 탐색한다.

**3. 구현 및 데이터 파이프라인**

에이전트는 ViZDoom 시뮬레이터의 ‘k‑items’ 시나리오에서 A2C 알고리즘으로 학습된다. 입력은 84×84 RGB 이미지이며, CNN‑LSTM 구조를 통해 은닉 상태 hₜ (차원 512)를 생성한다. 학습이 완료된 모델을 사용해 각 타임스텝 t 에 대해 (이미지, hₜ, 행동 aₜ, 보상 rₜ, 에피소드 메타데이터)를 로그 파일에 저장한다. 로그는 JSON 형태로 전처리돼 PostgreSQL에 적재되고, 백엔드 API가 이를 시각화 모듈에 제공한다. 프론트엔드에서는 D3.js와 WebGL 기반 히트맵 뷰, t‑SNE 2D 스캐터 플롯, 타임라인 슬라이더, 메트릭 차트 등을 구현하였다. 사용자는 히트맵 위에 마우스를 올려 특정 차원의 값을 확인하고, 클릭으로 해당 차원을 고정하거나 클러스터를 선택해 연관된 시간 구간을 자동으로 확대한다.

**4. 사례 연구 및 전문가 평가**

세 명의 DRL 전문가에게 DRLViz를 사용해 ‘k‑items’ 시나리오를 분석하도록 했다. 주요 발견은 다음과 같다.

- 아이템이 시야에 들어올 때 메모리 차원 27~34가 급격히 활성화되며, 이는 아이템 종류(녹색 갑옷, 빨간 갑옷 등)와 강하게 연관된다.

- 잘못된 행동(예: 왼쪽으로 회전 후 바로 뒤로 이동) 발생 직전 메모리 차원 112가 비정상적으로 높은 값을 보였고, 이는 이전에 관측한 장애물 위치와 관련된 것으로 추정된다.

- t‑SNE 클러스터링 결과, ‘탐색 단계’와 ‘수집 단계’가 각각 별도 클러스터에 매핑돼, 메모리 패턴이 행동 목표에 따라 구분됨을 확인했다.

전문가들은 DRLViz가 “메모리와 행동 사이의 인과 관계를 탐색”하는 데 큰 도움이 되었으며, 특히 메모리 차원 축소와 클러스터 선택 기능이 복잡한 정책을 이해하는 데 핵심적이었다고 평가했다. 또한, 시스템이 현재 시뮬레이션 환경에 최적화돼 있지만, 실제 로봇이나 자율주행 차량에 적용하려면 실시간 스트리밍과 대규모 차원 샘플링이 필요하다는 점을 지적했다.

**5. 논의 및 향후 연구**

DRLViz는 현재 ViZDoom 기반 3D 환경에 초점을 맞추었지만, 메모리 기반 정책을 사용하는 대부분의 DRL 응용 분야(예: Matterport3D 탐색, 로봇 매니퓰레이션, 의료 로봇)에도 적용 가능하다. 향후 연구 방향으로는 (1) 실시간 메모리 스트리밍을 지원해 온라인 디버깅을 가능하게 하는 것, (2) 차원 선택을 위한 자동 중요도 추정(예: SHAP, Integrated Gradients) 기법을 통합해 전문가가 직접 차원을 탐색할 필요를 줄이는 것, (3) 다중 에이전트 시나리오에서 메모리 상호작용을 시각화하는 확장성을 제시한다. 또한, 메모리와 정책 간의 정량적 인과 관계를 모델링하기 위해 베이지안 네트워크나 인과 그래프와 연계하는 연구도 제안한다.

결론적으로, DRLViz는 DRL 에이전트의 내부 메모리를 시각·인터랙티브하게 탐색함으로써 “왜”와 “어떻게”라는 질문에 답할 수 있는 강력한 도구이며, 설명가능 인공지능(XAI) 및 안전한 AI 시스템 구축에 중요한 기여를 할 것으로 기대한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기