모델예측제어의 단계비용을 강화학습으로 형상화한 새로운 접근법

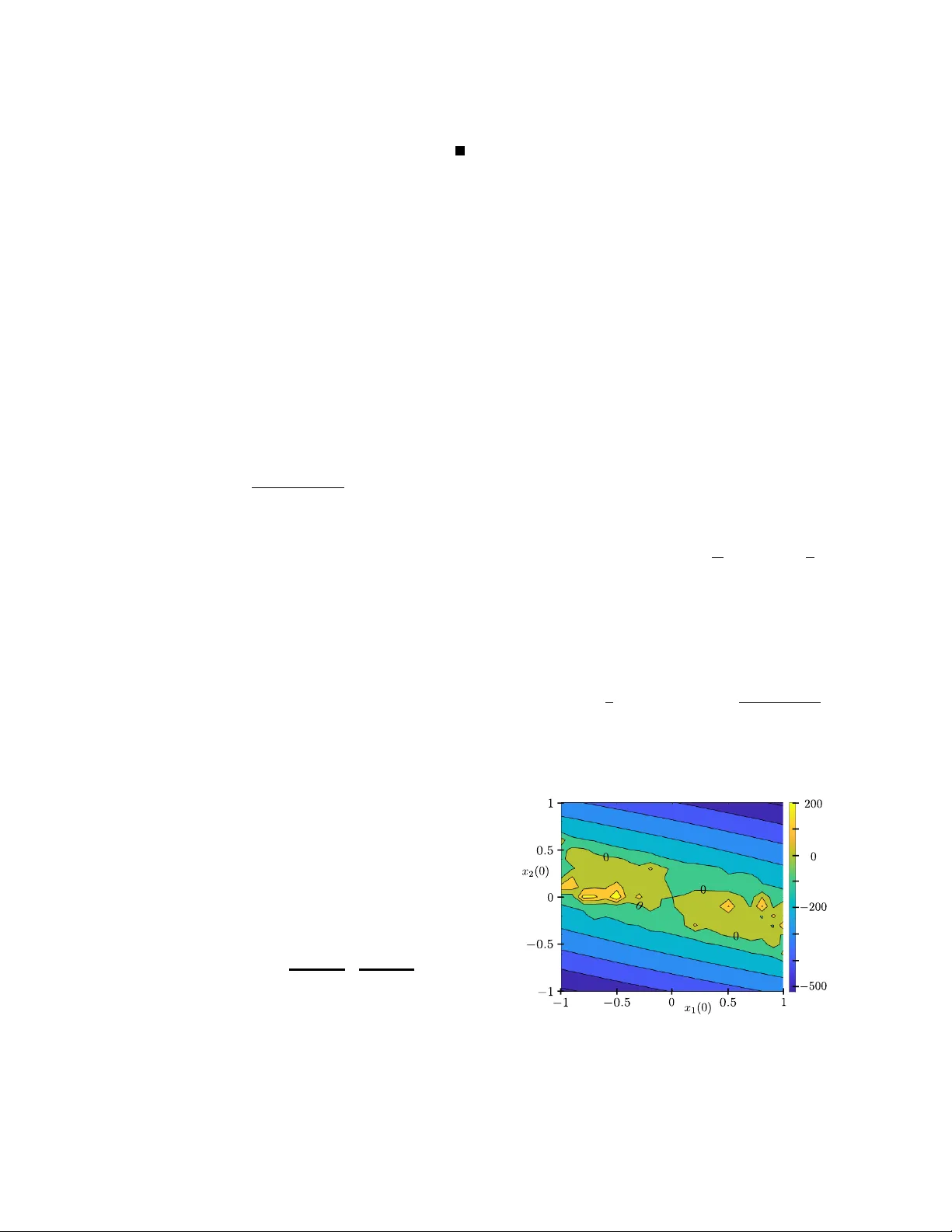

본 논문은 강화학습 중 Q‑learning 아이디어를 차용해 MPC의 단계비용을 실시간으로 스케일링하는 방법을 제안한다. 기존의 터미널 비용·집합 기반 안정성 보장은 유지하면서, 단계비용에 가중계수 c를 도입하고 이를 TD(Temporal‑Difference) 업데이트로 조정한다. 제안된 스키마에 대한 서브옵티멀리티 경계와 안정성 증명을 제공하고, 두 개의 시뮬레이션 사례를 통해 초기조건에 따른 성능 향상을 확인한다.

저자: Lukas Beckenbach, Pavel Osinenko, Stefan Streif

본 논문은 강화학습, 특히 Q‑learning의 아이디어를 차용해 모델예측제어(MPC)의 단계비용을 실시간으로 조정하는 새로운 프레임워크를 제시한다. 기존 MPC는 무한시간 최적제어 문제를 유한시간 최적화 문제로 변환해 온라인으로 해결하지만, 터미널 비용·집합을 고정하고 단계비용을 그대로 사용하는 경우가 대부분이다. 이러한 고정 구조는 초기 상태가 멀리 있거나 시스템 비선형성이 강할 때 서브옵티멀리티가 크게 발생한다는 한계가 있다.

논문은 이 문제를 해결하기 위해 단계비용 l(x,u) 에 양의 스칼라 계수 c_k(i) 를 곱해 비용을 스케일링한다. 여기서 c_k(i) 는 현재 시점 k 와 예측 단계 i 에 따라 달라지는 시퀀스로, Q‑함수 Q(x,u)=l(x,u)+min_a Q(f(x,u),a) 를 c·l 형태로 근사한다는 가정에 기반한다. 즉, 최적 Q‑함수가 원래 단계비용의 일정 배율이라고 가정하고, 그 배율을 온라인에서 학습한다는 것이다.

이를 위해 저자는 다음과 같은 수학적 구조를 만든다.

1. **시스템 모델**: 이산시간 비선형 시스템 x_{k+1}=f(x_k,u_k) 을 가정하고, (x̄,ū)=(0,0)이 유일한 평형점이다.

2. **무한시간 최적제어 문제(IHOCP)**: 비용 V_∞(x_0)=min_{u_k} Σ_{k=0}^∞ l(x_k,u_k) 을 정의한다.

3. **전통적 NMPC**: 유한 horizon N, 터미널 집합 X_f, 터미널 비용 F(x) (로컬 라이아프노프 함수)와 제어 μ_F를 이용해 \tilde V_∞^{MPC}(x_k) 를 정의한다. 이때 안정성은 Δ_{μ_F}F≤−α_F F 조건에 의해 보장된다.

그 다음, 단계비용에 계수 c_k(i) 를 곱한 새로운 비용 함수를 도입한다.

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기