음악 구조를 명시적으로 인코딩한 딥러닝 모델의 효과: LSTM vs WaveNet 비교 연구

본 논문은 코드 진행에 조건을 두고 멜로디를 생성하는 과제를 통해, 순환 신경망(LSTM)과 확장된 수용 영역을 갖는 Temporal‑CNN(WaveNet)의 구조 인코딩 차이가 생성 품질에 미치는 영향을 실험적으로 분석한다. 데이터는 Nottingham 포크송 데이터베이스이며, 인간 청취 설문과 Variable Markov Oracle 기반 패턴 분석을 통해 WaveNet이 장기 구조와 코드‑멜로디 상호작용을 더 잘 학습함을 입증한다.

저자: Ke Chen, Weilin Zhang, Shlomo Dubnov

본 논문은 심볼릭 음악 생성, 특히 주어진 코드 진행에 맞춰 멜로디를 생성하는 과제를 통해 딥러닝 모델의 구조 인코딩 방식이 생성 품질에 미치는 영향을 체계적으로 비교한다. 연구 배경으로는 기존 이미지·짧은 시퀀스 생성에서는 성공적인 결과가 보고됐지만, 음악은 장기 의존성과 복합적인 구조를 갖고 있어 여전히 어려운 분야라는 점을 제시한다. 이를 해결하기 위해 두 가지 대표적인 순차 모델, LSTM(순환 신경망)과 WaveNet(확장된 Temporal‑CNN)을 선택하였다. LSTM은 은닉 상태를 통해 시간적 정보를 암시적으로 저장하지만, 수용 영역이 제한적이며 장기 패턴 학습에 한계가 있다. 반면 WaveNet은 팽창된 1‑D 컨볼루션을 여러 층에 쌓아 리셉티브 필드를 급격히 확대함으로써, 입력 시퀀스 전체에 대한 직접적인 의존성을 제공한다.

데이터 전처리 단계에서는 멜로디와 코드를 각각 원‑핫 인코딩한 뒤, 두 벡터를 결합한 “staggered representation”을 만든다. 멜로디는 피치(0‑127), 휴식, 지속 상태를 포함한 130 차원, 코드는 24개의 주요/마이너 코드와 ‘없음’ 표시를 포함한 25 차원으로 구성된다. LSTM 모델은 단방향과 양방향 두 버전을 구현했으며, 양방향 모델은 전체 코드 진행을 전역 조건으로 사용한다. WaveNet은 멜로디 입력에 팽창 컨볼루션을 적용하고, 각 층에서 1×1 컨볼루션을 통해 코드 벡터를 로컬 조건으로 결합한다. 두 모델 모두 교차 엔트로피 손실을 최소화하도록 학습하였다.

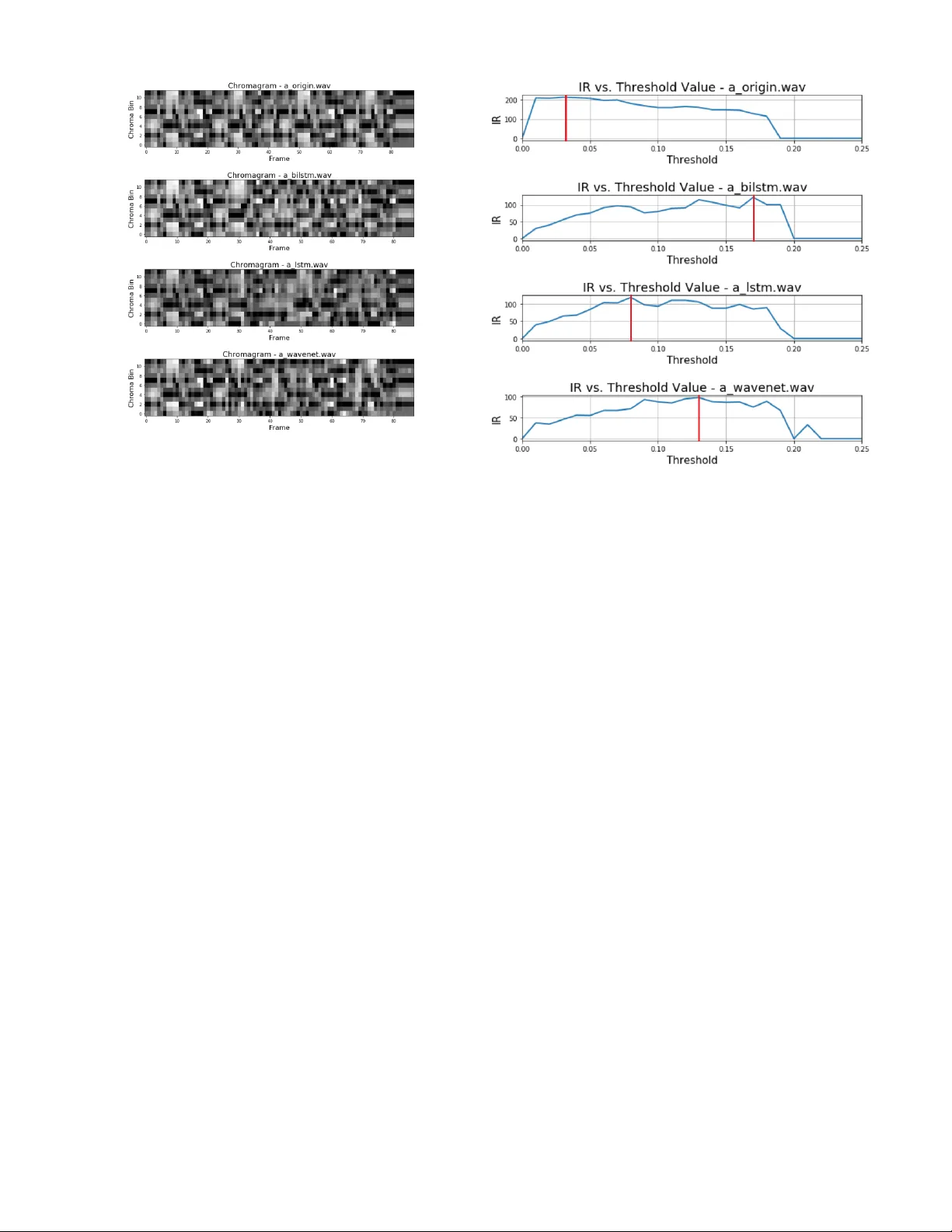

실험 데이터는 Nottingham 포크송 데이터베이스(941곡) 중 631곡을 훈련에 사용하고, 12키 전이시켜 데이터 양을 12배로 늘렸다. 샘플링 간격은 1/16 박자로 설정했으며, 모든 곡을 120 bpm으로 정규화하였다. 모델 성능 평가는 두 축으로 진행되었다. 첫째, 106명의 청취자를 대상으로 한 설문 조사에서 각 모델이 생성한 20박 원본 + 20박 생성 멜로디를 듣고, 인터랙티비티, 복잡성, 구조 세 가지 항목을 1‑5점 척도로 평가받았다. 둘째, Variable Markov Oracle를 이용해 생성된 멜로디의 반복 패턴과 장기 구조 재현율을 정량 분석하였다. 통계 분석으로는 ANOVA와 두 표본 t‑검정을 수행했으며, 모든 p값이 0.05 이하로 유의미한 차이를 보였다. 특히 WaveNet은 평균 점수와 패턴 재현율 모두에서 LSTM(특히 단방향)보다 우수했으며, 양방향 LSTM과 비교해도 구조 인식 측면에서 더 높은 점수를 얻었다. 전역 코드 조건을 포함한 모델이 부분적 코드 조건만을 사용한 경우보다 구조 점수가 크게 향상된 점도 강조된다.

결론적으로, 음악 생성에서 구조를 명시적으로 인코딩하는 dilated convolution 기반의 WaveNet이 장기 의존성 및 코드‑멜로디 상호작용을 효과적으로 학습한다는 것이 입증되었다. 또한, 전역 화성 정보를 조건으로 제공하는 것이 멜로디의 구조적 일관성을 높이는 데 중요한 역할을 함을 확인하였다. 이 연구는 심볼릭 음악 생성 분야에서 Temporal‑CNN의 가능성을 제시하고, 향후 더 복잡한 음악 형식(예: 다중 악기, 다중 구절)에도 적용할 수 있는 기반을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기