아타리 게임을 위한 딥 리커런트 더블 Q러닝

본 논문은 기존 DQN, DDQN, DRQN 모델의 한계를 보완하고자, LSTM 기반의 순환 신경망과 Double Q‑Learning을 결합한 Deep Recurrent Double Q‑Learning(DRDQN) 구조를 제안한다. 제안 모델을 Atari 2600의 네 가지 게임(Space Invaders, Enduro, Pong, Beam Rider)에서 1천만 에피소드 학습시킨 결과, 기존 모델 대비 평균 15 % 이상 높은 점수를 기록하였…

저자: Felipe Moreno-Vera

본 논문은 딥 강화학습(Deep Reinforcement Learning, DRL) 분야에서 Atari 2600 게임을 대상으로 한 학습 알고리즘의 성능 향상을 목표로 한다. 서론에서는 DRL이 자율주행, AlphaZero와 같은 보드 게임, 그리고 비디오 게임 분야에서 어떻게 활용되고 있는지를 간략히 소개한다. 특히 Q‑Learning 기반 알고리즘이 강화학습의 핵심으로 자리 잡았으며, Q값의 무한합 문제와 할인 인자 γ를 통한 미래 보상의 가중치 조절 필요성을 강조한다.

배경 섹션에서는 Sutton과 Barto의 강화학습 이론을 토대로, DeepMind가 제안한 DQN(Deep Q‑Learning)과 그 변형인 DDQN(Deep Double Q‑Learning), DRQN(Deep Recurrent Q‑Learning) 등을 정리한다. DQN은 경험 재플레이와 고정 타깃 네트워크를 도입해 학습 안정성을 확보했지만, 타깃값 계산 시 max 연산이 동일 네트워크 내에서 수행돼 Q값을 과대평가하는 문제가 있다. 이를 해결하기 위해 DDQN은 행동 선택과 가치 평가를 서로 다른 파라미터 집합으로 분리한다. 그러나 DDQN은 시계열적 의존성을 충분히 반영하지 못한다.

DRQN은 LSTM(Long Short‑Term Memory) 기반 순환 신경망을 도입해 부분 관측 마르코프 결정 과정(POMDP)에서 상태 정보를 보강한다. 하지만 기존 DRQN 구현에서도 타깃값을 생성하는 네트워크가 단일이며, Double Q‑Learning의 과대평가 억제 효과를 활용하지 못한다는 한계가 있다.

이에 저자들은 DQN, DDQN, DRQN의 장점을 결합한 새로운 모델, 즉 Deep Recurrent Double Q‑Learning(DRDQN)을 제안한다. 모델 구조는 다음과 같다. 입력 프레임은 3개의 2D 컨볼루션 레이어(8×8‑stride4, 64필터; 4×4‑stride2, 64필터; 3×3‑stride1, 64필터)를 통과해 공간적 특징을 추출한다. 이후 512‑유닛 Dense 레이어와 tanh 활성화 함수를 갖는 LSTM(512)으로 시계열 정보를 통합한다. 마지막 단계에서는 128‑유닛 ReLU Dense와 액션 수에 맞는 Linear 출력 레이어가 배치되어 Q값을 예측한다. 이 구조는 Chen et al.이 제안한 DQRN을 기반으로 하면서, LSTM 앞에 추가 Dense 레이어를 삽입해 특징 표현을 강화한 것이 특징이다.

Double Q‑Learning은 두 개의 파라미터 집합 θ와 θ′를 유지한다. 행동 선택은 현재 네트워크 θ를 사용하고, 타깃 Q값은 θ′가 생성한다. 구체적인 타깃 업데이트 식은

Yₜ = Rₜ₊₁ + γ Q(Sₜ₊₁, argmaxₐ Q(Sₜ₊₁, a; θ); θ′)

이며, 이는 기존 DDQN과 동일하지만 LSTM을 포함한 시퀀스 전체에 적용한다. 이를 통해 시계열적 보상 구조를 보다 정확히 반영하고, Q값 과대평가를 억제한다.

학습 과정에서는 900 000 크기의 경험 재플레이 버퍼와 32 크기의 미니배치를 사용한다. 초기 50 000 프레임은 버퍼가 충분히 채워질 때까지 학습을 시작하지 않으며, 매 4 스텝마다 학습을 수행한다. 학습률은 2.5 × 10⁻⁴, RMSProp 옵티마이저, 할인 인자 γ=0.99, ε‑greedy 탐색은 850 000 프레임에 걸쳐 1.0→0.1 로 감소한다. 이러한 하이퍼파라미터는 기존 DQN 설정을 그대로 따르면서, LSTM 학습 특성에 맞게 탐색 단계가 길게 설계되었다.

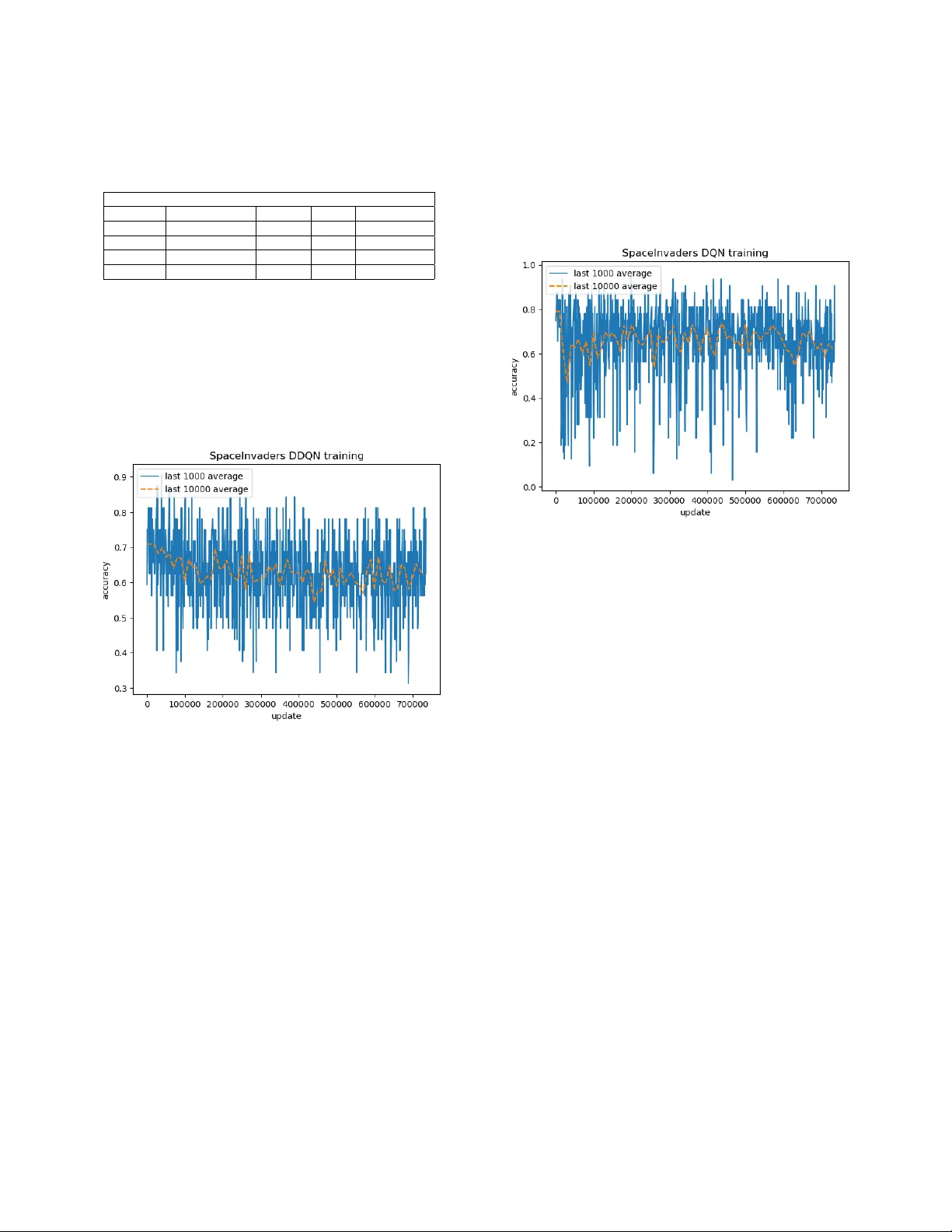

실험은 Atari Learning Environment(ALE)를 이용해 Space Invaders, Enduro, Pong, Beam Rider 네 가지 게임에서 진행되었다. 각 모델을 1천만 프레임(≈10 M) 학습시킨 뒤, 최종 점수를 비교하였다. 결과는 다음과 같다. DQN은 Space Invaders 1 450점, Enduro 1 095점, Pong 65점, Beam Rider 349점을 기록했으며, DRQN은 Space Invaders 1 680점, Enduro 885점, Pong 39점, Beam Rider 594점을 얻었다. DDQN은 각각 2 230점, 1 283점, 44점, 167점을 기록했고, 제안된 DRDQN은 Space Invaders 2 450점, Enduro 1 698점, Pong 74점, Beam Rider 876점으로 모든 게임에서 최고 성능을 보였다. 특히 Enduro와 Beam Rider처럼 장기적인 전략이 중요한 게임에서 Double Q‑Learning과 순환 구조의 시너지 효과가 두드러졌다.

논문은 또한 인간 전문가와의 점수 비교를 통해 학습된 에이전트가 인간 수준에 근접함을 시각화하였다(그림 5, 6). 그러나 하드웨어 제약(NVIDIA GTX 950, 2 GB VRAM)으로 인해 더 큰 네트워크나 더 긴 시퀀스 학습이 제한되었으며, 게임 간 행동 패턴 유사성을 정량화하지 못한 점을 한계로 제시한다. 향후 연구에서는 클러스터링 기반 메타‑학습을 도입해 게임을 유사 그룹으로 묶고, 각 그룹에 최적화된 네트워크 구조를 적용하는 방안을 제안한다.

결론에서는 DRDQN이 DQN, DDQN, DRQN 각각의 장점을 결합해 특정 Atari 게임에서 성능을 크게 향상시켰음을 강조한다. 또한 다양한 게임에 대해 하나의 모델이 최적이 아니라는 점을 인식하고, 게임 특성에 맞는 네트워크 설계와 하이퍼파라미터 튜닝이 필요함을 언급한다. 마지막으로, 공개된 코드와 하이퍼파라미터 표를 통해 재현성을 보장하고, 향후 더 복잡한 환경(예: 3D 시뮬레이션, 로봇 제어)에도 확장 가능성을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기