음성 음소 공동 임베딩 학습

본 논문은 음성 신호와 해당 단어의 음소 표기 사이를 연결하는 공동 임베딩 공간을 학습한다. 변수 길이의 음성 스펙트로그램과 원-핫 음소 시퀀스를 각각 인코딩한 뒤, 대조 손실과 하드 네거티브 마이닝을 활용해 256 차원 벡터로 매핑한다. 이 모델은 이진 분류 과제를 통해 유사도 임계값을 학습하며, 최종 F1 점수 0.95를 달성한다.

저자: Mohamed El-Geish

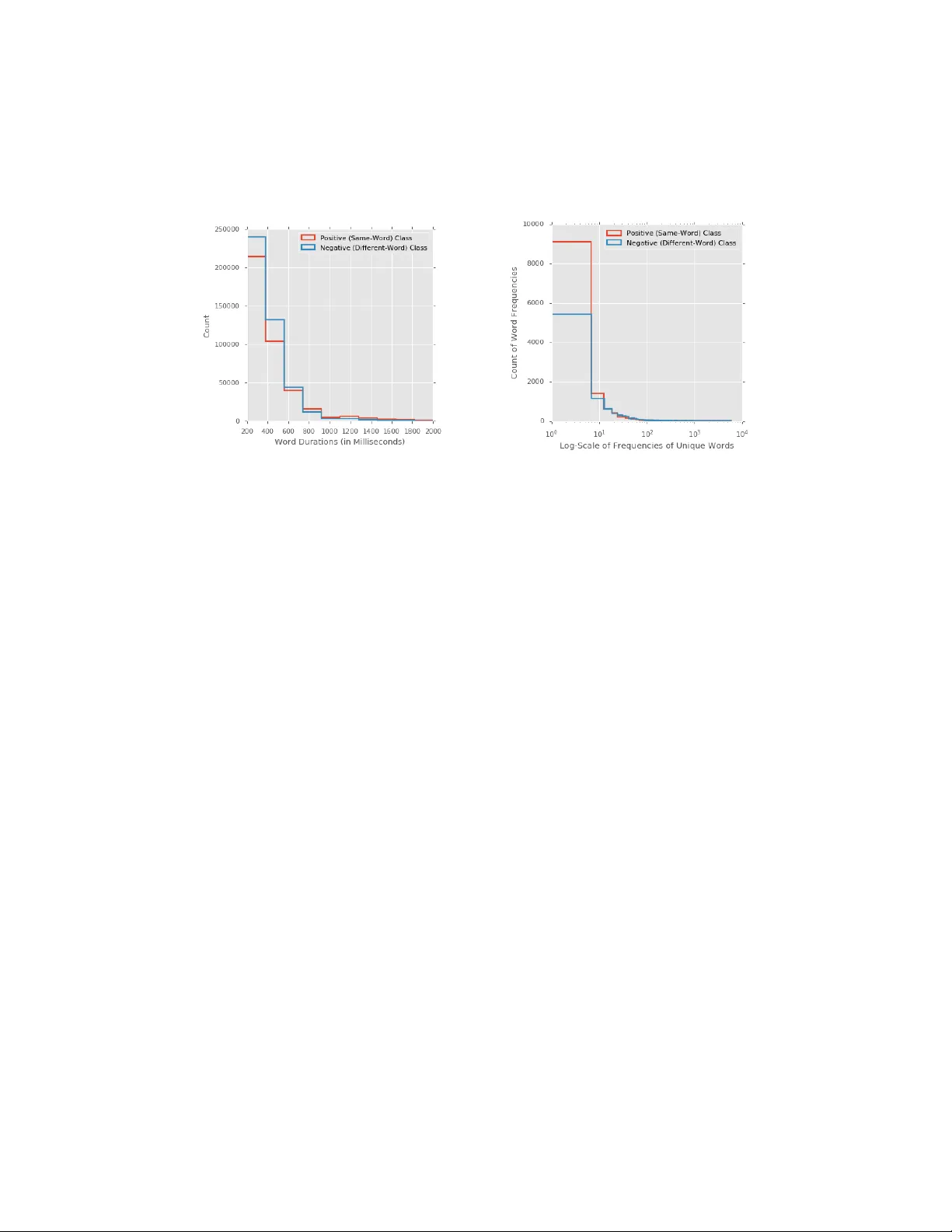

본 연구는 음성 신호와 해당 단어의 음소 표기 사이의 유사성을 정량화할 수 있는 공동 임베딩 공간을 구축하는 것을 목표로 한다. 데이터는 25 k개의 16 kHz 단일 채널 녹음과 그에 대응하는 전사본으로 구성되며, 전사는 강제 정렬을 통해 인간 전사와 ASR 가설이 일치하는 경우에만 양성 쌍으로 라벨링된다. 음소 표기는 LibriSpeech 사전의 ARPAbet 표기를 사용해 원-핫 인코딩했으며, 최대 20개의 음소와 70개의 심볼(빈 심볼 포함)로 표현한다. 음성 입력은 2 초 길이로 패딩된 멜‑스펙트로그램(64 × 161 × 1)으로 변환하고, 개별 샘플마다 평균·분산 정규화를 수행한다.

모델은 Siamese 구조를 채택해, 음성 인코더와 음소 인코더가 각각 입력을 256 차원 L2 정규화 벡터로 매핑한다. 인코더는 주로 3 × 3 커널을 갖는 2개의 컨볼루션 레이어와 풀링, 그리고 전결합 층으로 구성된 CNN이며, 동일한 구조를 음소 인코더에도 적용했다. 출력 벡터 간 거리는 코사인 혹은 유클리드 거리로 계산되며, 대조 손실(L_contrast) 형태로 최적화한다. 손실 함수는 양성 쌍에 대해 거리 제곱을 최소화하고, 음성 쌍에 대해 마진 m(기본값 1) 이하일 경우 거리 차이를 벌리는 형태다.

핵심적인 학습 전략은 하드 네거티브 마이닝이다. 첫 번째 단계에서는 양성 쌍을 기반으로 동일 음성에 대해 서로 다른 ASR 가설을 선택해 음성‑음소 불일치(음성‑음소 거리 1)로 라벨링한다. 이때 약 73 k개의 네거티브가 생성된다. 두 번째 단계에서는 이러한 네거티브 쌍의 음소 편집 거리를 계산해 0.7 이하인 경우를 추가로 추출해 총 439 k개의 네거티브를 확보한다. 세 번째 단계는 셀프‑라벨링으로, 매 epoch마다 현재 모델이 오분류한 새로운 하드 네거티브를 데이터에 삽입한다. 이 과정은 학습 초기에 과도한 노이즈를 방지하면서도, 전체 학습 데이터 규모를 876 k개까지 확대시켰다.

실험에서는 다양한 아키텍처와 하이퍼파라미터를 비교했다. CNN 기반 모델이 가장 우수한 성능을 보였으며, 특히 2개의 컨볼루션 블록(3 × 3 × 64 → 3 × 3 × 64)과 2개의 전결합 층, 드롭아웃 0.4, 배치 크기 128, 64 epoch 학습 후 테스트 F1 점수 0.95를 달성했다. LSTM 기반 모델은 학습 시간은 길었지만 F1 점수가 0.91에 그쳤다. 또한 마진을 음소 편집 거리로 설정하거나 가중치 최대 노름을 제한하는 등 여러 변형을 시도했지만, 기본 마진과 가중치 제약이 가장 안정적이었다.

성능 평가는 이진 분류의 F1 점수를 사용했으며, 테스트 단계에서는 거리 임계값 0.5를 적용해 라벨을 결정했다. 전체 테스트 셋에 대해 약 192.6 M개의 가능한 음성‑음소 쌍을 생성해 평가했으며, 최종 모델은 0.95의 F1 점수를 기록했다. t‑SNE 시각화에서는 의미 있는 군집이 형성되었고, “cat:cool :: pat:pool”과 같은 음소 유사성 관계가 발견되었다. 오류 분석 결과, 노이즈, 저음량, 억양, 리버브 등 음성 품질이 낮은 경우 오분류가 빈번했으며, 향후 전처리 및 다양한 억양 데이터 확보가 필요함을 제시한다.

결론적으로, 이 논문은 약한 감독 하에 음성‑음소 공동 임베딩을 학습하는 효과적인 프레임워크와, 하드 네거티브 마이닝 및 셀프‑라벨링을 통한 데이터 증강 방법을 제시한다. 제안된 모델은 ASR 재랭킹, 키워드 스포팅, 쿼리‑바이‑예시 검색 등 다양한 음성 처리 응용에 바로 활용 가능하며, 향후 다중 길이 버킷 모델링, 다른 손실 함수 탐색 등으로 성능을 더욱 향상시킬 여지가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기