멀티채널 CNN 기반 일괄형 음성 인식: 가정 환경에서의 실시간 성능 향상

본 논문은 가정 내 다중 화자와 가전 소음이 섞인 실생활 대화를 대상으로, 잔여 잡음과 채널 불일치를 극복하기 위해 잔차 연결과 배치 재정규화를 적용한 멀티채널 CNN 인코더와 CTC‑Attention 결합 모델을 제안한다. CHiME‑5 데이터셋에서 단일 채널 대비 8.5% 절대 WER 감소, 기존 LF‑MMI TDNN 대비 0.6% 절대 개선을 달성하였다.

저자: Nelson Yalta, Shinji Watanabe, Takaaki Hori

본 논문은 가정 내 일상 대화에서 발생하는 다중 화자와 가전 기기의 배경 소음, 그리고 원거리 마이크에 의한 저신호대비(SNR 5~20 dB) 문제를 해결하고자, 멀티채널 입력을 직접 처리할 수 있는 CNN 기반 end‑to‑end 음성 인식 시스템을 제안한다. 연구 배경으로는 CHiME‑5 챌린지가 제시하는 ‘실제 가정 환경에서의 대화 인식’이라는 어려운 과제가 있다. 기존의 CHiME‑5 최고 성능 시스템들은 전통적인 ASR 파이프라인에 다채널 잡음 제거 및 Beamforming을 적용했으며, end‑to‑end 접근은 거의 시도되지 않았다.

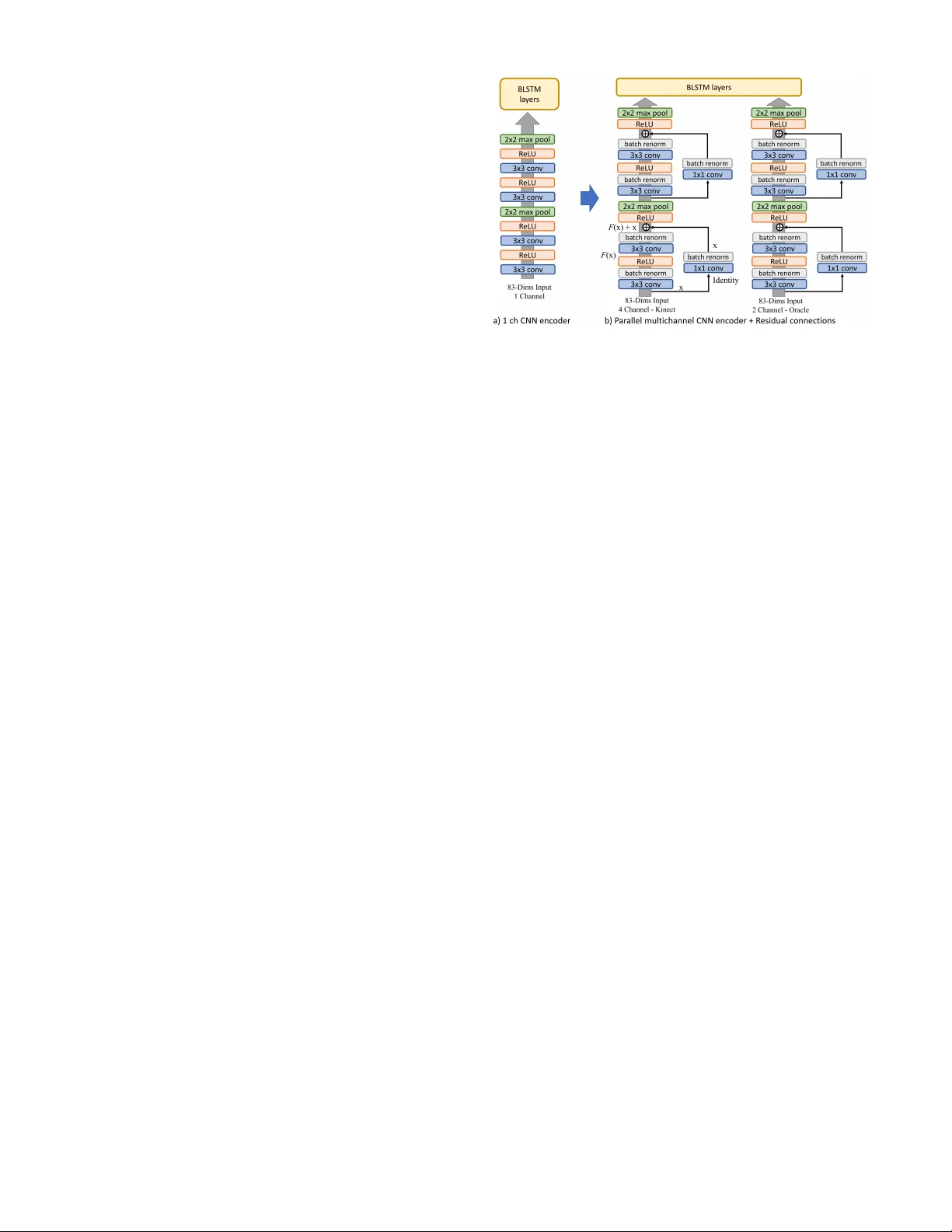

제안된 시스템은 크게 네 부분으로 구성된다. 첫째, **병렬 멀티채널 CNN 인코더**는 Kinect 배열(4채널)과 바이노럴 마이크(2채널)의 스펙트로그램을 각각 별도의 CNN 스트림으로 처리한 뒤, 최종 레이어에서 결합한다. 이렇게 하면 훈련 단계에서 ‘깨끗한’ 바이노럴 데이터와 ‘노이즈가 섞인’ Kinect 데이터가 동시에 학습되어, 모델이 다양한 채널 조합에 강인해진다. 둘째, **잔차 연결**을 3‑layer 블록에 적용해 깊은 CNN 구조에서도 그래디언트 흐름을 원활히 하고, 학습 수렴 속도를 높였다. 셋째, **배치 재정규화**는 미니배치가 작을 때 발생하는 평균·분산 편차를 보정함으로써, 특히 40 h라는 제한된 훈련 데이터에서 안정적인 학습을 가능하게 했다. 넷째, **다단계 언어 모델**(character‑based RNN‑LM + word‑based RNN‑LM) 을 디코딩 단계에 도입해 OOV 문제를 완화하고, 긴 문맥에 대한 언어적 제약을 강화했다.

모델의 핵심 학습 프레임워크는 **joint CTC‑Attention**이다. CTC 손실은 프레임‑레벨 정렬을 제공해 빠른 초기 수렴을 돕고, Attention 디코더는 조건부 독립성을 없애며 전체 시퀀스에 대한 의존성을 학습한다. 두 손실을 λ 파라미터(실험에서는 0.1)로 가중합해 멀티태스크 학습을 수행했으며, 디코딩 시에도 CTC 점수를 보조적으로 사용해 최종 출력의 정확성을 높였다.

실험은 ESPnet 툴킷(Chainer 백엔드) 위에서 진행됐으며, 두 주요 코퍼스인 **CHiME‑5**(40 h 훈련, 4 h 개발, 5 h 평가)와 **AMI**(78 h 훈련, 9 h 개발·평가)를 사용했다. CHiME‑5 단일 배열 트랙에서는 기존 단일 채널 CNN‑Encoder 기반 모델(94.7% WER) 대비 9.7% 절대 감소, LF‑MMI TDNN(86.6%) 대비 1.6% 절대 개선을 달성했다. 병렬 인코더만 적용했을 때도 85.4%→85.0% 수준으로 소폭 개선되었으며, 잔차와 배치 재정규화를 추가했을 때 각각 0.3%·0.1%의 추가 절감 효과가 관찰되었다. AMI 데이터에서도 동일한 구조가 8채널 MDM 배열과 1채널 IHM을 병렬로 학습시켜, WER를 45.3%→43.2%(dev) 및 54.9%→49.0%(eval)으로 낮추었다.

결과적으로, **멀티채널 CNN 인코더 + 잔차 연결 + 배치 재정규화 + 다단계 LM**이라는 네 가지 기술적 요소가 결합된 end‑to‑end ASR 시스템은 저자원·저신호대비 환경에서 기존 모델들을 능가한다는 것을 입증한다. 논문은 또한 데이터 증강(화이트 노이즈 삽입)과 병렬 인코더 설계가 모델의 일반화에 크게 기여함을 강조한다. 향후 연구에서는 다채널 Beamforming과의 결합, 실시간 스트리밍 적용, 그리고 더 큰 규모의 다중 언어 데이터셋에 대한 확장 가능성을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기