코드 중복을 활용한 콜라주 인퍼런스로 이미지 분류 지연 시간 최소화

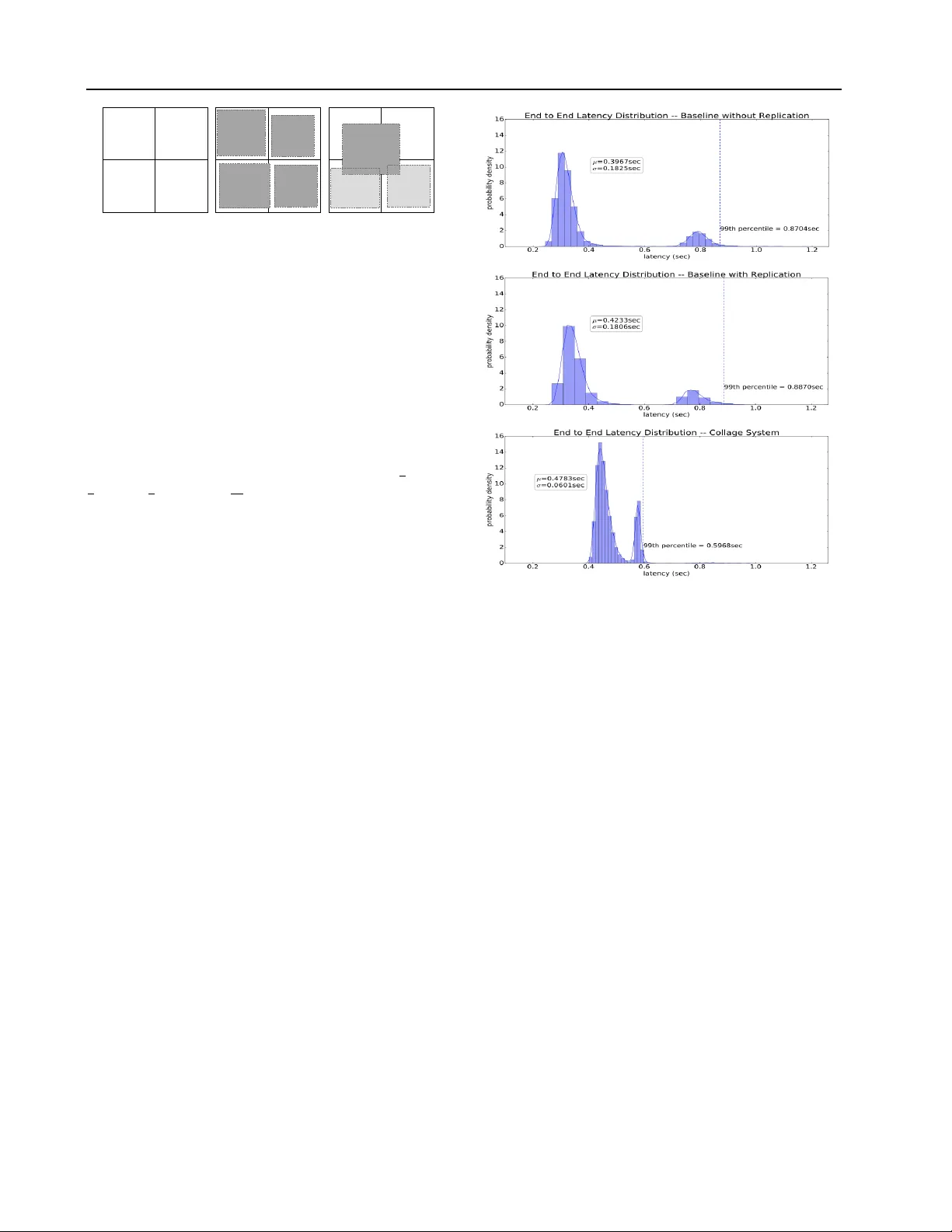

본 논문은 클라우드 기반 이미지 분류 서비스에서 발생하는 스트래글러 문제를 해결하기 위해, 여러 이미지들을 하나의 콜라주 이미지로 결합해 한 번에 예측하는 Collage‑CNN 모델을 제안한다. 기존 복제 방식의 높은 비용을 줄이고, 99번째 백분위수 지연 시간을 1.47배 개선하며, 지연 시간 변동성을 9배 감소시킨다. 정확도는 약간 감소하지만, 스트래글러 복구에 필요한 부분만 사용함으로써 전체 정확도 손실을 최소화한다.

저자: Krishna Narra, Zhifeng Lin, Ganesh Ananthanarayanan

본 논문은 클라우드 기반 머신러닝 서비스, 특히 이미지 분류와 같은 고성능 추론 작업에서 발생하는 지연 시간 변동성(tail latency) 문제를 해결하고자 한다. 스트래글러(straggler) 현상은 가상화된 클라우드 환경에서 공유 자원(CPU, 메모리, 네트워크)의 불균형으로 빈번히 발생하며, 이는 서비스 수준 협약(SLA) 위반과 비용 증가로 이어진다. 기존 연구는 두 가지 방향으로 접근한다. 첫 번째는 복제(replication) 방식으로, 요청을 미리 여러 복제본으로 실행하거나 스트래글러 감지 후 즉시 복제한다. 그러나 복제는 리소스 사용량을 크게 늘리며, 비용 효율성이 떨어진다. 두 번째는 코드 기반 중복(coded computing)으로, 연산을 분할하고 중복 코드를 삽입해 일부 작업이 지연돼도 전체 결과를 복원할 수 있게 한다. 하지만 기존 코드 기반 방법은 주로 행렬 연산이나 선형 모델에 적용돼 이미지와 같은 고차원 비구조적 데이터에는 적용이 어려웠다.

이에 저자들은 MLaaS 플랫폼의 특성을 활용한 새로운 중복 전략, ‘콜라주 인퍼런스(Collage Inference)’를 제안한다. MLaaS는 다수의 클라이언트 요청을 로드밸런서가 받아 여러 백엔드 인스턴스로 분산시키는 구조를 갖는다. 로드밸런서는 이 시점에서 여러 요청을 하나의 집합으로 보고, 각 이미지를 사전에 정의된 격자 위치에 배치해 하나의 콜라주 이미지를 만든다. 이 콜라주 이미지는 416×416 해상도로 고정되며, 각 서브 이미지의 해상도는 N(콜라주에 포함된 이미지 수)에 따라 감소한다.

콜라주 이미지를 입력으로 받는 ‘Collage‑CNN’ 모델은 기존 CNN과 동일한 구조를 사용하지만, 출력은 각 격자 위치에 대한 바운딩 박스와 클래스 라벨이다. 모델은 다중 객체 검출 방식과 유사하게 각 서브 이미지에 대한 예측을 동시에 수행한다. 디코딩 단계에서는 예측된 바운딩 박스와 원본 이미지의 실제 위치를 매칭하기 위해 Jaccard 유사도(Intersection over Union)를 계산한다. 가장 높은 유사도를 보이는 정답 박스에 예측 라벨을 할당함으로써, 스트래글러가 발생한 노드의 결과를 복구한다.

시스템 구성은 다음과 같다. N개의 S‑CNN(단일 이미지 분류기) 노드와 1개의 Collage‑CNN 노드가 존재한다. 각 요청이 들어오면 로드밸런서는 해당 이미지를 낮은 해상도로 축소하고, 정해진 격자에 삽입해 콜라주를 만든다. 이 콜라주는 별도의 노드에 전달되어 Collage‑CNN이 처리한다. 동시에 각 이미지에 대해 S‑CNN도 독립적으로 추론을 수행한다. 최종 결과는 S‑CNN들의 예측과 Collage‑CNN의 복구 예측을 결합해 사용자에게 반환된다.

실험에서는 ResNet‑34 기반 S‑CNN을 9개의 독립 노드에 배치하고, Collage‑CNN을 1개의 백업 노드로 사용했다. 데이터는 ImageNet‑1k의 100개 클래스를 사용했으며, Collage‑CNN은 9개의 이미지를 하나의 콜라주에 넣어 학습·평가했다. S‑CNN의 Top‑1 정확도는 80.72%였으며, Collage‑CNN은 76.9%로 약 4% 감소했다. 그러나 스트래글러 복구에 필요한 서브셋만 사용하면 복구 정확도는 87.86%에 달했다.

성능 평가에서는 Digital Ocean 클라우드 환경에서 엔드‑투‑엔드 지연 시간을 측정했다. 비교 대상은 (1) 복제 없음, (2) 고정 타임아웃 기반 복제, (3) 제안된 Collage‑Inference이다. 결과는 다음과 같다. Collage‑Inference는 평균 지연 시간이 약간 증가했지만, 표준편차를 3배, 분산을 9배 감소시켰다. 특히 99번째 백분위수 지연 시간은 기존 두 방법 대비 1.47배 낮았다. 이는 tail latency를 크게 완화하면서도 비용을 크게 절감한다는 점을 의미한다.

논문의 결론은 Collage‑CNN을 활용한 코드 중복이 기존 복제 방식보다 비용 효율적이며, 스트래글러에 강인한 추론 서비스를 제공한다는 것이다. 향후 연구 과제로는 Collage‑CNN 모델 자체의 정확도 향상, 콜라주 생성 오버헤드 최소화, 그리고 이미지 외 다른 데이터 타입(예: 비디오, 시계열)으로의 확장이 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기