연속학습을 위한 소리 분류, 생성형 리플레이로 데이터 저장 없이 새 클래스 습득

본 논문은 환경음 분류 작업에서 연속학습(continual learning) 문제를 다룬다. 기존 데이터 전체를 보관하지 않고도 새로운 소리 클래스를 학습하기 위해, 과거 데이터를 생성해 내는 생성형 리플레이(generative replay) 방식을 제안한다. 4 % 규모의 생성 모델만 사용해도, 과거 데이터를 20 % 보관하는 전통적 리허설(rehearsal) 방법과 동등한 정확도를 달성한다는 실험 결과를 제시한다.

저자: Zhepei Wang, Cem Subakan, Efthymios Tzinis

본 논문은 연속학습(continual learning) 환경에서 새로운 소리 클래스를 학습하면서 과거에 학습한 클래스를 잊지 않도록 하는 방법을 제안한다. 기존의 연속학습 연구는 주로 정적인 이미지 데이터를 대상으로 했으며, 시간‑주파수 구조를 갖는 음향 데이터에 대한 연구는 상대적으로 부족했다. 저자들은 이러한 공백을 메우기 위해, 과거 데이터를 직접 저장하지 않고 생성형 리플레이(generative replay) 기법을 적용한다.

연속학습의 정의와 문제점(특히 catastrophic forgetting)을 서론에서 설명하고, 두 가지 완화 전략을 소개한다. 첫 번째는 ‘naive rehearsal’이라 불리는 버퍼 방식으로, 이전 작업의 샘플을 일정 비율(p %) 저장해두고 매 학습 단계에서 함께 사용한다. 이는 구현이 간단하고 강력한 베이스라인이지만, 저장 용량이 증가하면 비용이 크게 늘어난다. 두 번째가 본 논문의 핵심인 ‘generative replay’이다. 여기서는 자동인코더(AE)와 가우시안 혼합 모델(GMM)로 구성된 생성기를 훈련한다. 자동인코더는 스펙트로그램을 저차원 잠재공간(h)으로 압축하고 복원한다. GMM은 이 잠재공간에 대한 확률분포를 모델링해, 새로운 샘플을 생성할 수 있게 한다. 학습은 두 단계로 진행된다. 첫 단계에서는 현재 작업 데이터 D_t 로 자동인코더와 GMM을 각각 학습한다. 두 번째 단계에서는 이전 작업까지 학습된 생성기 G_{t‑1} 로부터 가상 샘플을 생성하고, 현재 생성기 G_t 의 손실에 포함시켜 ‘리플레이 손실’을 최소화한다. 이렇게 하면 과거 데이터에 직접 접근하지 않아도 과거 지식을 유지할 수 있다.

실험은 ESC‑10 데이터셋(10개의 환경음, 총 9 500개의 멜‑스펙트로그램)에서 수행되었다. 데이터는 5개의 작업으로 나뉘어 각 작업마다 2개의 클래스를 새로 도입한다. 클래스는 유사한 소리끼리 묶어 난이도를 조절하였다. 스펙트로그램은 2048 샘플 윈도우, 512 샘플 홉, 128 멜‑필터를 사용해 128 × 16 크기의 입력으로 전처리되었다.

분류기 구조는 1‑D 컨볼루션 2층(64, 128 필터) + 평균 풀링 + 완전연결층 2개(50, 10 노드)이며, 최종 소프트맥스 레이어로 10‑클래스 분류를 수행한다. 생성기에는 두 가지 변형을 시험한다. 첫 번째는 일반 자동인코더(AE)와 GMM을 2‑step 방식으로 학습한 ‘AE+GMM’이다. 두 번째는 변분 자동인코더(VAE)이며, VAE는 추가적인 선형 레이어와 KL‑다이버전스 손실을 포함한다.

리허설은 p ∈ {5, 10, 20, 100}% 로 설정해 저장 비율에 따른 성능 변화를 관찰하였다. 학습 최적화는 Adam(learning rate 5e‑4 for classifier, 1e‑3 for generator), 배치 크기 100, 각 작업당 300 epoch(분류기)와 1700 epoch(생성기)로 진행되었다.

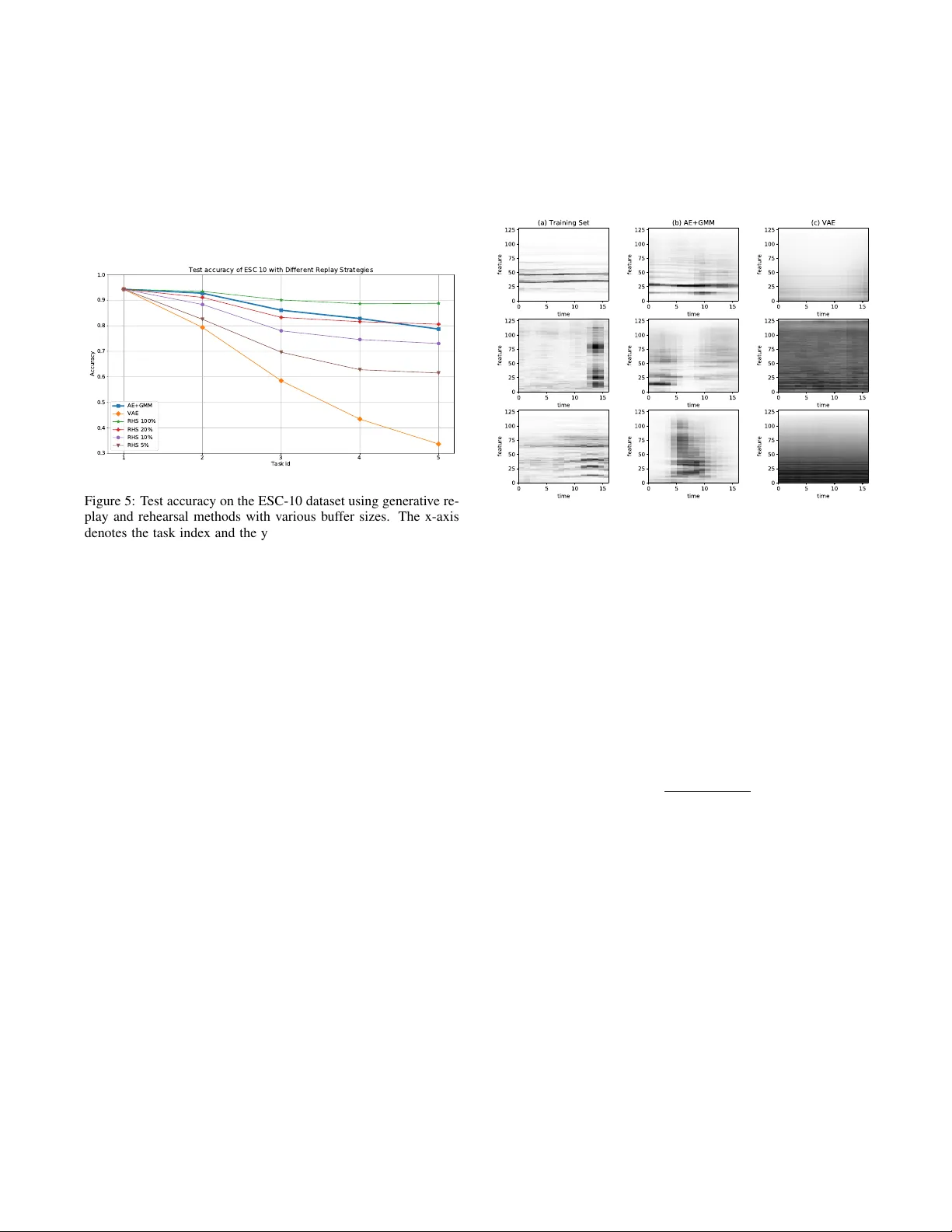

결과는 Figure 5에 요약된다. ‘AE+GMM’ 기반 생성형 리플레이는 평균 정확도가 약 78 %로, 리허설 p = 20%와 거의 동등한 성능을 보였다. ‘VAE’는 평균 정확도가 65 % 이하로, p = 5% 이하의 리허설보다도 못했다. 이는 VAE가 스펙트로그램의 시간‑주파수 구조를 충분히 보존하지 못하고, 클래스 간 구분력이 약해지는 현상으로 해석된다. 전체 데이터를 모두 보관한 리허설(p = 100%)은 상한선으로, 약 85 %의 정확도를 기록했다. 작업 수가 증가함에 따라 모든 방법에서 정확도 분산이 감소했으며, 이는 여러 순열에 걸쳐 모든 클래스를 본 뒤 모델이 안정화되기 때문이다.

논문의 주요 기여는 다음과 같다. (1) 음향 데이터에 특화된 생성형 리플레이 프레임워크를 제시하고, 자동인코더‑GMM 조합이 효과적임을 실증하였다. (2) 생성 모델의 크기가 전체 학습 데이터의 4 % 수준에 불과함에도 불구하고, 20 % 데이터를 저장하는 전통적 방법과 동등한 성능을 달성함으로써 저장 비용을 크게 절감할 수 있음을 보여준다. (3) VAE와 같은 일반적인 생성 모델이 시간‑주파수 구조를 보존하는 데 한계가 있음을 확인하고, 향후 연구에서는 보다 정교한 시계열‑전용 생성 모델(예: 흐름 기반 모델, 변형 GAN) 도입 가능성을 제시한다.

실용적인 측면에서, 제한된 저장 용량을 가진 임베디드 디바이스나 프라이버시‑중시 환경에서 지속적인 음향 인식 시스템을 구현하는 데 유용한 접근법을 제공한다. 향후 연구 과제로는 (i) 더 많은 클래스와 복잡한 환경(예: 도시 소음, 다중 소스 혼합)에서의 확장성 검증, (ii) 생성 모델 품질을 정량화하는 새로운 평가 지표 개발, (iii) 전이 학습 및 메타‑학습과 결합한 하이브리드 연속학습 전략 탐색이 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기