단어 임베딩과 구문 정보로 강화된 신경 TTS

본 논문은 음성 합성용 시퀀스‑투‑시퀀스 모델에 문자‑레벨 대신 음소, 사전 학습된 단어 임베딩, 구문 트리 정보를 동시에 입력하는 다중 입력 인코더를 도입한다. 단어와 구문 정보를 추가함으로써 모델의 일반화 능력이 향상되고, 특히 훈련 도메인과 다른 텍스트에 대해 자연스러운 발음과 적절한 억양을 제공한다. 실험 결과 MOS 점수와 인식‑가능성 지표 모두에서 기존 음소‑전용 시스템보다 유의미하게 개선된 것을 확인하였다.

저자: Huaiping Ming, Lei He, Haohan Guo

본 논문은 신경망 기반 텍스트‑투‑스피치(TTS) 시스템의 일반화 한계를 극복하기 위해, 텍스트 입력을 음소 시퀀스뿐만 아니라 사전 학습된 단어 임베딩과 구문 트리 정보라는 두 가지 고수준 언어 특징과 결합하는 ‘특징 강화(feature reinforcement)’ 방식을 제안한다. 기존 Tacotron‑2와 같은 시퀀스‑투‑시퀀스 모델은 문자 혹은 음소 수준의 입력만을 사용해 음성 파라미터를 예측했으며, 훈련 데이터가 제한적이고 도메인이 편중될 경우 아웃‑오브‑도메인 텍스트에 대해 억양·발음 오류가 발생하는 문제가 있었다.

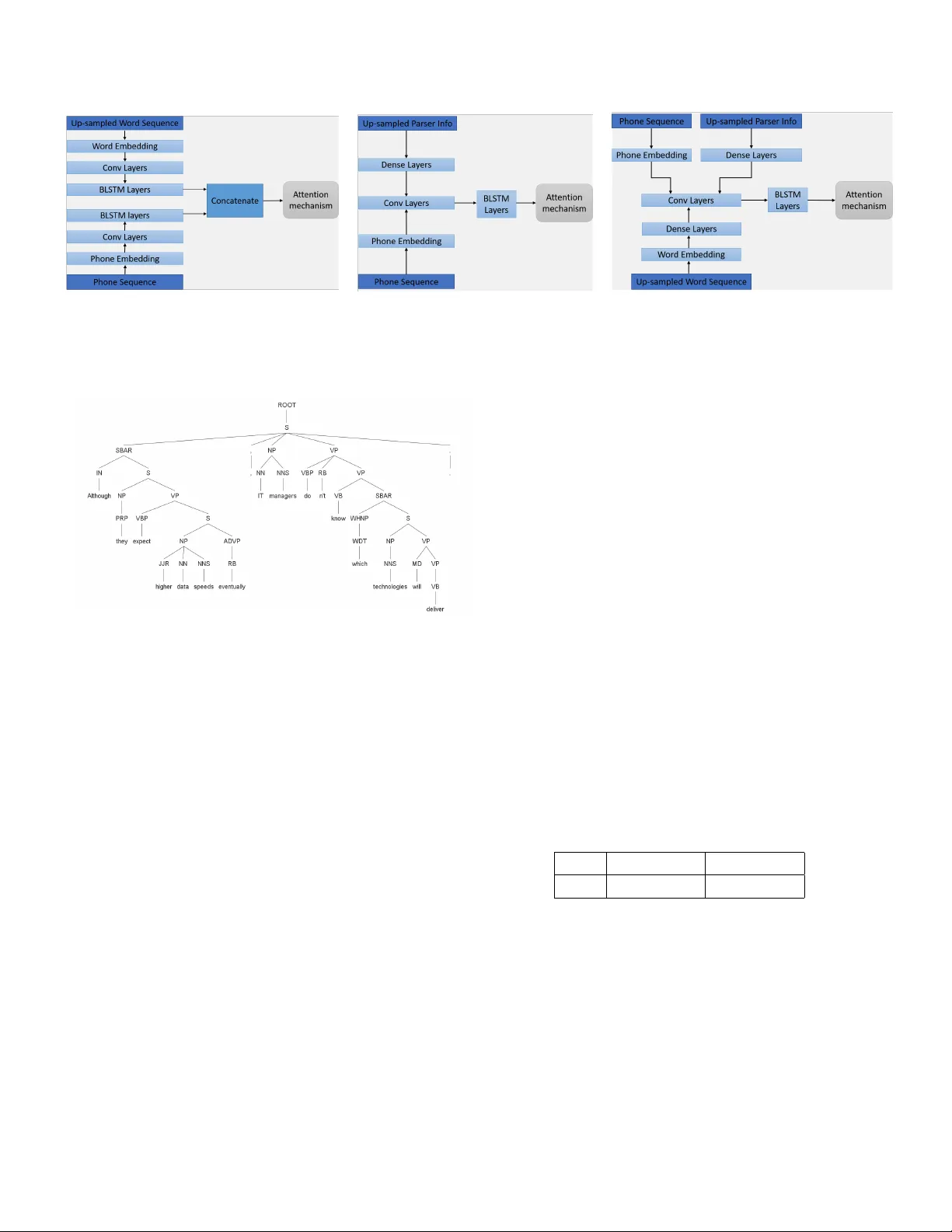

이를 해결하기 위해 저자들은 다중 입력 인코더 구조를 설계하였다. 첫 번째 입력은 표준화된 텍스트를 음소로 변환한 시퀀스로, 발음 정확성을 담당한다. 두 번째 입력은 대규모 병렬 코퍼스로 학습된 단어 임베딩이다. 이 임베딩은 NMT(Neural Machine Translation) 모델의 인코더 출력으로부터 추출되며, 의미적·문맥적 정보를 풍부하게 담고 있다. 세 번째 입력은 Stanford Parser를 이용해 얻은 구문 트리에서 추출한 구문 레이블, 구문 경계, 현재 단어의 구문 내 위치 등 문장‑레벨 구조 정보를 압축한 특징이다.

각 입력은 별도의 1‑D 컨볼루션 레이어와 양방향 LSTM(BLSTM) 레이어를 거쳐 고차원 표현으로 변환된다. 음소와 단어 임베딩은 각각의 컨볼루션‑BLSTM 블록을 통과한 뒤, 단어 임베딩은 음소 시퀀스와 시간 축을 맞추기 위해 단어당 포함된 음소 수만큼 복제(업샘플)한다. 구문 정보 역시 동일하게 업샘플되어 음소와 정렬된다. 변환된 세 종류의 특징은 최종적으로 concat 연산을 통해 하나의 통합 시퀀스로 결합되고, 이 통합 시퀀스는 동일한 어텐션 메커니즘과 디코더에 입력된다. 따라서 추가된 고수준 특징이 기존 음소‑기반 흐름을 방해하지 않으며, 어텐션이 보다 정확한 텍스트‑음성 정렬을 학습하도록 돕는다.

실험은 미국 여성 화자를 대상으로 19시간 분량의 음성 데이터를 사용해 수행되었다. 평가는 두 단계로 나뉜다. 첫 번째는 인‑도메인 텍스트(훈련 데이터와 유사한 문장) 38개에 대한 MOS 테스트로, 베이스라인 시스템이 4.41점(±0.05)을 기록했으며, 제안된 시스템은 거의 동일한 수준을 유지했다. 이는 기존 시스템이 이미 인‑도메인에서는 높은 품질을 달성하고 있음을 확인한다.

두 번째는 아웃‑오브‑도메인 텍스트(뉴스 기사 등) 30개에 대한 MOS 테스트이다. 베이스라인(음소만 사용) 점수는 4.17점으로, 녹음과의 격차가 뚜렷했다. 단어 임베딩만 추가했을 때 4.19점, 구문 정보만 추가했을 때 4.20점으로 약간의 향상이 있었으며, 두 정보를 모두 결합했을 때 4.33점으로 크게 상승했다. 이는 두 특징이 서로 보완적으로 작용해 발음·억양 품질을 동시에 개선함을 의미한다.

또한, 자동 음성 인식(ASR) 기반으로 선정한 308개의 오류 가능 문장에 대해 ‘인식 가능률’과 ‘자연스러움 비율’ 두 지표를 측정하였다. 베이스라인은 각각 88.64%와 86.36%였으며, 단어 임베딩 추가 시 95.13%·93.51%, 구문 정보 추가 시 96.10%·95.13%를 달성했다. 두 정보를 모두 사용했을 때 인식 가능률은 96.10%로 동일하지만 자연스러움 비율은 95.45%까지 상승했다. 구문 정보가 발음 오류를 줄이는 데 특히 효과적이며, 단어 임베딩과 구문 정보가 상호 보완적으로 작용한다는 결론을 얻었다.

결론적으로, 이 논문은 텍스트 전처리 단계에서 대규모 언어 모델이 제공하는 의미·구조 정보를 TTS 시스템에 직접 주입함으로써, 데이터 효율성이 낮은 상황에서도 높은 품질의 음성 합성을 가능하게 하는 실용적인 방법을 제시한다. 향후 연구에서는 감정 라벨, 화자 스타일, 혹은 멀티모달 사전 학습 모델 등 추가적인 텍스트 특징을 탐색하고, 이러한 특징을 다양한 인코더 설계와 결합해 더욱 견고하고 풍부한 음성 합성 시스템을 구축하는 방향을 제안한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기