단어 의미의 선형 대수 구조와 다의성 활용

본 논문은 현대 워드 임베딩 안에 다의어의 여러 의미가 선형적으로 중첩되어 존재한다는 가설을 제시하고, 희소 코딩을 이용해 각 의미를 추출하는 방법을 제안한다. 이를 뒷받침하기 위해 확률적 토픽(디스코스) 모델을 변형한 이론적 분석을 제공하며, 추출된 의미와 함께 약 2,000개의 “디스코스 원자”를 제공해 의미 간 연관성을 직관적으로 설명한다. 실험 결과는 제안 방법이 기존 다의어 감지 기법과 경쟁하거나 우수함을 보여준다.

저자: Sanjeev Arora, Yuanzhi Li, Yingyu Liang

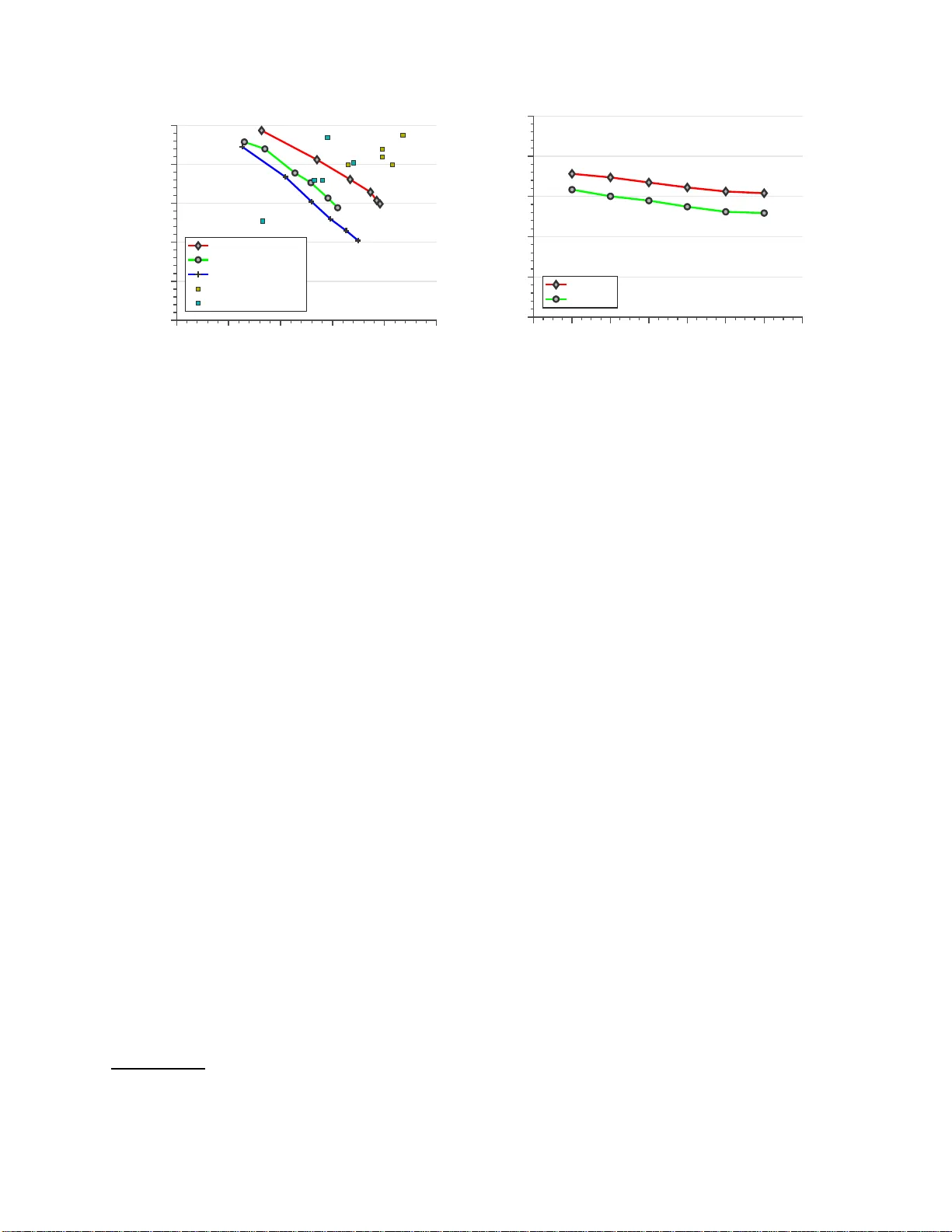

본 논문은 현대 자연어 처리에서 널리 사용되는 워드 임베딩이 다의어(Polysemy)를 어떻게 표현하는지에 대한 근본적인 질문을 다룬다. 기존 연구들은 다의어를 다루기 위해 각 의미마다 별도의 임베딩을 학습하거나, 클러스터링 기반의 Word Sense Induction(WSI) 기법을 적용해 왔지만, 이러한 접근법은 모델 복잡도 증가와 의미 간 연결성 부재라는 한계를 가지고 있다. 저자들은 이러한 문제를 해결하기 위해 두 가지 핵심 아이디어를 제시한다. 첫째, 단일 워드 임베딩 안에 여러 의미가 선형적으로 중첩되어 존재한다는 “Linearity Assertion”를 제안하고, 이를 확률적 토픽 모델인 “random walk on discourses”를 변형한 이론적 프레임워크로 증명한다. 둘째, 이 선형 구조를 활용해 희소 코딩(sparse coding) 기법을 적용, 전체 어휘에 대해 공통된 “디스코스 원자”(discourse atoms)와 각 단어의 희소한 원자 조합을 동시에 학습함으로써 의미를 자동으로 분리하고, 의미 간 연관성을 직관적으로 설명한다.

**1. 이론적 배경 및 선형성 증명**

Arora et al. (2016)의 모델을 기반으로, 논문은 디스코스 벡터 c 가 평균 0, 공분산 Σ 인 다변량 정규분포에서 샘플링된다고 가정한다. 각 단어 w 는 Pr

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기