다채널 없는 다중화자 음성 인식을 위한 퍼뮤테이션 불변 학습 확장

** 본 논문은 단일 마이크 채널만 이용해 두 명·세 명 화자의 혼합 음성을 인식하는 새로운 구조를 제안한다. 전처리 단계에서 PIT‑MSE 기반 특징 분리를, 후처리 단계에서 PIT‑CE 기반 음소 확률 추정을 각각 혹은 공동으로 최적화함으로써 라벨 순서 모호성을 해결하고, AMI 데이터셋에서 기존 단일 화자 시스템 대비 45 %·25 %의 상대적 WER 감소를 달성하였다. **

저자: Yanmin Qian, Xuankai Chang, Dong Yu

**

본 논문은 단일 채널(마이크)만을 이용해 다중 화자가 동시에 말하는 음성을 인식하는 새로운 프레임워크를 제시한다. 기존의 다중 화자 음성 인식 연구는 주로 화자‑종속, 작은 어휘, 혹은 별도의 음성 분리 단계와 복잡한 클러스터링 절차에 의존해 왔으며, 라벨 순서(퍼뮤테이션) 모호성으로 인해 학습이 불안정하거나 성능이 제한적이었다. 저자들은 이러한 한계를 극복하기 위해 퍼뮤테이션 불변 학습(PIT)의 개념을 두 가지 형태로 확장한다.

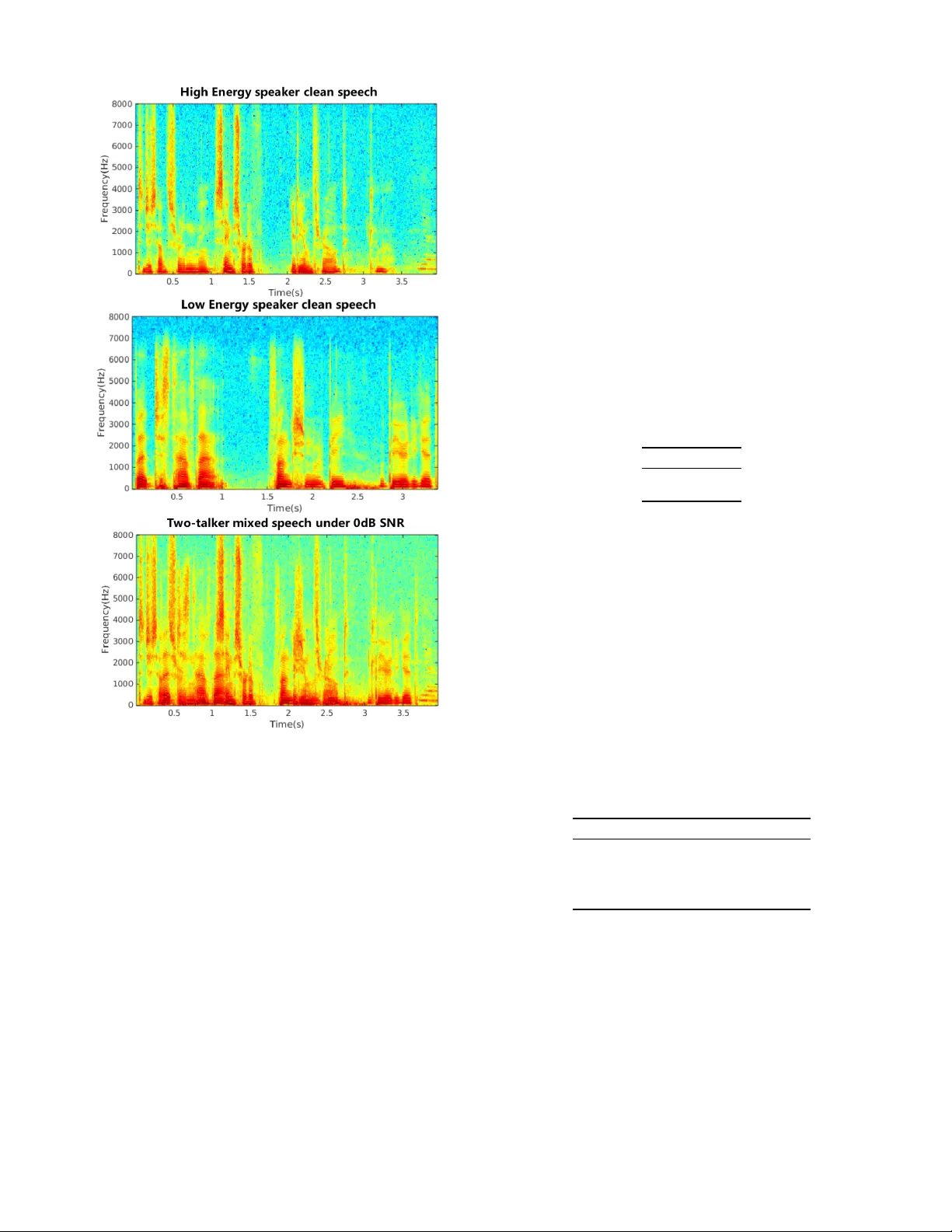

첫 번째 형태는 PIT‑MSE이다. 입력으로 혼합 음성의 로그‑필터뱅크(FBANK) 특징을 사용하고, 양방향 LSTM‑RNN을 통해 각 화자별 복원된 특징을 출력한다. 학습 시, 모든 가능한 화자‑출력 매핑(예: 2화자 경우 (1↔A,2↔B)와 (1↔B,2↔A))에 대해 평균 제곱오차(MSE)를 계산하고, 전체 발화에 대해 최소 MSE를 보이는 매핑을 선택한다. 선택된 매핑에 대해 MSE를 최소화함으로써, 프레임 단위가 아닌 발화 전체 수준에서 일관된 화자 정렬을 강제한다. 이 방법은 기존에 에너지 기반 고정 매핑을 사용하던 방식보다 화자 스위칭 오류를 크게 감소시킨다.

두 번째 형태는 PIT‑CE이다. 전처리 단계 없이 바로 혼합 음성의 특징을 입력으로 받아, 각 화자에 대한 음소(senone) 후방 확률을 출력한다. 손실 함수는 교차 엔트로피(CE)이며, 역시 전체 발화에 대해 가능한 모든 퍼뮤테이션을 평가해 최소 CE를 갖는 매핑을 선택한다. 이 접근법은 특징 분리와 인식을 별도 단계로 나누지 않음으로써, 특징 분리 오류가 인식 단계에 전이되는 문제를 회피한다.

또한, 저자들은 PIT‑MSE와 PIT‑CE를 동시에 최적화하는 공동 학습 구조를 제안한다. 앞 단계에서 화자별 특징을 분리하고, 뒤 단계에서 바로 음소 확률을 추정하도록 두 손실을 동시에 최소화한다. 이 공동 모델은 특징 분리와 인식 사이의 불일치를 최소화해, 최종 인식 정확도를 크게 향상시킨다.

실험은 인위적으로 혼합한 AMI 회의 데이터셋을 사용했다. 두 화자와 세 화자 혼합 음성 모두에 대해, 기존 단일 화자 LVCSR 시스템을 기준으로 상대적 WER 감소율을 45 %(2화자)와 25 %(3화자) 달성하였다. 특히 화자들의 에너지 레벨이 비슷할 때 성능 향상이 두드러졌으며, 이는 라벨 퍼뮤테이션 문제를 효과적으로 해결했기 때문이다.

이 논문은 다음과 같은 주요 기여를 가진다.

1. PIT를 특징 수준(MSE)과 음소 수준(CE) 모두에 적용해 라벨 순서 모호성을 근본적으로 해결하였다.

2. 전처리·후처리 단계의 공동 최적화를 통해 특징 분리와 인식 사이의 불일치를 최소화하였다.

3. 스피커‑인디펜던트·대규모 어휘·연속 음성 인식(LVCSR) 환경에서 최초로 다중 화자 인식을 성공적으로 구현하였다.

결과적으로, 이 연구는 실생활 far‑field 마이크 환경에서 다중 화자가 동시에 말하는 상황을 처리할 수 있는 실용적인 솔루션을 제공하며, 향후 음성 비서, 회의 기록, 스마트 홈 등 다양한 응용 분야에 적용될 가능성을 열어준다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기