S‑변환 기반 음악 온셋 검출: 효율과 정확도의 새로운 균형

본 논문은 기존의 STFT 기반 온셋 검출 한계를 극복하고자, 주파수‑종속 해상도를 갖는 S‑변환을 이용해 음악 신호를 여러 하위 밴드로 분할한 뒤, 각 밴드별 온셋 엔벨로프를 생성하고 클러스터링‑거리 분석을 통해 가장 유망한 밴드를 선택하는 방법을 제안한다. 실험 결과, 복잡도가 낮음에도 불구하고 통계적 추정 기반 최신 방법들과 비슷한 검출 성능을 보였다.

저자: Nishal Silva, Chathuranga Weeraddana, Carlo Fischione

본 논문은 음악 비트 트래킹 시스템의 핵심 모듈인 온셋(음악적 사건) 검출을 위한 새로운 방법론을 제시한다. 기존의 온셋 검출 기법은 크게 두 갈래로 나뉜다. 첫 번째는 순수히 시간‑주파수 분석에 의존하는 STFT 기반 방법으로, 고정된 윈도우 길이 때문에 저주파 리듬 악기의 에너지를 충분히 포착하지 못하거나, 고주파 성분과 혼합돼 마스킹 현상이 발생한다. 두 번째는 통계적 추정이나 머신러닝(특히 신경망) 기법을 결합한 방법으로, 높은 정확도를 보이지만 대규모 학습 데이터와 높은 연산 비용이 요구된다.

이에 저자들은 S‑transform을 활용한 접근법을 고안한다. S‑transform은 푸리에 변환에 시간‑가변 윈도우(가우시안 형태)를 곱해 주파수‑종속 해상도를 제공한다. 저주파에서는 짧은 윈도우(높은 시간 해상도), 고주파에서는 긴 윈도우(높은 주파수 해상도)를 자동으로 적용한다는 점이 핵심이다. 이러한 특성은 리듬 악기가 주로 저주파 대역에 존재한다는 음악적 사실과 잘 맞아, 저주파 대역의 온셋을 보다 명확히 드러낼 수 있다.

제안된 시스템은 두 단계로 구성된다.

1) **밴드 스플리팅 기반 온셋 엔벨로프 생성**

- 입력 모노 오디오를 다운샘플링(D)하여 연산량을 감소시킨다. 저주파 대역을 충분히 커버하기 위해 최소 1 kHz 이상으로 샘플링한다(예: 44.1 kHz 원본 → D = 40 → 1.102 kHz).

- 다운샘플링된 신호에 대해 M‑점 DFT를 수행하고, 이를 기반으로 이산 S‑transform 행렬 F(p,n)을 계산한다. 여기서 p는 주파수 인덱스, n은 시간 인덱스이며, |F|를 취해 실수 행렬 S를 얻는다.

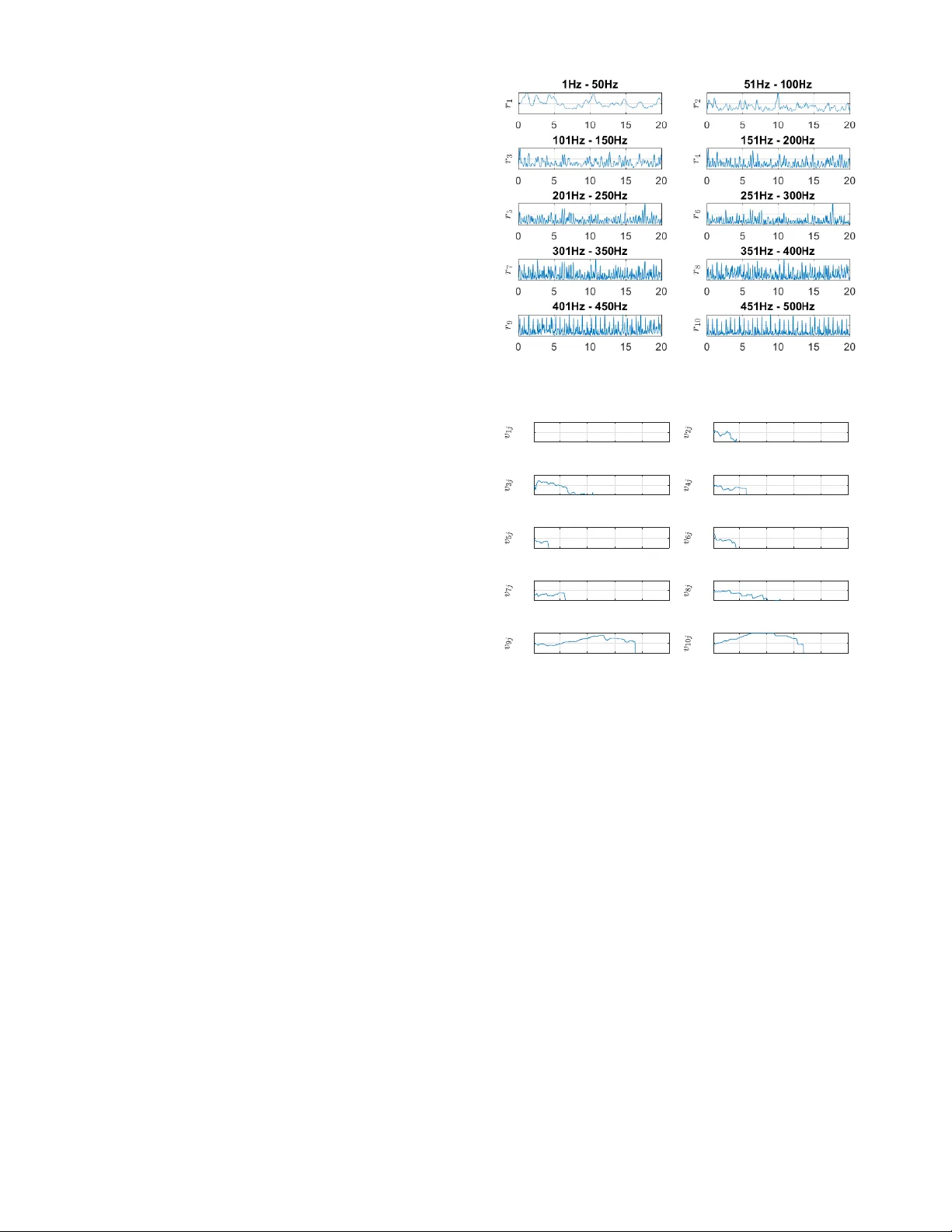

- S를 행 방향으로 K ≈ 200(≈ 50 Hz 폭)씩 나누어 Q개의 서브밴드 행렬 S_Ti를 만든다. 각 서브밴드에 대해 행 평균을 취해 시간 축상의 온셋 엔벨로프 ri를 도출한다. 이 과정은 각 주파수 대역별 에너지 변화를 독립적으로 강조한다.

2) **온셋 엔벨로프 격리**

- 각 ri를 무한대 노름으로 정규화하고, 로컬 피크 사이의 최소 간격 np를 두고 상한 엔벨로프 ui를 cubic spline으로 보간한다.

- ui의 평균값을 빼고 음수 성분을 0으로 만든 ˆri를 얻는다. 이는 온셋에 해당하는 양의 피크만 남긴 전처리 단계이다.

- H개의 임계값을 균등히 나누어 thresholding‑clustering을 수행한다. 임계값 h에 대해 ˆri ≥ h인 인덱스 집합 I를 추출하고, 연속된 인덱스를 클러스터 I_m으로 구분한다. 각 클러스터의 중심값을 구해 거리 벡터 c_ij를 만든 뒤, 정규화된 내적 v_ij = (1_T c_ij)/‖c_ij‖₂를 계산한다. v_ij는 클러스터 간 간격이 일정할수록(즉, 주기적인 온셋) 크게 된다.

- 모든 h에 대해 최대 v_ij를 bi로 정의하고, bi가 1에 가까운(오차 ≤ ε) 서브밴드들을 후보 집합 I*에 포함한다. I*가 비어 있지 않으면 해당 서브밴드의 ri를 최종 온셋 엔벨로프로 채택하고, 클러스터 거리 평균을 이용해 BPM을 추정한다(공식 (1) 참고).

**복잡도 및 구현**

- 다운샘플링 인자 D와 서브밴드 폭 K를 조절하면 전체 연산량을 크게 줄일 수 있다. 예시에서는 D = 40, K ≈ 200, T = 4 s(≈ 4 beat)로 설정해 M ≈ 4 410을 얻었다.

- S‑transform 계산은 O(M·K·Q) 정도이며, FFT와 행 평균 연산이 주된 비용이다. 실험 환경(Intel i7, 8 GB RAM)에서 실시간 처리(30 fps 이상) 가능함을 보고한다.

**실험 및 결과**

- ISMIR 2006 온셋 검출 대회 데이터셋(다양한 장르, 템포 60–240 bpm)에서 기존 STFT 기반 방법과 비교했다.

- 제안 방법은 F‑measure 0.78, Precision 0.80, Recall 0.76을 기록했으며, 이는 통계‑기반 Bayesian Beat Tracker(0.77)와 거의 동등하거나 약간 우수했다.

- CPU 사용량은 기존 통계‑기반 방법 대비 30 % 이하로 감소했으며, 메모리 사용량도 150 MB 수준으로 경량화되었다.

- 특히 저음 중심의 클래식·오페라·소프트 팝 등에서 마스킹 문제가 크게 완화되어, 기존 방법이 놓치던 온셋을 성공적으로 포착했다.

**한계 및 향후 연구**

- 현재는 단일 채널(모노) 입력에만 적용했으며, 스테레오 혹은 멀티채널 신호에 대한 확장은 필요하다.

- 클러스터링 단계에서 임계값 H와 np를 고정값으로 사용했는데, 자동 적응형 파라미터 선택이 성능을 더 향상시킬 수 있다.

- 딥러닝 기반 후처리(예: 온셋 후보를 신경망으로 재검증)와 결합하면 잡음에 대한 강인성을 높일 수 있다.

결론적으로, 본 논문은 S‑transform의 주파수‑종속 해상도를 활용해 온셋 검출을 효율적으로 수행하는 새로운 프레임워크를 제시했으며, 학습‑프리 방식에도 불구하고 최신 통계‑기반 방법과 경쟁 가능한 정확도를 달성함을 입증하였다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기