음악 소스 분리를 위한 1D 컨볼루션 기반 재귀 스킵 연결 오토인코더

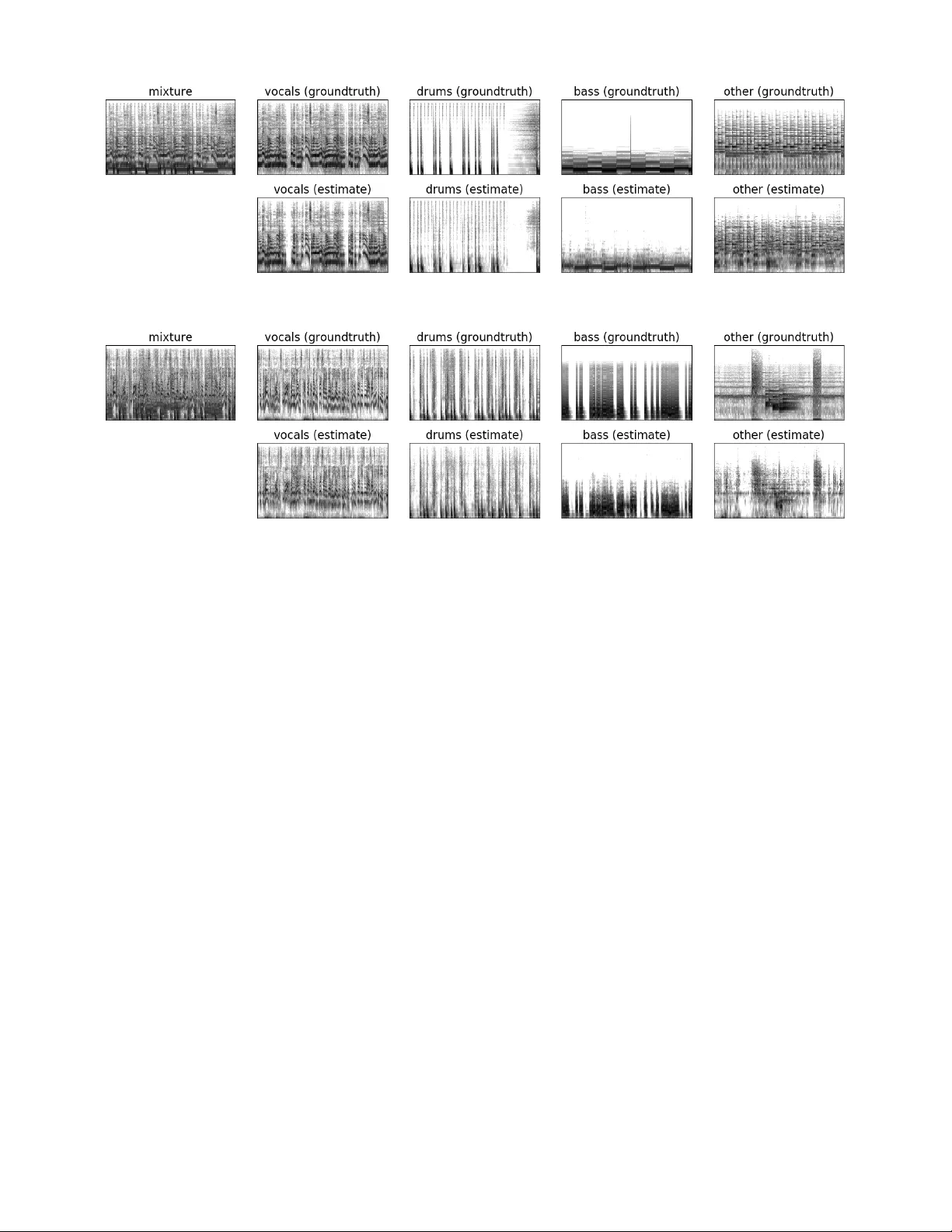

본 논문은 1차원 컨볼루션을 이용해 시간축에만 연산하는 완전 컨볼루션 네트워크에 GRU 기반 재귀 스킵 연결을 결합한 ARC 모델을 제안한다. 추가로 별도의 향상 네트워크와 잔차 회귀 방식을 도입해 분리 품질을 개선했으며, MUSDB18에서는 보컬 SDR 5.74 dB, DSD100에서는 5.91 dB를 달성하였다.

저자: Jen-Yu Liu, Yi-Hsuan Yang

**1. 연구 배경 및 목표**

음악 소스 분리는 보컬, 드럼, 베이스, 기타 악기 등을 원본 믹스에서 분리해 다양한 음악 응용에 활용되는 핵심 기술이다. 최근 컨볼루션 신경망(CNN) 기반 U‑Net 구조가 좋은 성능을 보였지만, 2D 컨볼루션은 시간‑주파수 축 모두에 연산을 수행해 순환 레이어 적용 시 차원 불일치 문제가 발생한다. 본 논문은 이러한 한계를 극복하고자 1차원(시간축) 컨볼루션을 사용해 순환 레이어와 자연스럽게 결합할 수 있는 ARC 모델을 제안한다.

**2. 모델 설계**

- **분리 모델(ARC)**: 입력은 로그 스케일(1+스펙트로그램)이며, 6개의 1D 컨볼루션 레이어와 두 개의 스킵 연결을 갖는다. 스킵 연결마다 GRU(게이트 순환 유닛)를 삽입해 인코더‑디코더 사이의 정보를 순환적으로 보강한다. 모든 컨볼루션 레이어는 가중치 정규화와 Leaky ReLU(α=0.01)를 사용한다.

- **향상 모델**: ARC 출력(각 소스별 스펙트로그램)을 입력으로 하는 별도 디노이징 오토인코더이며, 스킵 연결을 단순 컨볼루션으로 구현한다. 소스마다 독립적인 향상 모델을 학습해 작은 잡음·아티팩트를 감소시킨다.

- **잔차 회귀(Residual Regression)**: ARC 자체를 반복 호출한다. i번째 반복에서는 이전 반복의 누적 출력과 원본 믹스를 함께 입력하고, 현재 모델이 예측한 잔차를 누적한다. 전체 손실은 모든 반복의 평균 MSE이다.

**3. 학습 및 데이터 전처리**

MUSDB18 데이터셋(100곡 훈련, 50곡 테스트)을 사용해 90곡을 훈련, 10곡을 검증으로 분리한다. 5초 길이의 클립을 STFT(윈도우 2048, 홉 1024)로 변환하고, 온라인 데이터 증강을 통해 각 소스의 클립을 무작위로 조합해 새로운 믹스를 만든다. 손실은 로그 스펙트로그램에 대한 MSE이며, Adam 옵티마이저를 사용한다. 학습률은 컨볼루션 0.001, GRU 0.0001로 설정해 그래디언트 폭발을 방지한다.

**4. 실험 결과**

- **스킵 연결 비교**: 스킵 연결이 없을 때 보컬 SDR 4.41 dB, 전체 10.74 dB였으며, 재귀 스킵 연결을 적용한 JY1이 5.57 dB / 11.81 dB로 가장 높은 성능을 보였다.

- **향상·잔차 회귀 효과**: JY2(향상 모델)에서는 보컬 SDR 5.69 dB, 전체 11.90 dB, JY3(잔차 회귀 3회)에서는 5.74 dB / 12.08 dB를 달성했다. 이는 각각 향상 모델과 잔차 회귀가 독립적으로 성능을 끌어올림을 의미한다.

- **GRU 위치 실험**: GRU를 스킵 연결에 삽입한 경우가 다른 위치(예: TConv4 출력 뒤)보다 일관적으로 높은 SDR을 기록했다.

- **정규화 비교**: 가중치 정규화와 배치 정규화 모두 비슷한 SDR을 보였지만, 청감적으로는 가중치 정규화가 잡음 감소에 유리했다.

- **DSD100 평가**: 추가 학습 데이터 없이 ARC(가중치 정규화)만 적용했을 때 보컬 SDR 5.91 dB를 기록, MMDenseNet·MMDenseLSTM에 근접한 성능을 보였다.

**5. 결론 및 향후 연구**

ARC는 1D 컨볼루션과 GRU 기반 재귀 스킵 연결을 결합해 시간‑주파수 정보를 효율적으로 모델링하고, 향상 모듈·잔차 회귀를 통해 작은 아티팩트까지 정밀하게 제거한다. 실험 결과는 기존 2D‑CNN 기반 방법과 비교해 경쟁력 있는 성능을 입증한다. 향후에는 스타일 전이, 멜로디 추출, 악기 인식, 가사 전사 등 다양한 음악 정보 처리 작업에 ARC를 확장 적용하는 방안을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기