다국어 저자원 음성인식을 위한 단일 트랜스포머 모델

본 논문은 저자원 언어들을 대상으로, 발음 사전을 사용하지 않고 BPE 기반 서브워드 단위를 이용한 단일 트랜스포머 모델을 제안한다. 언어 정보를 입력 서열의 앞·뒤에 삽입하거나 시작 토큰으로 활용해 언어 혼동을 감소시켰으며, CALLHOME 6개 언어 실험에서 기존 SHL‑MLSTM‑Residual 대비 평균 10.5%~12.4%의 WER 감소를 달성하였다.

저자: Shiyu Zhou, Shuang Xu, Bo Xu

본 논문은 저자원 언어들을 대상으로 하는 다국어 자동 음성인식(ASR) 시스템을 단일 트랜스포머 모델 하나로 구현하는 방법을 제시한다. 전통적인 다국어 ASR은 CD‑DNN‑HMM이나 SHL‑MLSTM과 같이 언어별 발음 사전과 별도의 소프트맥스 레이어에 의존해 왔으며, 이는 발음 사전이 부실하거나 존재하지 않는 저자원 언어에 적용하기 어려운 문제점이 있었다. 이러한 한계를 극복하기 위해 저자들은 (1) 발음 사전 없이도 학습 가능한 서브워드 단위, (2) 대규모 고자원 언어(영어)에서 사전 학습된 트랜스포머 모델을 초기 가중치로 활용, (3) 언어 정보를 디코더 입력에 삽입하는 두 가지 방식을 도입하였다.

먼저 서브워드 단위는 Byte‑Pair‑Encoding(BPE) 알고리즘을 사용해 다국어 코퍼스를 통합해 만든다. 각 언어의 텍스트를 하나의 대형 어휘 집합으로 병합함으로써, 동일 어근을 공유하는 언어들 간에 토큰을 재사용할 수 있다. 예를 들어 “university”와 독일어 “Universitätsgebäude”는 “univer@@”와 “sit@@”와 같은 서브워드가 겹쳐, 언어 간 전이 학습을 촉진한다. BPE 병합 횟수 α는 실험을 통해 다국어 설정에서는 3000(전체 8062 토큰)으로 설정했으며, 이는 각 토큰이 충분히 학습될 수 있는 규모를 유지한다.

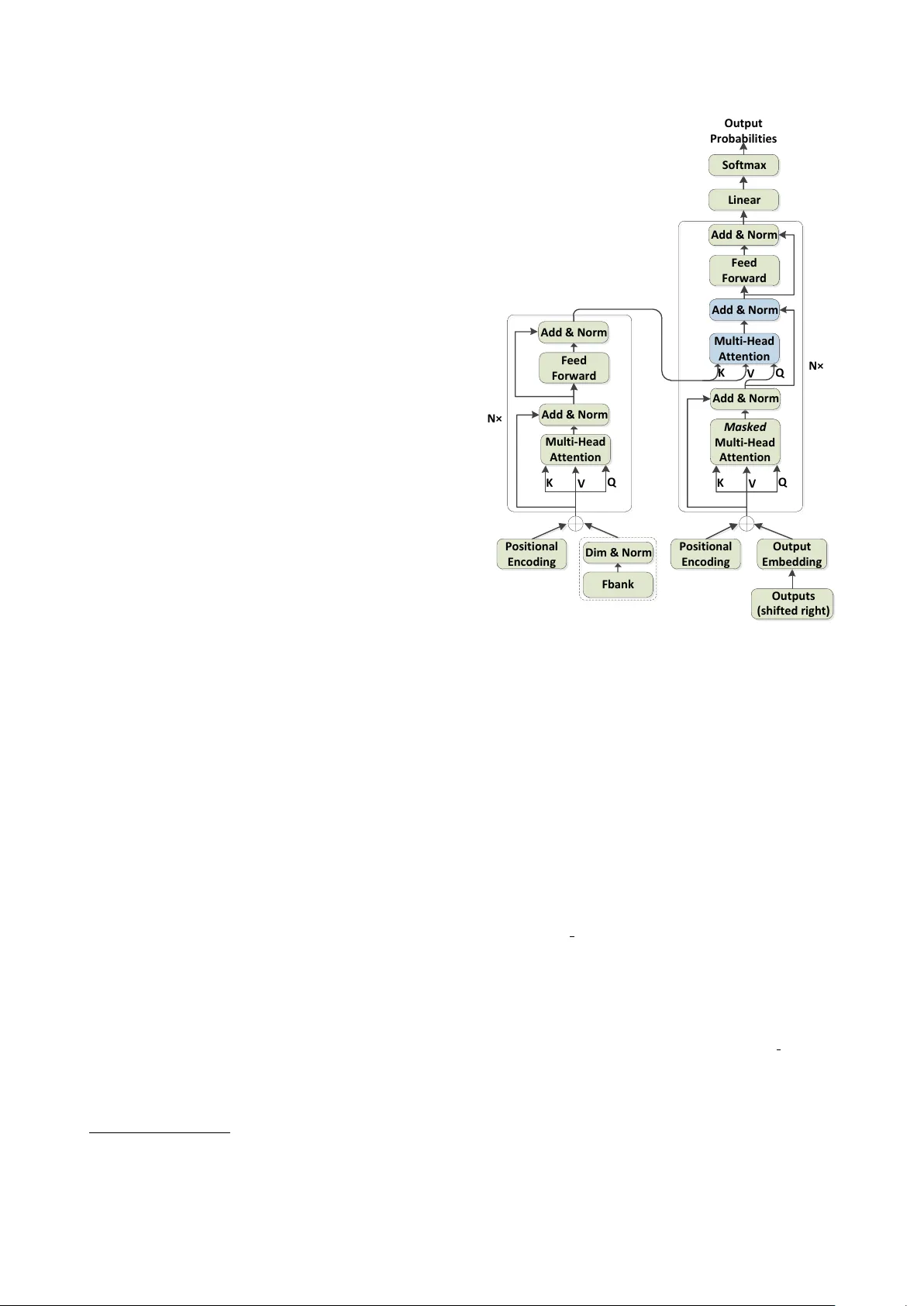

모델 아키텍처는 기존 ASR 트랜스포머와 동일하게, 인코더와 디코더에 각각 N개의 동일 레이어를 쌓고, 멀티‑헤드 어텐션(MHA)과 포지셔널 피드‑포워드 네트워크를 사용한다. 인코더 입력은 80 dim 로그‑멜 필터뱅크를 선형 변환해 모델 차원(d_model=1024)과 맞춘 뒤, 포지셔널 인코딩을 더한다. 디코더는 자기‑어텐션에 마스크를 적용해 자동 회귀성을 보장한다.

학습 초기화는 핵심적인 전략이다. 저자들은 먼저 영어 데이터(대규모)로 사전 학습된 트랜스포머(파라미터 약 230 M)를 확보하고, 이를 저자원 언어 학습의 시작점으로 사용한다. 이후 각 언어별 소프트맥스 레이어만 무작위 초기화해 교체함으로써, 대규모 파라미터가 이미 학습된 상태에서 언어 특화 출력만 새롭게 학습하도록 설계했다. 이 방식은 저자원 데이터가 부족한 상황에서도 빠른 수렴과 높은 성능을 가능하게 한다.

언어 정보를 모델에 통합하는 방법은 두 가지이다. 첫 번째는 언어 심볼을 출력 서열의 앞에 삽입하는 “Transformer‑B” 방식이다. 이 경우 디코더는 먼저 언어 심볼을 예측하고, 그 뒤에 실제 텍스트 토큰을 생성한다. 두 번째는 언어 심볼을 서열의 뒤에 삽입하는 “Transformer‑E” 방식이다. 여기서는 디코더가 전체 텍스트를 생성한 뒤 마지막에 언어 심볼을 출력한다. 두 방법 모두 학습 시에만 언어 라벨이 필요하고, 테스트 시에는 모델이 자체적으로 언어 심볼을 예측한다. 실험 결과, “Transformer‑E”가 “Transformer‑B”보다 약간 낮은 WER(0.03% 차이)을 보이며, 언어 심볼이 디코딩 과정의 마지막에 제공될 때 언어‑특정 컨텍스트가 더 효과적으로 활용된다는 점을 시사한다.

또한 테스트 단계에서도 언어 정보를 사전에 알 수 있는 경우, 언어 심볼을 시작 토큰으로 사용하는 “Transformer‑B2”를 적용했다. 이 경우 디코더는 처음부터 목표 언어를 고정하고 텍스트를 생성하므로, 특히 짧은 발화에서 발생하는 언어 혼동을 크게 감소시킨다. CALLHOME 데이터셋(6개 언어: Mandarin, English, Japanese, Arabic, German, Spanish)에서 “Transformer‑B2”는 SHL‑MLSTM‑Residual 대비 평균 12.4%의 WER 감소를 달성했으며, 특히 영어와 독일어, 일본어와 아랍어 등 발음이 유사한 언어 쌍에서 두드러진 개선을 보였다.

데이터 전처리와 학습 설정도 상세히 기술된다. 모든 음성은 80 dim 로그‑멜 필터뱅크를 25 ms 윈도우, 10 ms 스트라이드로 추출하고, 3프레임을 왼쪽으로 스택해 30 ms 프레임으로 다운샘플링한다. 또한 음성 길이를 0.9와 1.1 배로 스케일링해 데이터 양을 인위적으로 확대하였다. 최적화는 Adam(β1=0.9, β2=0.98)과 warm‑up 스케줄을 사용했으며, 라벨 스무딩(ε=0.1)과 그래디언트 클리핑을 적용했다. 학습 종료 후 마지막 20개 체크포인트를 평균해 최종 모델을 구성함으로써 성능 변동성을 최소화했다.

결과적으로, 단일 트랜스포머 기반 다국어 ASR는 (1) 사전 학습된 고자원 모델을 초기화에 활용해 저자원 언어에서도 높은 성능을 달성하고, (2) BPE 기반 서브워드 어휘가 언어 간 공유를 촉진하며, (3) 언어 심볼을 디코더 입력에 적절히 배치함으로써 언어 혼동을 효과적으로 억제한다는 세 가지 주요 기여를 입증한다. 이 연구는 저자원 다국어 음성인식 시스템 설계에 실용적인 가이드라인을 제공하며, 향후 언어 라벨이 제한적인 상황에서도 적용 가능한 확장성을 시사한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기