스트리밍 RNN Transducer 기반 엔드투엔드 음성인식 설계와 데이터 활용

본 논문은 스트리밍 가능한 RNN‑Transducer(RNN‑T) 모델을 다양한 아키텍처와 학습 전략으로 확장한다. CTC 기반 인코더와 텍스트‑전용 LSTM 언어모델을 활용한 디코더를 사전학습한 뒤, 전체 네트워크를 RNN‑T 손실로 미세조정한다. 또한 grapheme 대신 wordpiece라는 서브워드 단위를 도입해 문맥 정보를 확대하고 대체 오류를 크게 감소시켰다. 12층 LSTM 인코더와 2층 LSTM 디코더, 30 000개의 wordp…

저자: Kanishka Rao, Hac{s}im Sak, Rohit Prabhavalkar

본 논문은 스트리밍 가능한 엔드‑투‑엔드 음성인식 모델인 RNN‑Transducer(RNN‑T)를 다양한 아키텍처와 데이터 활용 전략을 통해 최적화하는 과정을 상세히 기술한다. 기존의 자동음성인식(ASR) 시스템은 음향 모델, 발음 모델, 언어 모델이라는 세 개의 독립적인 컴포넌트로 구성되며, 각각 별도로 학습된다. 이러한 복합 구조는 높은 정확도를 제공하지만 구현 복잡성과 실시간 처리에 대한 제약을 초래한다. 최근 연구에서는 이러한 복잡성을 줄이고자 전체 파이프라인을 하나의 신경망으로 통합하는 엔드‑투‑엔드 접근법이 제안되었지만, 특히 실시간 스트리밍 상황에서는 아직 성능이 기존 시스템에 미치지 못한다는 한계가 있었다.

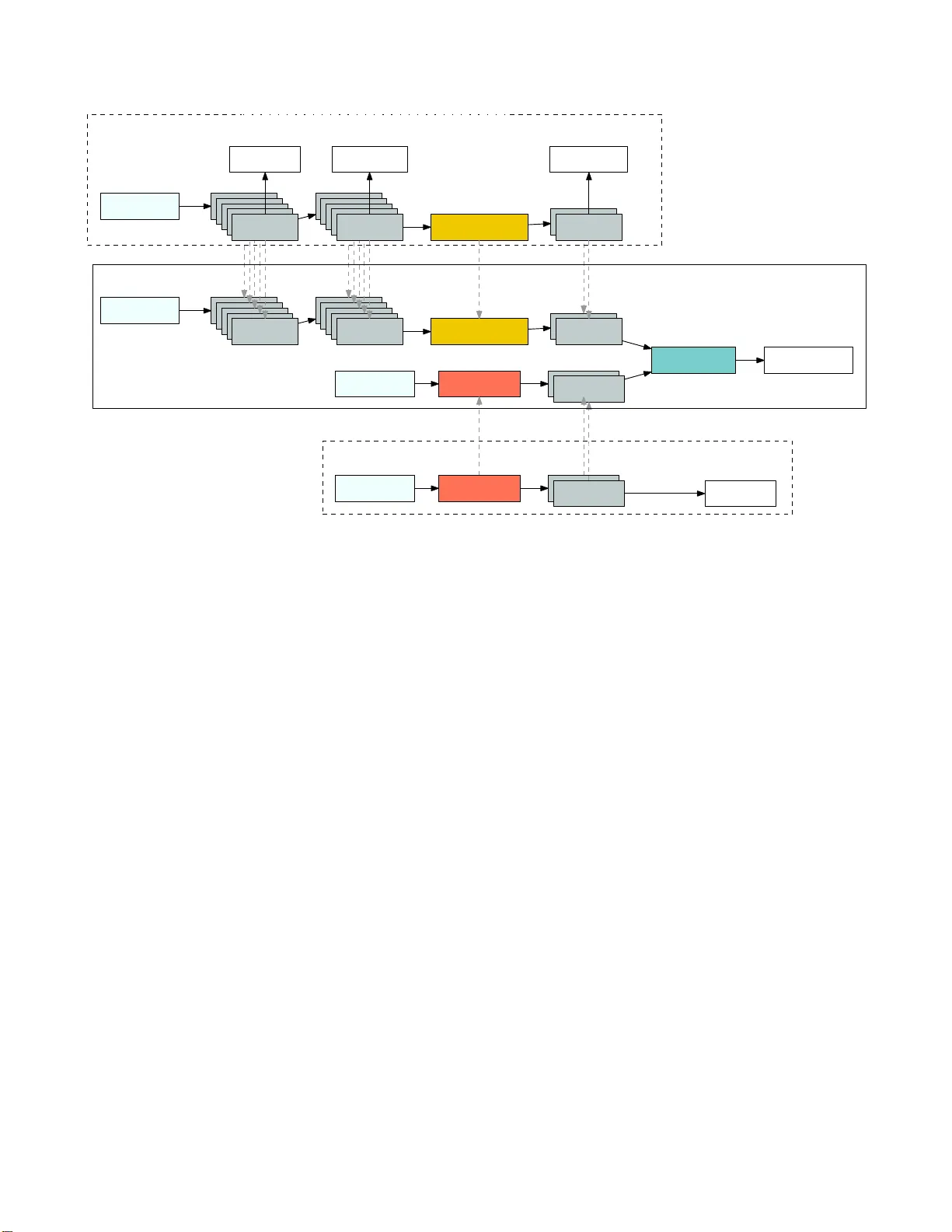

RNN‑T는 이러한 문제를 해결하기 위해 CTC와 시퀀스‑투‑시퀀스 모델의 장점을 결합한 구조를 채택한다. 인코더는 입력 음성 프레임을 고차원 표현으로 변환하는 LSTM 네트워크이며, CTC 손실을 이용해 사전학습된다. 디코더는 이전에 예측된 라벨(문자 혹은 서브워드)을 입력으로 받아 다음 라벨을 예측하는 LSTM 기반 언어모델이다. 두 네트워크는 joint 네트워크를 통해 결합되어, 각 타임스텝마다 음성 프레임과 이전 라벨 정보를 동시에 고려한 확률 분포를 출력한다. 이 구조는 블랭크 라벨을 이용해 프레임‑레벨와 라벨‑레벨의 정렬을 자동으로 학습하므로, 전체 입력을 미리 인코딩할 필요 없이 실시간으로 출력 스트림을 생성할 수 있다.

논문에서는 모델 설계와 학습 과정에서 네 가지 주요 변수를 실험한다. 첫째, 출력 단위로 grapheme(문자)와 wordpiece(서브워드)를 비교한다. grapheme은 라벨 수가 적어 학습이 빠르지만, 긴 단어를 여러 문자로 분할해야 하므로 문맥 정보를 충분히 활용하기 어렵다. 반면 wordpiece는 빈도 기반 토큰화 기법을 사용해 자주 등장하는 어휘는 하나의 라벨로, 드문 어휘는 여러 라벨로 표현한다. 1 000개와 30 000개 두 규모의 wordpiece vocab을 구축했으며, 특히 30 000개 vocab은 긴 단어를 단일 라벨로 처리함으로써 substitution 오류를 크게 감소시켰다.

둘째, 인코더와 디코더의 초기화 방법을 탐색한다. 인코더는 CTC 손실로 사전학습된 5~12층 LSTM 네트워크를 사용하고, 디코더는 대규모 텍스트 코퍼스로 학습된 LSTM 언어모델을 활용한다. 이렇게 두 파트를 별도로 사전학습한 뒤, 전체 네트워크를 RNN‑T 손실로 미세조정함으로써 파라미터 초기값이 풍부해져 수렴 속도와 최종 정확도가 모두 향상된다.

셋째, 계층적 CTC를 도입해 멀티태스크 학습을 수행한다. 인코더의 중간 레이어마다 phoneme, grapheme, wordpiece에 대한 CTC 손실을 동시에 최적화함으로써, 각 레벨의 음성 특징을 공유하고 전이 학습 효과를 극대화한다. 최종 softmax 파라미터는 폐기하고 LSTM 가중치만을 RNN‑T 디코더에 전달해 파라미터 효율성을 유지한다.

넷째, 시간‑컨볼루션 레이어를 추가해 인코더의 시퀀스 길이를 3배 압축한다. 이는 wordpiece가 갖는 긴 토큰 길이에 대응하면서 연산량을 크게 줄이는 역할을 한다.

실험은 구글 내부의 22 백만 음성 데이터(≈18 000시간)와 150 백만 문장의 텍스트 데이터를 사용했다. 베이스라인은 전통적인 음향‑발음‑언어 모델 파이프라인으로, CTC 기반 LSTM 음향 모델, 대규모 발음 사전, 5‑gram 언어 모델을 포함한다. RNN‑T 모델은 동일 데이터로 학습되었으며, 인코더는 CTC 사전학습, 디코더는 텍스트‑전용 LSTM 언어모델 사전학습을 거친다.

결과는 두 도메인(voice‑search, voice‑dictation)에서 각각 8.5 %/5.2 %의 WER를 기록했으며, 이는 베이스라인(8.3 %/5.4 %)과 거의 동등하거나 소폭 우수한 수준이다. 특히 wordpiece‑기반 모델은 grapheme‑기반 대비 substitution 오류가 현저히 감소했으며, 디코더 초기화를 통한 언어모델 강화가 전체 성능 향상의 핵심 요인으로 확인되었다.

종합하면, 이 연구는 (1) CTC 기반 인코더와 텍스트‑전용 디코더의 사전학습을 통한 파라미터 초기화, (2) 서브워드(wordpiece) 단위의 출력 설계, (3) 계층적 CTC와 시간‑컨볼루션을 결합한 멀티태스크 학습 전략이 스트리밍 RNN‑T 모델의 정확도와 효율성을 크게 향상시킨다는 중요한 인사이트를 제공한다. 이러한 설계는 실시간 음성 서비스, 모바일 디바이스, 클라우드 기반 음성 인식 등 다양한 응용 분야에 바로 적용 가능하며, 향후 더 큰 vocab과 더욱 깊은 네트워크 구조를 탐색함으로써 엔드‑투‑엔드 ASR의 한계를 계속해서 확장할 수 있을 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기