TD 학습을 위한 λ 파라미터 자동 적응 탐욕적 접근

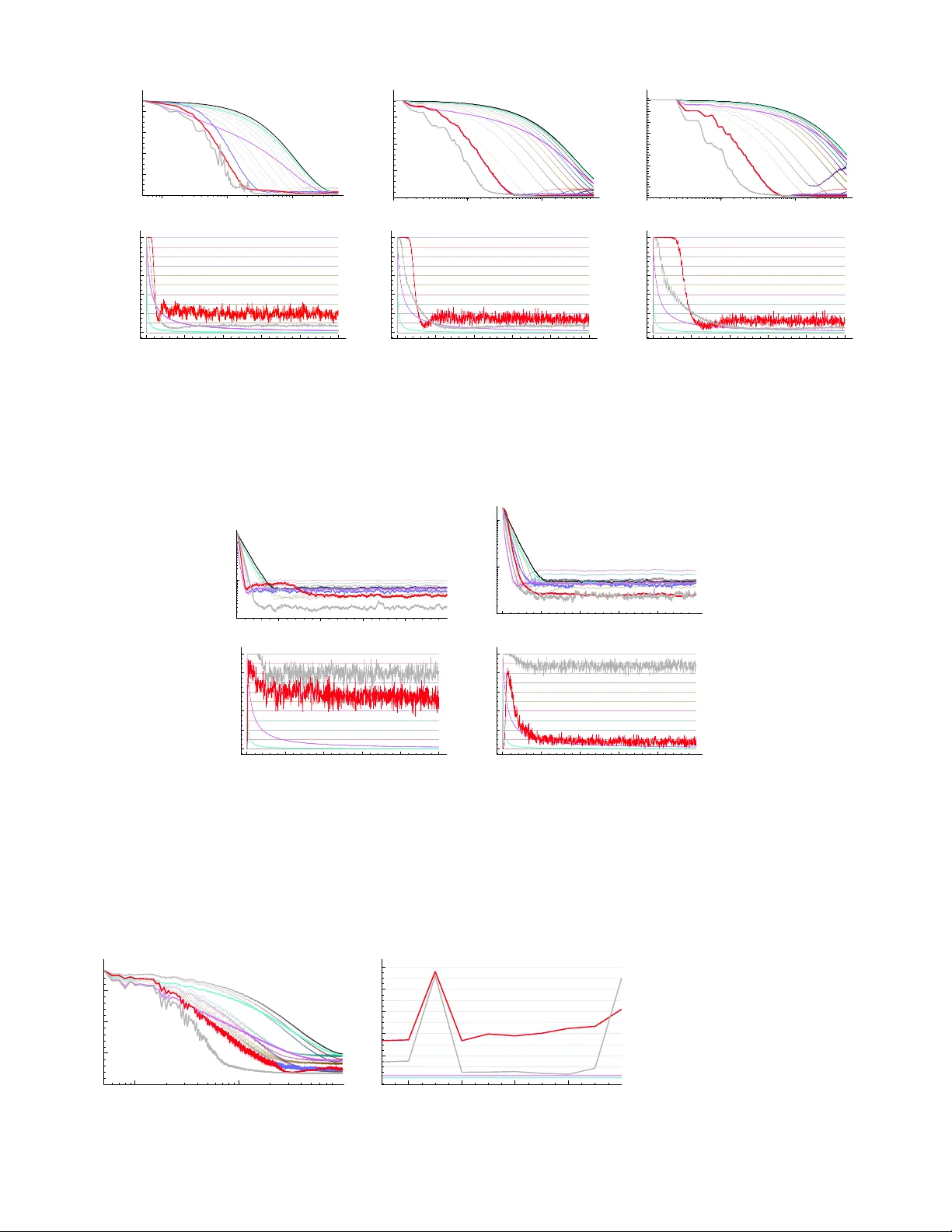

이 논문은 TD(λ) 학습에서 중요한 트레이스 파라미터 λ를 상태별로 온라인에 적응시키는 새로운 방법을 제안한다. 저자는 편향‑분산 트레이드오프를 최소화하는 탐욕적 목표를 정의하고, 이를 기반으로 선형 복잡도의 증분 알고리즘인 λ‑greedy 를 유도한다. 실험 결과, λ‑greedy 가 온‑정책·오프‑정책 모두에서 고정 λ 보다 일관되게 우수한 성능을 보이며, 파라미터 튜닝 부담을 크게 줄인다.

저자: Martha White, Adam White

본 논문은 강화학습에서 TD(λ) 알고리즘의 핵심 파라미터인 트레이스 감쇠 파라미터 λ 를 상태별로 온라인에 적응시키는 새로운 메타‑러닝 기법을 제안한다. 서론에서는 강화학습 시스템이 실제 적용될 때 파라미터 민감도가 큰 장애물임을 강조하고, 특히 λ 가 학습 속도와 안정성에 미치는 영향을 설명한다. 기존 연구들은 λ 를 고정값으로 두거나, 배치 방식·모델 기반 접근을 통해 최적화했지만, 이는 함수 근사, 온라인 처리, 오프‑정책 상황에서 적용이 어려웠다.

배경 섹션에서는 MDP 정의, 상태 기반 할인 γ(s) 와 λ(s) 의 일반화, 그리고 GTD(λ) 알고리즘의 업데이트 식을 제시한다. 여기서 중요도 샘플링 비율 ρ_t 를 통해 온‑정책·오프‑정책을 동시에 다룰 수 있음을 언급한다.

핵심 기여는 “λ 적응을 위한 목표 함수”이다. 저자들은 현재 시점 t에서 λ_{t+1} 를 선택할 때, 미래에는 λ=1(즉, 무편향 MC 반환) 로 전환된다고 가정하고, 현재 단계에서의 추정 ˆG_t 와 실제 MC 반환 G_t 사이의 평균제곱오차(MSE)를 최소화한다. MSE 를 편향 제곱항과 분산 항으로 분해하고, 각각을 λ_{t+1} 에 대한 함수로 전개한다. 편향 항은 현재 가치 추정 w와 MC 반환 사이의 차이 err(w_t, x_{t+1}) 로 표현되며, 분산 항은 보상 노이즈 σ_r(x_t, x_{t+1}) 와 λ_{t+1}² 에 비례한다. 미분 후 0 으로 두어 최적 λ_{t+1} 를 구하면 다음과 같은 닫힌식이 얻어진다:

λ_{t+1}^{*}= \frac{ρ_t γ_{t+1} err(w_t,x_{t+1})}{ρ_t γ_{t+1} err(w_t,x_{t+1}) + σ_r(x_t,x_{t+1})}.

이 식은 λ 를 현재 관측값만으로 즉시 계산할 수 있게 해준다.

알고리즘 설계에서는 GTD(λ) 의 기존 업데이트에 λ‑greedy 를 삽입한다. 구체적인 절차는: (1) 현재 보상 R_{t+1}, 다음 상태 특징 x_{t+1}, 중요도 비율 ρ_t, 할인 γ_{t+1} 을 관측, (2) 온라인 평균과 분산 추정기를 사용해 err 와 σ_r 를 업데이트, (3) 위 닫힌식으로 λ_{t+1} 를 계산하고 클리핑하여

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기