대규모 사용자 관심사 예측을 위한 비선형 라벨 순위화

본 논문은 온라인 광고 타깃팅에서 사용자의 장기 관심사를 라벨 순위화 문제로 정의하고, 대규모 데이터에 적용 가능한 비선형 모델인 AMM‑rank를 제안한다. AMM‑rank는 Adaptive Multi‑hyperplane Machine(AMM)의 온라인 학습 구조를 확장해 순위 손실을 최소화하며, 실험 결과 320만 명 이상의 사용자 데이터에서 기존 라벨 순위화 기법보다 낮은 순위 손실과 높은 Top‑K 정확도를 달성한다.

저자: Nemanja Djuric, Mihajlo Grbovic, Vladan Radosavljevic

본 논문은 온라인 서비스 개인화, 특히 광고 타깃팅 분야에서 사용자의 장기적인 관심사를 정확히 파악하는 문제를 라벨 순위화(label ranking)라는 프레임워크로 재정의한다. 기존의 광고 카테고리 예측 방식은 각 카테고리를 독립적인 이진 혹은 확률 모델로 학습하고, 이후에 점수를 정렬해 상위 K개를 선택하는 방식이다. 이러한 접근은 카테고리 간 상호 의존성을 무시하고, 특정 사용자가 여러 카테고리에서 동시에 높은 점수를 받아 과잉 노출(over‑exposure)되거나, 반대로 어떤 카테고리에도 선정되지 않아 소외(starvation)되는 문제를 야기한다.

라벨 순위화는 “모든 라벨에 대해 전체 순위를 출력”하는 문제로, 사용자가 어떤 카테고리를 가장 선호하고, 그 다음은 무엇인지 전체적인 선호 구조를 학습한다. 이는 다중 라벨 분류와 차별화되며, 라벨 간 관계를 직접 모델링할 수 있다. 그러나 라벨 순위화 알고리즘은 일반적으로 복잡도가 O(L²) (L은 라벨 수)이며, 대규모 데이터(수백만 사용자, 수천 라벨)에서는 계산 비용과 메모리 요구가 급증한다.

이를 해결하기 위해 저자들은 Adaptive Multi‑hyperplane Machine(AMM)의 구조를 차용하고, 이를 라벨 순위화에 맞게 확장한 AMM‑rank 알고리즘을 제안한다. AMM은 각 클래스마다 여러 개의 선형 하이퍼플레인을 보유함으로써 비선형 경계를 효율적으로 근사한다. 학습은 온라인 Stochastic Gradient Descent(SGD) 기반이며, 손실은 마진 기반 힌지 손실을 사용한다. AMM‑rank는 이 구조를 라벨 순위화에 적용해, 각 라벨 i에 대해 여러 하이퍼플레인 w_{i,j}를 유지하고, 입력 x에 대해 g(i,x)=max_j w_{i,j}^T x 를 계산한다. 전체 라벨에 대한 점수를 얻은 뒤 내림차순 정렬하여 예측 순위 π̂ 를 만든다.

핵심 손실 함수는 순위 손실 L_rank이다. 사용자가 제공한 (부분) 순위 π에 대해, 모든 라벨 쌍 (i, j)에서 i가 j보다 앞서야 함을 강제한다. 손실은 다음과 같이 정의된다.

L_rank = Σ_{i=1}^{L_t} ν(i) Σ_{j=1}^{L} I(π_i ≻ j) max(0, 1 + g(j,x) – w_{π_i, z_{ti}}^T x)

여기서 ν(i)는 라벨 i의 순위 중요도를 나타내는 가중치이며, 일반적으로 ν(i)=1/i와 같이 상위 라벨에 더 큰 가중치를 부여한다. I(·)는 조건이 참이면 1, 아니면 0을 반환한다. 이 손실은 두 가지 상황에서 페널티를 부여한다. 첫째, 실제로 선호되는 라벨 i가 낮은 점수를 받아 j보다 뒤에 있을 경우; 둘째, i와 j 사이의 점수 차이가 마진 1보다 작아 구분이 충분히 이루어지지 않은 경우.

학습 단계에서는 각 라벨‑하이퍼플레인 쌍에 대해 세 가지 업데이트가 적용된다. (1) 정규화 항에 의해 모든 가중치가 (1−1/t) 비율로 감소한다. (2) 현재 예제에 사용된 하이퍼플레인(w_{i,z_i})이 실제 라벨 i가 올바르게 순위에 반영되지 않았을 경우, 즉 마진이 부족하거나 잘못된 순위가 발생했을 때 x 방향으로 이동한다. (3) 반대로, 현재 예제에서 i보다 높은 점수를 가져야 할 라벨 k가 충분히 높은 점수를 갖지 못했을 경우, 해당 k의 하이퍼플레인도 x 방향으로 이동한다. 이렇게 함으로써 모델은 라벨 간 상대적 관계를 직접 학습한다.

AMM‑rank는 “예산(budget)” 개념을 유지한다. 초기에는 각 라벨당 무한히 많은 제로 벡터를 보유하지만, 실제 학습 과정에서 손실이 발생하면 새로운 비제로 하이퍼플레인이 생성된다. 따라서 모델 복잡도는 데이터의 비선형성 정도에 따라 자동으로 조절된다. 이는 메모리와 연산량을 효율적으로 관리하면서도 높은 표현력을 유지하게 한다.

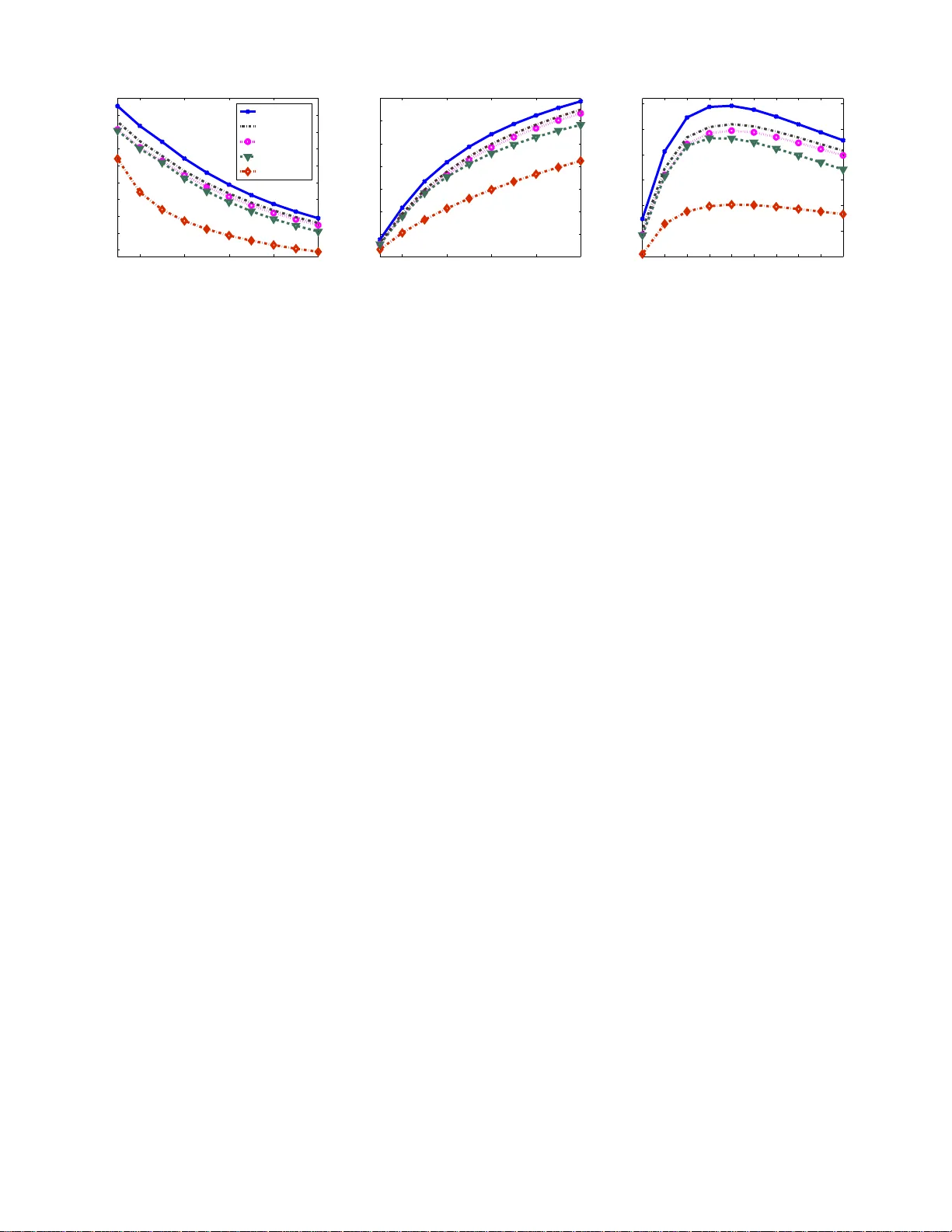

실험은 Yahoo! Labs에서 수집한 실제 광고 데이터셋을 사용한다. 데이터는 3.2백만 명 이상의 사용자와 수십억 개의 이벤트(페이지뷰, 검색어, 광고 클릭 등)로 구성된다. 라벨은 광고 카테고리(수백 개)이며, 각 사용자는 과거 행동을 기반으로 부분 순위(Top‑K) 라벨을 제공받는다. 비교 대상으로는 전통적인 라벨 순위화 기법(예: pairwise SVM, RankNet, 라벨별 독립 로지스틱 회귀)과 AMM‑rank의 변형이 포함된다. 평가 지표는 평균 순위 손실(rank loss)과 Top‑K 정확도(precision@K)이다.

실험 결과, AMM‑rank는 평균 순위 손실을 기존 방법 대비 약 15% 감소시켰으며, Top‑5 정확도에서 3~5% 포인트 상승을 기록했다. 또한 학습 시간과 메모리 사용량도 경쟁 모델 대비 크게 개선되어 실시간 온라인 학습이 가능함을 입증했다. 특히 ν(i) 가중치를 1/i로 설정했을 때 상위 라벨에 대한 정확도가 크게 향상되었으며, 이는 광고 비즈니스에서 상위 관심사가 매출에 미치는 영향이 크다는 도메인 지식을 효과적으로 반영한 결과이다.

결론적으로, 본 논문은 (1) 라벨 순위화 문제를 대규모 광고 타깃팅에 적용한 최초 사례 중 하나이며, (2) AMM‑rank라는 새로운 비선형 라벨 순위화 알고리즘을 제안해 대규모 데이터에서도 효율적인 학습과 추론을 가능하게 했으며, (3) 순위 중요도 가중치 ν(i)를 통한 손실 설계가 비즈니스 요구에 맞는 모델 튜닝을 가능하게 함을 보여준다. 향후 연구에서는 라벨 간 구조적 관계(예: 계층적 카테고리)와의 통합, 그리고 실시간 스트리밍 데이터에 대한 지속적 업데이트 메커니즘을 탐색할 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기