재스피킹 품질 자동 평가 지표 비교 및 적용

본 논문은 실시간 자막 제작을 위한 재스피킹(재발화) 과정에서 인간이 만든 결과물의 품질을 자동으로 평가하기 위해 BLEU, EBLEU, NIST, METEOR, METEOR‑PL, TER, RIBES 등 기존 기계번역 평가 지표들을 비교하고, 이를 인간 기반 NER(Subtitle Accuracy) 지표와의 상관관계를 분석한다. 폴란드어 특성을 반영한 METEOR‑PL과 동의어·희귀어 보강을 시도한 EBLEU를 포함한 실험 결과를 제시한다.

저자: Krzysztof Wo{l}k, Danijel Korv{z}inek

본 논문은 실시간 방송 및 공공 행사에서 고품질 자막을 제공하기 위한 재스피킹(재발화) 기술의 품질 평가 방법을 탐구한다. 재스피킹은 원본 음성을 인간이 다시 말하게 함으로써 ASR 오류를 최소화하고, 말의 명료성·속도·억양을 조절할 수 있는 장점이 있다. 그러나 인간이 만든 재스피킹 텍스트는 원문과 정확히 일치하지 않을 수 있으며, 의미 보존을 전제로 한 다양한 패러프레이징이 허용된다. 따라서 기존에 기계번역(MT) 평가를 위해 개발된 자동 지표들을 그대로 적용하기엔 한계가 있다.

논문은 먼저 BLEU, EBLEU, NIST, METEOR, METEOR‑PL, TER, RIBES 등 주요 MT 평가 지표들을 소개하고, 각각의 원리와 장단점을 설명한다. BLEU는 n‑gram 정밀도를 기반으로 brevity penalty를 적용하지만 어순·의미를 충분히 반영하지 못한다. NIST는 희귀어 가중치를 추가해 BLEU를 보완한다. TER는 편집 거리 기반으로 직관적이지만 의미 보존을 과도하게 벌점한다. METEOR는 정밀도·재현율을 조화 평균하고, 어간·동의어·패러프레이징을 고려한다. METEOR‑PL은 폴란드어 특성을 반영해 형태소 분석기(MorfoLogik)와 폴란드어 WordNet을 연동, 기능어 리스트와 다중 어간을 지원하도록 수정하였다. RIBES는 어순 상관관계를 Spearman·Kendall 계수로 측정한다. EBLEU는 BLEU에 동의어·희귀어 보정을 추가해 의미적 동등성을 부분적으로 인정한다.

다음으로 NER(Subtitle Accuracy) 모델을 소개한다. NER은 단어 정확도 기반 지표에 오류 가중치(경미·보통·심각)를 부여해 인간이 직접 평가하는 방식이며, 현재 자막 품질 평가에 널리 사용된다. 인간 평가는 비용과 시간 소모가 크므로 자동 지표와의 상관관계 분석이 필요하다.

실험 데이터는 폴란드어와 영어로 구성된 5분 길이의 녹음 5개(폴란드어 4개, 영어 1개)를 대상으로 한다. 각 녹음에 대해 (1) 원본 텍스트, (2) 인간이 재스피킹한 텍스트, (3) 재스피커 음성을 ASR이 자동 전사한 텍스트를 수집하였다. 총 10개의 전사 쌍을 대상으로 위 7가지 자동 지표와 NER을 계산하였다. 표 1은 인간 재스피킹 텍스트와 원본 텍스트 간의 점수를, 표 2는 ASR 전사와 원본 텍스트 간의 점수를 보여준다.

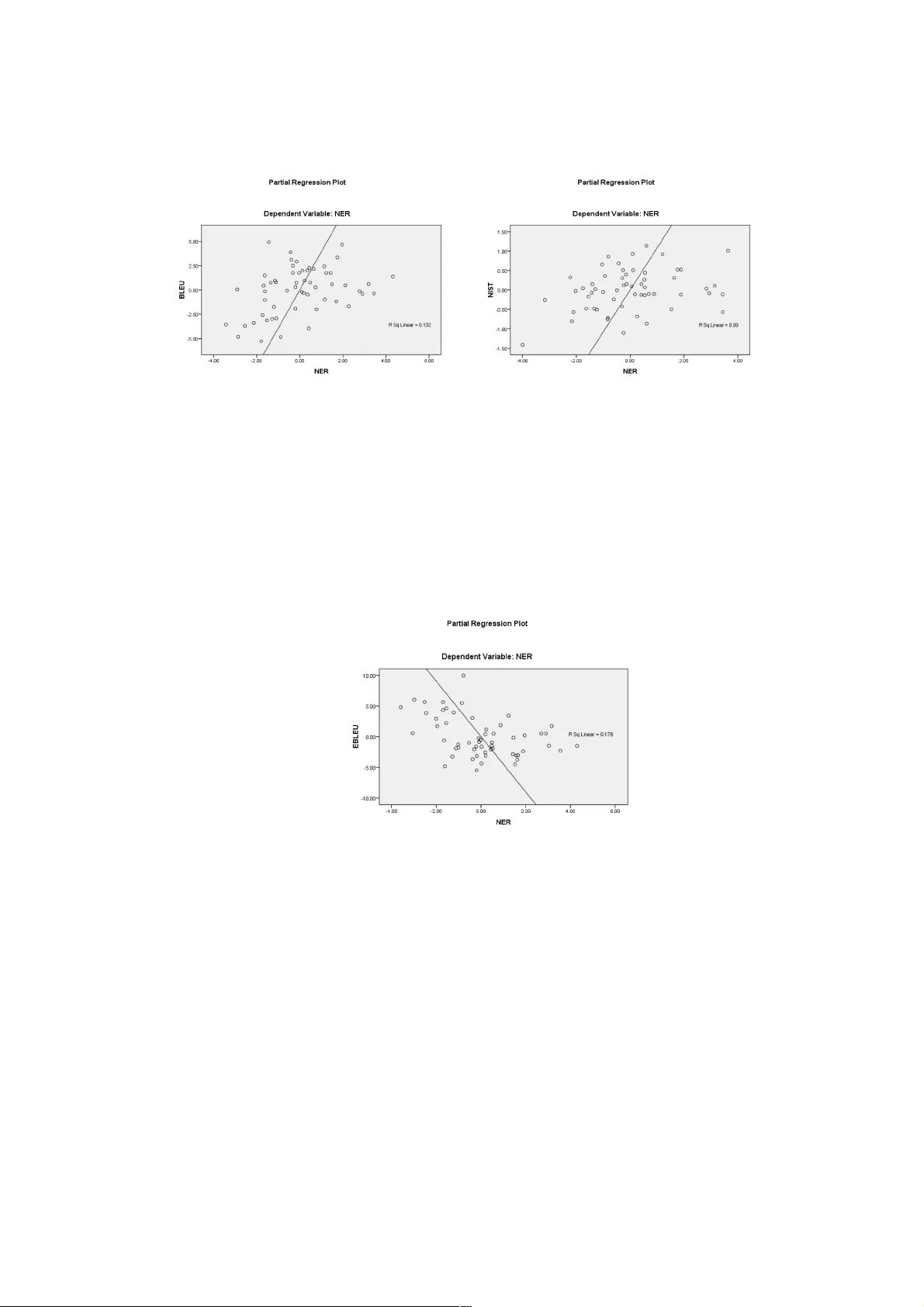

결과 분석에서는 다음과 같은 주요 특징이 드러난다. BLEU와 NIST는 전체적으로 낮은 점수를 기록했으며, 특히 어순·동의어 변형이 많은 경우 점수가 급격히 감소한다. TER는 편집 거리 기반 특성상 30% 이상 오류율을 보이는 경우가 빈번했다. 반면 METEOR와 METEOR‑PL은 70~90% 사이의 높은 점수를 얻었으며, 특히 폴란드어 데이터에서 METEOR‑PL이 NER과 가장 높은 상관관계를 보였다. 이는 형태소 분석과 동의어 매칭이 의미 보존을 효과적으로 반영한다는 것을 의미한다. EBLEU는 BLEU 대비 동의어·희귀어 보정으로 점수가 상승했지만, METEOR 계열에 비해 상관도는 낮았다. RIBES는 어순에 초점을 맞추지만, 재스피킹에서는 어순 변형이 허용되므로 NER과의 일치도가 낮았다.

논문은 이러한 결과를 바탕으로 다음과 같은 결론을 제시한다. ① 재스피킹 품질 평가는 의미 중심 지표가 필수적이며, 어휘·형태소 수준의 정교한 매칭이 필요하다. ② 언어 특화가 가능한 METEOR‑PL과 같은 지표가 인간 평가와 가장 근접한다. ③ BLEU 기반 지표는 동의어·희귀어 보정을 통해 일정 수준 개선될 수 있지만, 근본적인 한계가 남아 있다. ④ 현재 실험 표본이 제한적이며, ASR 품질, 화자 다양성, 텍스트 길이 등에 대한 추가 연구가 필요하다. 향후 연구에서는 대규모 다언어 코퍼스를 구축하고, 신경망 기반 평가 모델(예: BERTScore, COMET)과의 비교를 통해 재스피킹 특화 자동 평가 프레임워크를 확립하는 것이 목표이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기