분산 언어 표현 역전으로 문서 분류 혁신

본 논문은 Word2Vec·Doc2Vec 등 기존의 분산 언어 모델을 별도의 추가 학습 없이 베이즈 역전 규칙에 적용해 문서 분류기로 전환하는 방법을 제안한다. 각 클래스별로 별도 언어 모델을 학습하고, 문서의 클래스 사후 확률을 모델별 로그우도와 사전 확률을 이용해 계산한다. Yelp 리뷰 2백만 문장을 대상으로 실험했으며, 복잡한 기존 방법과 동등하거나 더 높은 정확도를 보였다.

저자: Matt Taddy

본 논문은 최근 각광받고 있는 분산 언어 모델, 특히 Word2Vec과 Doc2Vec 같은 임베딩 기반 방법을 별도의 추가 학습 없이 문서 분류에 직접 활용할 수 있는 새로운 프레임워크를 제안한다. 핵심 아이디어는 각 클래스별(예: 긍정·부정, 별점 1~5 등)로 코퍼스를 분리하고, 해당 코퍼스에 대해 독립적인 언어 모델 V₁, V₂, …, V_C 를 학습한 뒤, 새로운 문서 d에 대해 각 모델이 부여하는 로그우도 p_{V_c}(d)를 계산한다. 이후 베이즈 정리 p(y=c|d) ∝ p_{V_c}(d)·π_c 를 적용해 사후 확률을 구하고, 가장 높은 확률을 가진 클래스를 예측한다.

**이론적 배경**

Word2Vec의 스킵‑그램 목표는 주변 단어를 예측하는 조건부 확률 p(w_k|w_j)를 최대화하는 것이다. 이를 전체 문장에 대해 합산하면 복합 가능도(composite likelihood) 형태의 로그우도 L = Σ_{j,k} log p(w_k|w_j) 가 된다. 저자들은 이 복합 가능도를 문서 전체에 대한 근사 로그우도로 확장하고, 이를 클래스별 모델에 적용한다. 즉, 문서 d = {w₁,…,w_S}에 대해 log p_{V_c}(d) = Σ_{s=1}^S log p_{V_c}(w_s) 로 정의한다.

**구현 세부사항**

- Word2Vec은 gensim 라이브러리의 Huffman softmax 구현을 사용하고, 차원 K=100, 윈도우 b=5 로 설정한다.

- 각 클래스 c에 대해 별도 코퍼스 D_c 를 구성하고, 동일한 하이퍼파라미터로 독립 학습한다.

- 문서 d는 여러 문장으로 구성될 경우, 각 문장의 로그우도를 평균(또는 합)해 전체 문서 우도를 산출한다(식 6).

- 사전 확률 π_c 는 실험에서는 균등하게 설정했으며, 필요에 따라 데이터 비율에 맞게 조정 가능하다.

**실험 설계**

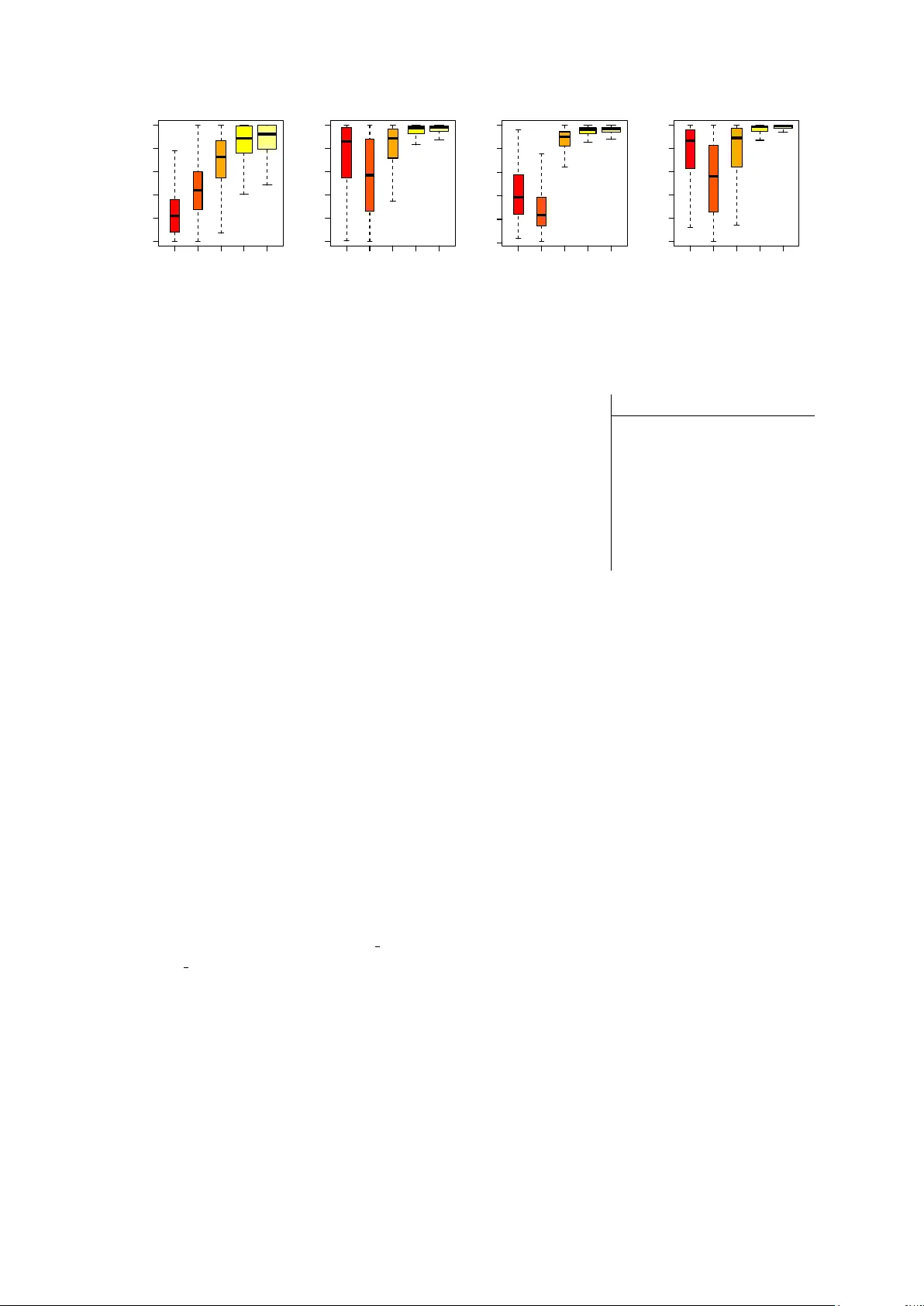

Yelp 리뷰 데이터(2백만 문장, 230,000 훈련 리뷰, 23,000 검증 리뷰)를 사용하였다. 리뷰는 별점 1~5 로 라벨링되어 있으며, 각 별점에 대해 별도 Word2Vec 모델을 학습한다. 검증 단계에서는 각 리뷰에 대해 5개의 클래스 확률 q =

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기