강인한 로지스틱 회귀: 시프트 파라미터를 이용한 라벨 오류 처리

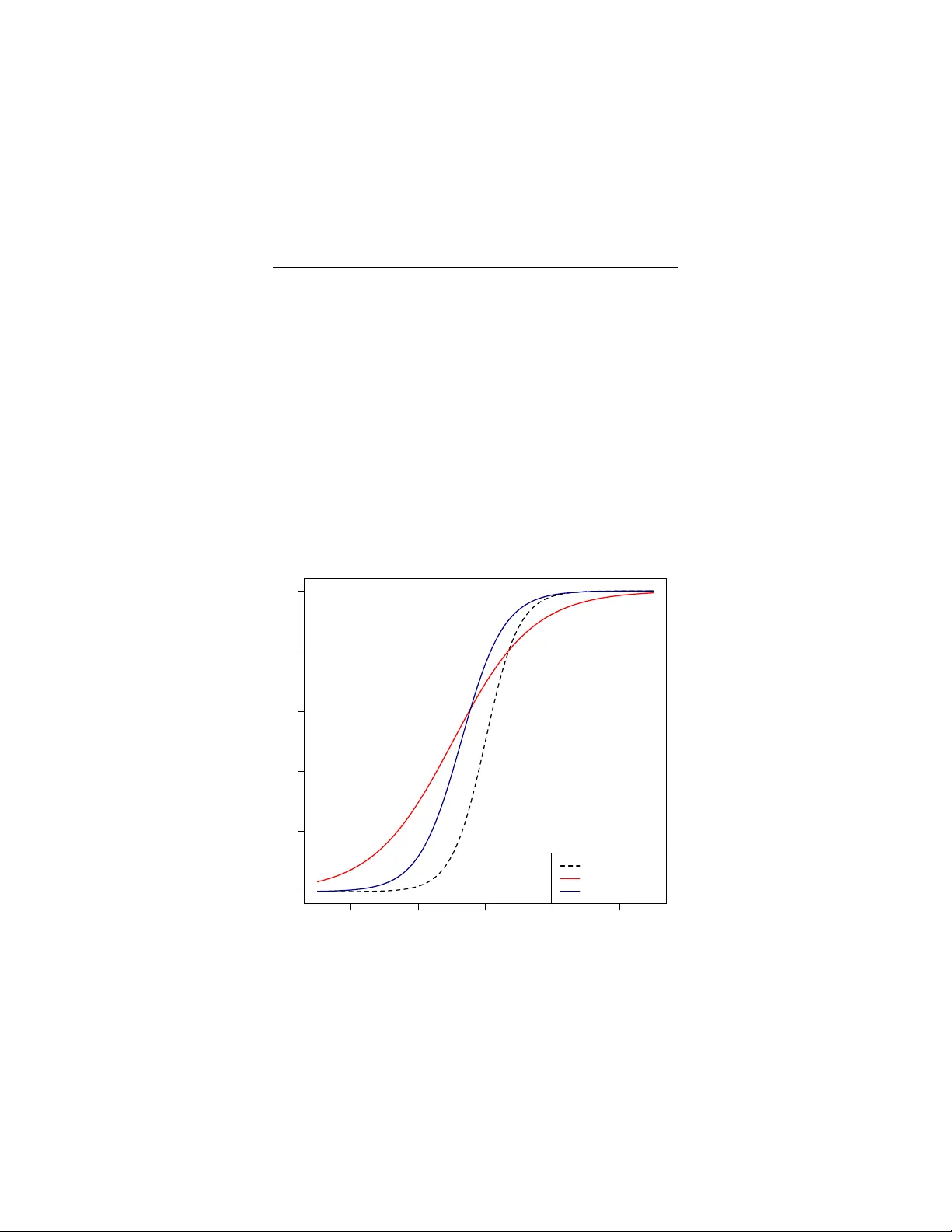

본 논문은 라벨링 오류가 빈번한 대규모 텍스트 데이터에 대비해, 각 샘플마다 별도의 시프트 파라미터를 도입한 로지스틱 회귀 모델을 제안한다. L1 정규화를 통해 시프트 파라미터를 희소하게 만들고, 기존 로지스틱 회귀와 동일한 최적화 절차로 학습한다. 실험에서는 NER와 생물학 데이터에서 라벨 노이즈가 존재할 때 표준 로지스틱 회귀보다 높은 정확도와 오류 탐지 능력을 보였다.

저자: Julie Tibshirani, Christopher D. Manning

본 논문은 자연어 처리와 생물정보학 등에서 라벨링 오류가 빈번히 발생한다는 현실적인 문제를 인식하고, 라벨 오류를 사전에 제거하거나 무시하는 기존의 필터링 기법이 데이터 손실이나 오류 탐지 한계에 봉착한다는 점을 비판한다. 이러한 배경에서 저자들은 로지스틱 회귀 모델에 ‘시프트 파라미터(γ_i)’를 도입하는 새로운 방법론을 제안한다.

1. **모델 설계**

- 기존 로지스틱 회귀는 P(y=1|x)=σ(θᵀx) 로 정의된다. 여기서 σ는 시그모이드 함수이다.

- 제안 모델은 각 샘플 i마다 실수형 시프트 γ_i 를 추가하여, P(y=1|x_i)=σ(θᵀx_i+γ_i) 로 변형한다.

- γ_i 가 0이면 라벨이 올바른 것으로 가정하고, 양(음) 방향으로 큰 값을 가지면 라벨이 반전된 것으로 해석한다.

2. **정규화 및 희소성**

- 대부분의 샘플이 올바른 라벨을 가진다는 사전 가정 하에, γ_i 에 L1 정규화 λ|γ_i| 를 적용한다. 이는 γ_i 를 희소하게 만들어 실제 오류가 있는 샘플만 비제로 값을 갖게 한다.

- θ 파라미터에도 필요에 따라 L1 정규화 κ|θ_j| 를 적용해 고차원 특성 공간에서 과적합을 방지한다.

3. **최적화**

- 설계 행렬 X에 단위 행렬 I_n 을 추가해 새로운 파라미터 벡터 θ'=

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기