예시 기반 군집화의 선형계획 복구 보장

이 논문은 k‑medoids 군집화의 선형계획(LP) 완화가, 충분히 많은 표본과 적절히 큰 구 사이 거리 조건을 만족할 때, 서로 겹치지 않는 구들에 의해 생성된 데이터 포인트들을 정확히 복구한다는 확률적 보장을 제시한다. 특히 같은 구 안의 점들보다 다른 구의 점들 간 거리가 더 짧을 수 있는 어려운 상황에서도 복구가 가능함을 증명한다.

저자: Abhinav Nellore, Rachel Ward

본 논문은 k‑medoids 군집화 문제에 대한 선형계획(LP) 완화가 언제 원래의 정수계획(IP)와 동일한 최적해를 제공하는지를 확률적 관점에서 연구한다. k‑medoids는 각 클러스터의 중심을 데이터 집합 내의 실제 점(예시, medoid)으로 선택하는 군집화 방법으로, 전역 최적을 찾기 위해서는 NP‑hard 문제를 풀어야 한다. 그러나 이 문제는 이진 변수 z_{ij}를 이용해 “점 i가 medoid j에 할당된다”는 제약을 갖는 정수선형계획으로 표현될 수 있다.

논문은 먼저 이 정수계획(KMed)을 비정수 제약을 완화한 LP(LinKMed)로 변형한다. LinKMed는 변수 z_{ij}≥0, 각 점이 정확히 하나의 medoid에 할당되는 제약(∑_j z_{ij}=1)과 medoid 개수 제한(∑_i z_{ii}≤k) 등을 포함한다. 이때 목표는 총 가중치(제곱 유클리드 거리) 최소화이다.

핵심 이론적 기여는 LinKMed의 최적해가 KMed와 일치하기 위한 충분조건을 라그랑주 이중성 및 KKT 조건을 이용해 명시적으로 제시한 것이다. Proposition 4는 존재해야 할 라그랑주 승수 u와 λ_i에 대한 식(12)을 제시하고, 이를 간단히 한 Corollary 5는 모든 비메도이드 점 i와 임의의 medoid j에 대해 T_{ij}=u/N_i + w_{i,M(i)} - w_{ij}가 양(같은 클러스터) 혹은 음(다른 클러스터)이어야 함을 보여준다. 여기서 N_i는 점 i와 같은 클러스터에 속한 점 수이며, w_{ij}=‖x_i - x_j‖^2이다.

다음으로, 이러한 조건이 실제 데이터 생성 모델 하에서 고확률로 만족함을 증명한다. 데이터는 d≥2 차원 유클리드 공간에 반지름 1인 k개의 구에 각각 n개의 점을 독립적으로 뽑는 모델이다. 각 구 안의 점은 구 중심에 대해 구형 대칭 분포를 따르며, ‖x‖≥r일 확률이 ≤1‑r^2 (식 11) 를 만족한다. 구 중심들 사이의 최소 거리 R가 충분히 크면, 특히 R≥3.75인 경우, 충분히 큰 n에 대해 확률 1‑4k/n 이상으로 LinKMed가 KMed와 동일한 유일 최적해를 갖는다(정리 1).

정리 1은 기존 연구가 요구하던 “두 구 사이 거리 ≥4”라는 강한 가정을 완화한다. 실제로 R이 3.75~4 사이에서도, 같은 구 안의 점들보다 다른 구의 점들이 더 가깝게 될 가능성이 존재하지만, LP 복구는 여전히 성공한다. 이는 거리 임계값 기반 방법(예: 단순 임계값 절단)이 실패할 수 있는 “중첩 구간”에서도 LP가 전역 최적을 찾을 수 있음을 의미한다.

조건 (15)는 거리 가중치의 거듭제곱 지수 p에 따라 필요한 R의 하한을 제시한다. p→∞ (즉, 최댓값 거리)일 때 R>4가 필요하고, p가 작을수록 요구되는 R는 감소한다. 이는 거리 가중치 선택이 복구 가능성에 미치는 영향을 설명한다.

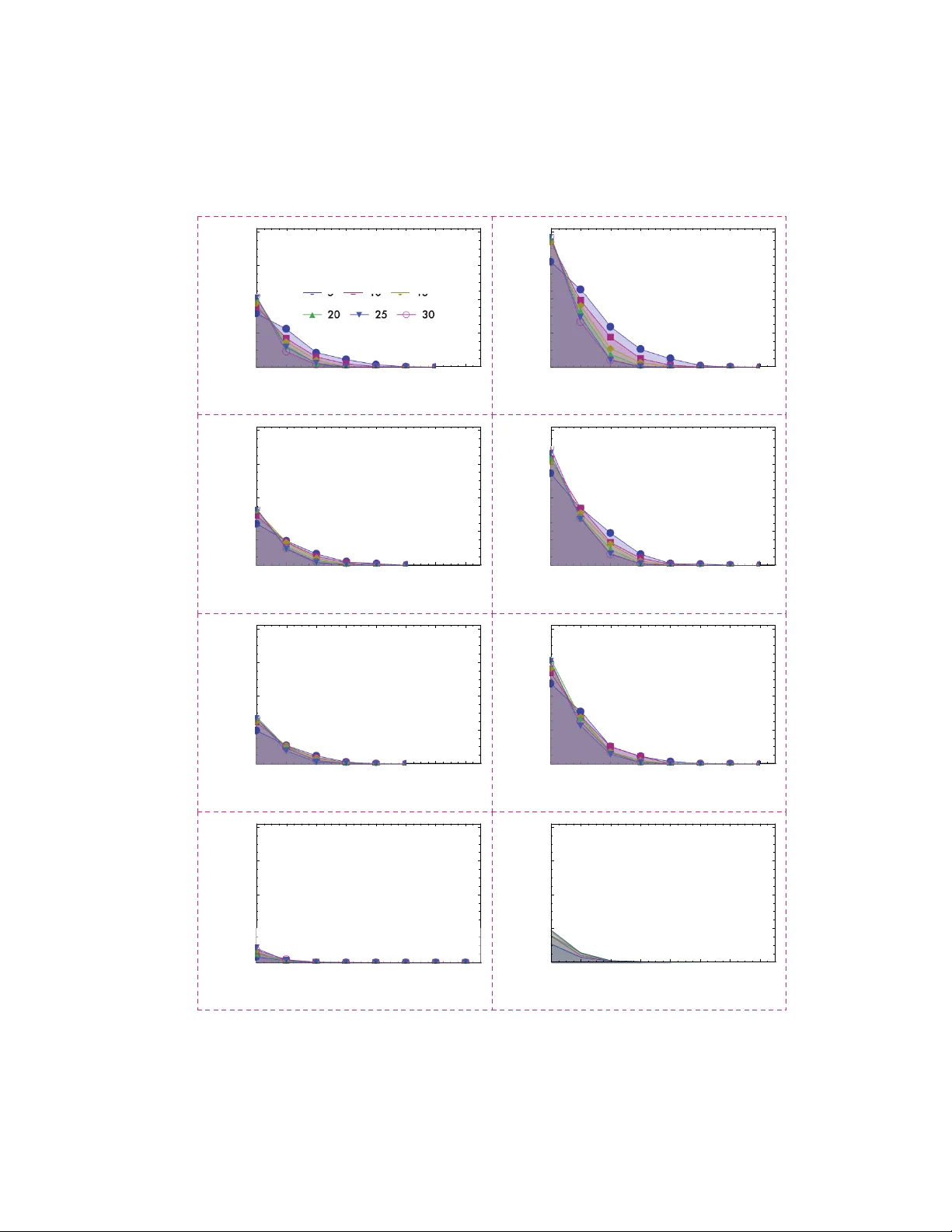

실험 부분에서는 합성 데이터와 실제 얼굴 이미지(Yale Face) 데이터를 사용해 LinKMed를 직접 풀었다. 합성 실험에서는 구 사이 거리 R을 3.0~5.0 범위로 변화시키면서, 정리에서 제시된 최소 n값보다 훨씬 작은 n에서도 정확한 클러스터 복구가 관찰되었다. 얼굴 이미지 실험에서는 18장의 이미지(3명×6표정)를 대상으로 affinity propagation과 Lloyd’s 알고리즘이 각각 다른 결과를 보였지만, LinKMed는 실제 이미지(픽셀값) 기반 거리로도 정확히 인물별 클러스터를 복구했다.

논문은 또한 기존의 k‑medoids 근사 알고리즘(PAM, affinity propagation)과 비교해, LP 기반 접근법이 전역 최적을 보장한다는 점에서 차별화된 가치를 강조한다. 고차원 데이터에 대한 차원 축소(JL 변환)를 언급하며, 이론을 대규모 데이터에 적용할 수 있는 가능성을 제시한다. 마지막으로, 향후 연구 과제로 LP 복구의 샘플 복잡도 최적화, 비구형 클러스터(예: 타원형) 확장, 그리고 실시간 대규모 그래프에 대한 효율적인 LP 솔버 개발 등을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기