스파스하고 비매끄러운 그래디언트를 위한 적응형 학습률과 병렬화

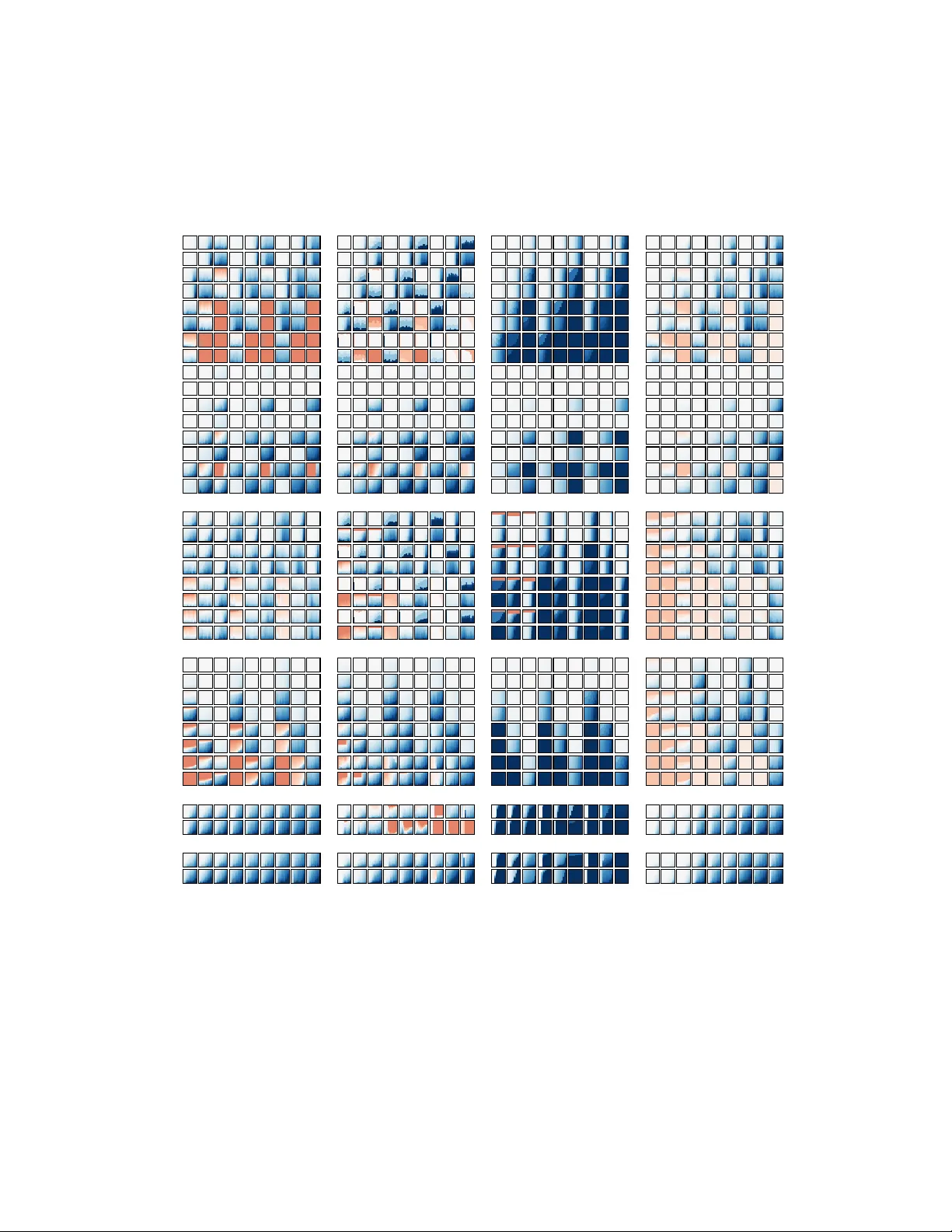

본 논문은 기존 vSGD의 학습률 자동조정 방식을 확장하여, 미니배치 병렬 처리, 희소(스파스) 및 직교 그래디언트, 그리고 비매끄러운 손실 함수에 대한 견고한 적용을 가능하게 한다. 대각 해시안 추정 대신 유한 차분 기반의 곡률 추정법을 도입하고, 각 차원별 샘플 비활성도에 따라 학습률을 동적으로 재조정함으로써 하이퍼파라미터 없이 선형 복잡도로 동작하는 최종 알고리즘(vSGD‑fd)을 제시한다.

저자: Tom Schaul, Yann LeCun

본 논문은 Stochastic Gradient Descent(SGD)의 학습률을 자동으로 조정하는 기존 vSGD 방법을 확장하여, 실제 딥러닝 환경에서 흔히 마주치는 세 가지 문제—미니배치 병렬화, 희소(스파스) 및 직교 그래디언트, 비매끄러운 손실 함수—에 대한 포괄적인 해결책을 제시한다.

첫 번째로, 미니배치 크기 n에 따른 분산 감소 효과를 정량화하고, 이를 학습률 공식에 반영한다. 기존 vSGD는 배치가 1일 때만 최적 학습률을 도출했으나, 여기서는 평균화에 의해 분산이 1/n 만큼 감소한다는 점을 이용해 η*ₖ = (1/hₖ)·(E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기