전 세계 슈퍼컴퓨터를 활용한 고성능 중력 N‑바디 시뮬레이션

본 논문은 네 개 대륙에 흩어진 슈퍼컴퓨터(암스테르담, 도쿄, 에든버러, 에스포)를 60~750 코어 규모로 동시에 사용해 냉암물질(CDM) 우주 시뮬레이션을 수행한 결과를 보고한다. 0.32 초의 네트워크 지연과 30 000 km 광케이블을 넘어선 통신에도 불구하고, 단일 슈퍼컴퓨터에서 동일 코어 수를 사용할 때 대비 약 87 %의 성능을 달성했으며, 주요 병목은 로컬 스케줄링·예약 정책임을 강조한다.

저자: Derek Groen (Leiden University), Simon Portegies Zwart (Leiden University), Tomoaki Ishiyama (NAOJ

본 논문은 전 세계에 흩어져 있는 슈퍼컴퓨터들을 하나의 거대한 계산 자원으로 결합해, 냉암물질(CDM) 우주 시뮬레이션을 수행한 사례와 그 성능 모델을 상세히 제시한다. 연구팀은 네 개의 주요 슈퍼컴퓨터(네덜란드 암스테르담의 IBM Power6, 영국 에든버러와 핀란드 에스포의 Cray XT‑4, 일본 도쿄의 Cray XT‑4)를 이용해 60~750 코어 규모의 작업을 동시에 실행하였다. 각 사이트는 1 Gbps(에든버러) 혹은 10 Gbps(기타) 인터페이스를 통해 광케이블(약 30 000 km)로 연결되었으며, 라운드‑트립 지연은 0.32 초에 달했다.

시뮬레이션 코어는 기존 GreeM 코드 기반의 Tree‑Particle‑Mesh (TreePM) 알고리즘을 사용한다. 짧은 거리 중력은 Barnes‑Hut 트리로, 긴 거리 효과는 FFT 기반 Particle‑Mesh로 계산한다. 트리 연산은 개방각 θ에 따라 정확도와 연산량을 조절할 수 있으며, θ가 클수록 근사도가 높아져 연산량이 감소한다. 메쉬 연산은 FFTW 라이브러리를 활용해 O(M log M) 복잡도로 수행한다.

SUSHI(Simulating the Universe Structure formation on Heterogeneous Infrastructures)라는 미들웨어가 핵심 역할을 한다. SUSHI는 MPWide 통신 라이브러리를 이용해 광역망 상에서 병렬 TCP 스트림을 다중으로 운영하고, 필요에 따라 포트 포워딩을 통해 간접 연결도 지원한다. 통신 토폴로지는 각 사이트가 두 이웃 사이트와 연결되는 링 구조이며, 매 시뮬레이션 스텝마다 네 가지 주요 통신 단계가 수행된다: (i) 메쉬 밀도 교환, (ii) 샘플 입자 수집을 통한 도메인 경계 재조정, (iii) 트리 구조 교환, (iv) 입자 마이그레이션.

도메인 분할은 1‑차원 슬랩 방식으로 사이트 간 입자 집합을 나누고, 각 사이트 내부에서는 3‑차원 다중 섹션 방식을 적용한다. 이렇게 하면 각 사이트는 두 이웃과만 데이터를 교환하면 되므로, 통신량이 크게 감소한다. 부하 균형은 이전 스텝의 연산 시간 t_calc,i 를 기반으로 입자 수 N_i 를 동적으로 조정하는 식(N_i ∝ 1/t_calc,i)으로 수행된다. 필요 시 경계 이동을 제한해 부하 균형을 억제할 수도 있다.

메모리 요구량은 입자당 60 byte, 트리 노드당 52 byte이며, 평균 0.75 노드/입자를 가정하면 입자당 약 99 byte가 필요하다. 따라서 N=2 048³(≈8.6 × 10⁹) 입자 시뮬레이션은 약 850 GB RAM이 필요하고, N=8 192³(≈5.5 × 10¹¹) 입자에서는 최소 54 TB가 요구된다. 이는 대규모 시뮬레이션을 실행하기 위해서는 충분한 메모리와 함께 통신 노드의 메모리 관리도 중요함을 의미한다.

성능 모델링에서는 트리 연산 시간 t_tree = 1.2 · τ_tree · n_int/p 로, n_int는 입자 수 N, 개방각 θ, 메쉬 셀 수 M에 따라 경험적으로 도출된 식(4)으로 계산한다. 메쉬 연산 시간 t_pm은 FFT 비용 τ_fft·M·log₂M와 입자당 메쉬 연산 τ_mesh·N/p 로 구성된다. 통신 시간은 로컬 LAN 지연 t_l = λ_lan·(18·log p + 2·p)와 데이터 전송량을 대역폭 σ_lan 으로 나눈 t_b 로 구분한다. WAN(광역망) 통신은 5·s+3 번의 이웃 교환을 필요로 하며, 지연 w_l = λ_wan·(5s+3), 전송량 w_b = 4·s·M + (48/θ+24)·N^{2/3} + 4·N·r_samp 로 모델링한다.

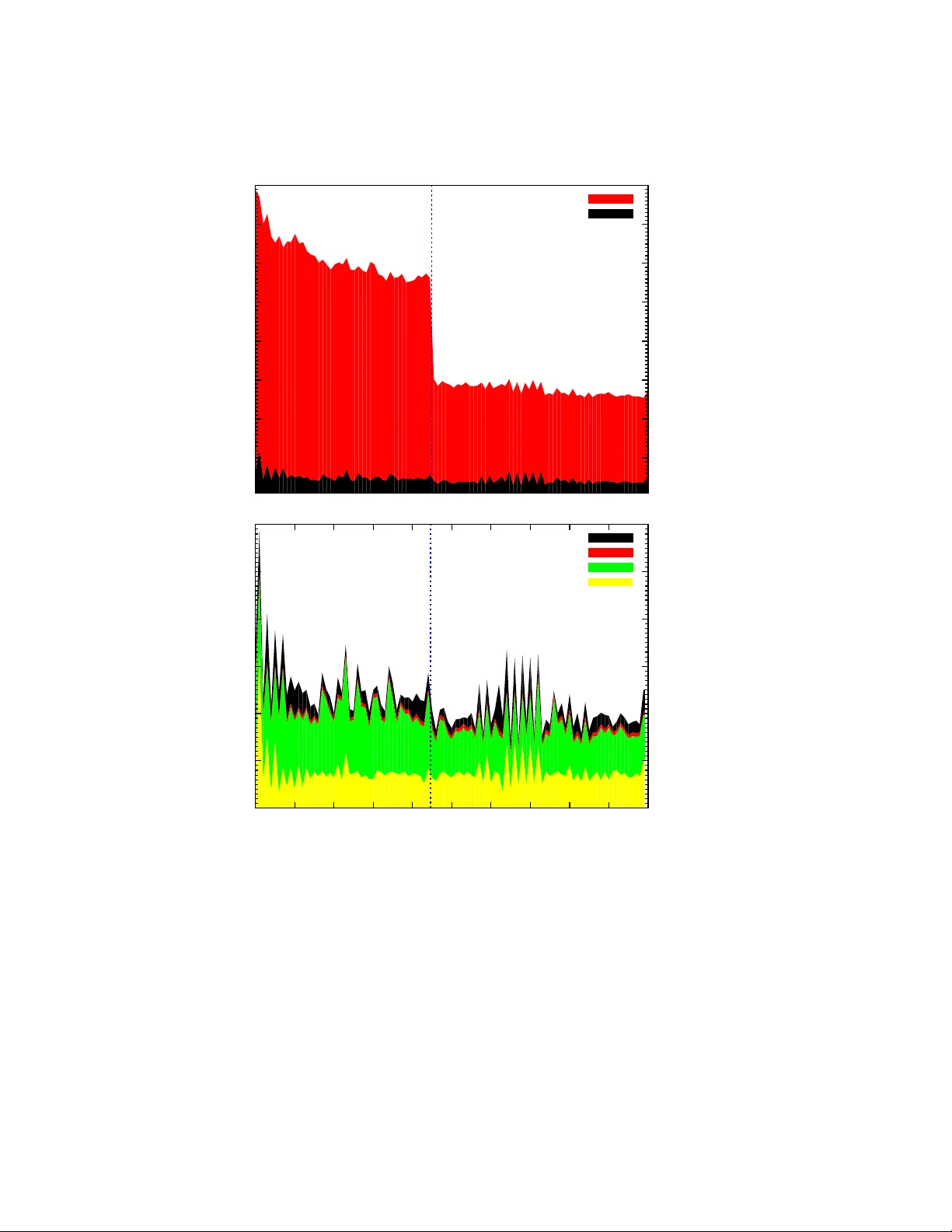

실험 결과, 120 코어(4 사이트) 구성에서 피크 성능 0.610 TFLOP/s, 지속 성능 0.375 TFLOP/s 를 달성했으며, 750 코어(5 사이트)까지 확장했을 때도 단일 슈퍼컴퓨터 대비 약 87 %의 효율을 유지했다. 이는 네트워크 지연과 대역폭 제한에도 불구하고, 효율적인 도메인 분할과 통신 최적화가 충분히 높은 스케일러빌리티를 제공한다는 것을 보여준다.

하지만 논문은 기술적 성공에도 불구하고 가장 큰 제약이 ‘로컬 스케줄링 및 예약 정책’임을 강조한다. 각 슈퍼컴퓨터는 자체 운영 정책과 배치 시스템을 가지고 있어, 전 세계적인 동시 사용을 위한 조정이 복잡하고 시간이 많이 소요된다. 따라서 향후 연구는 정책적·운영적 통합을 위한 표준화와 자동화, 그리고 더 큰 규모(수천 코어 이상)에서의 동적 부하 균형 및 파이프라인화된 통신 전략을 개발하는 방향으로 나아가야 한다.

결론적으로, 이 연구는 광역망을 통한 고성능 과학 계산이 실용적이며, 적절한 소프트웨어 스택과 알고리즘 설계가 있다면 전 세계에 흩어진 슈퍼컴퓨터를 하나의 거대한 계산 자원으로 활용할 수 있음을 입증한다. 이는 향후 exascale 시대에 다중 사이트 협업을 위한 기반 기술로서 중요한 의미를 가진다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기