거울신경망을 이용한 다중감각 패턴 인식 및 연상 기억 매핑

** 본 논문은 입력 데이터를 압축·복원하는 ‘거울신경망(MNN)’을 계층적·모듈식 구조로 결합해, 음성‑이미지 쌍을 무감독 학습으로 연관시키는 방법을 제안한다. 510‑차원 음성·이미지 데이터를 20‑차원 특징으로 축소하고, 상위 레벨 MNN이 두 감각군을 매핑함으로써 91 % 수준의 인식 정확도를 달성하였다. **

저자: Dasika Ratna Deepthi, K.Eswaran

**

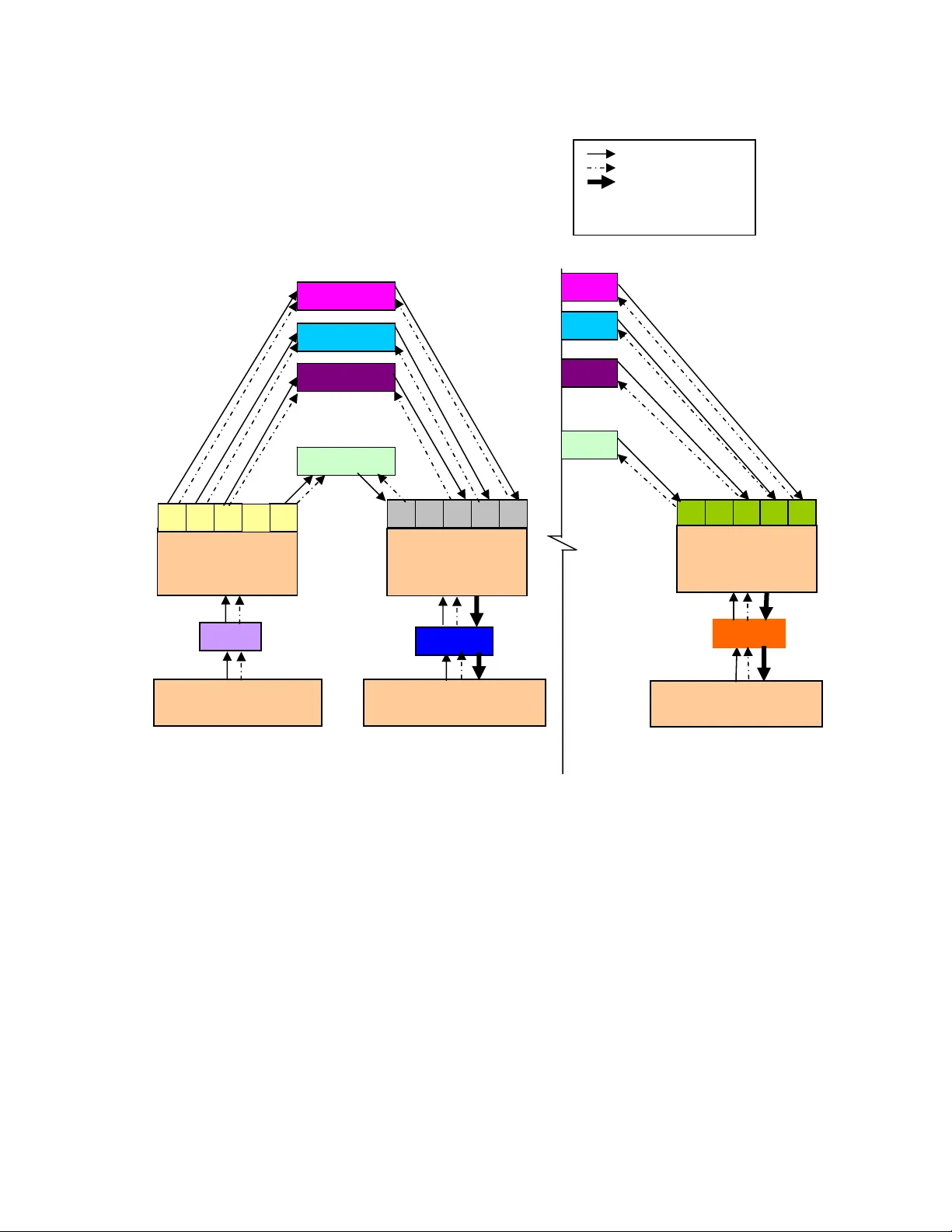

이 논문은 ‘거울신경망(Mirroring Neural Network, MNN)’이라는 특수 구조를 활용해 다중감각 패턴 인식과 연상 기억 매핑을 구현하는 새로운 학습 프레임워크를 제안한다. MNN은 입력을 압축하고 다시 복원하도록 훈련되는 수축‑팽창형 인공신경망으로, 은닉층의 저차원 출력이 입력 데이터의 핵심 특징을 담는다. 저자는 이 MNN을 계층적·모듈식 구조에 배치하여, 하위 레벨에서는 각각의 감각 입력(음성, 이미지)을 독립적으로 차원 축소하고 군집화한다. 구체적으로, 음성 신호는 2000 Hz 샘플링 후 510 점으로 재샘플링되고, 이미지는 17×30 픽셀(총 510 값)로 정규화된다. 각각은 510‑20‑510 구조의 MNN에 입력되어 20 차원 특징 벡터로 압축된다.

압축된 특징은 Forgy 군집화 알고리즘을 통해 3개의 클래스로 라벨링된다. 이 단계에서 MNN은 입력 재구성 오류를 최소화하면서도 클래스 구분에 유용한 특징을 학습한다. 이후 상위 레벨(Level II)에서는 각 클래스별로 하나씩 총 3개의 MNN이 배치되어, 하위 레벨에서 추출된 음성 특징을 대응되는 이미지 특징에 매핑한다. 즉, “음성 → 이미지” 연관 기억을 구현한다. 매핑 과정은 동일 차원의 20 차원 벡터를 입력·출력으로 사용하며, 학습은 두 MNN 사이의 입력‑출력 관계를 최소화하도록 진행된다.

실험은 Yale 얼굴 데이터베이스와 자체 수집한 음성 데이터를 이용해 수행되었다. 총 450개의 (음성, 이미지) 쌍 중 300개를 학습에 사용하고, 나머지 150개를 테스트에 활용하였다. 결과는 다음과 같다.

- Level I의 음성 MNN은 91.6 %의 정확도로 3개의 군집을 올바르게 구분했다.

- 이미지 MNN은 95.3 %의 정확도로 동일한 군집을 구분했다.

- 전체 시스템은 음성 입력을 올바른 이미지로 매핑하는 데 91.6 %의 성공률을 보였다.

이러한 성과는 단일 MNN이 20 차원 특징만으로도 복잡한 시각·청각 패턴을 구분하고 연관시킬 수 있음을 입증한다. 그러나 데이터셋이 제한적이며, 동일 화자·배경에서만 실험된 점은 일반화에 대한 의문을 남긴다. 또한, MNN의 학습 목표가 재구성 오류 최소화에 국한돼 있어, 특징이 클래스 구분에 최적화되었는지 여부를 별도로 검증할 필요가 있다. Forgy 군집화는 초기 중심 선택에 따라 결과가 달라질 수 있어 재현성 문제가 존재한다.

저자는 이 구조가 인간 신피질의 ‘신경 모듈화·계층적 통합’을 모사한다며, 감각 채널을 늘리고 더 깊은 계층을 추가하면 보다 복잡한 인과 관계 학습이 가능하다고 주장한다. 향후 연구 방향으로는 (1) 다중감각(촉각, 후각 등) 통합, (2) 동시 학습을 위한 시간적 연관성 모델링, (3) 딥 클러스터링·자기지도 학습 기법 도입을 제시한다. 이러한 확장은 현재 제안된 MNN 기반 프레임워크를 보다 일반적인 인공지능 시스템, 특히 인간 뇌의 연합 기억 메커니즘을 모방한 학습 엔진으로 발전시킬 수 있는 기반이 된다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기