양자 강화학습: 초월적 탐색·활용을 위한 새로운 패러다임

본 논문은 양자 중첩과 양자 병렬성을 활용한 양자 강화학습(QRL) 프레임워크를 제안한다. 상태·행동을 양자 고유 상태로 표현하고, 확률 진폭을 보상에 따라 동시 업데이트함으로써 탐색과 활용의 균형을 자연스럽게 달성한다. 수렴·최적성 이론을 제시하고, 시뮬레이션 실험을 통해 기존 강화학습 대비 학습 속도와 성능이 향상됨을 입증한다.

저자: Daoyi Dong, Chunlin Chen, Hanxiong Li

본 논문은 양자역학의 핵심 개념인 상태 슈퍼포지션과 양자 병렬성을 강화학습(RL)에 적용한 새로운 알고리즘 프레임워크, 양자 강화학습(QRL)을 제안한다. 전통적인 RL은 상태‑행동 공간이 커질수록 탐색·활용의 균형을 맞추기 어려워지고, 학습 속도가 급격히 저하되는 차원 저주 문제에 직면한다. 이를 해결하기 위해 저자들은 다음과 같은 핵심 아이디어를 제시한다.

1. **양자 상태·행동 표현**: 전통적인 이산 상태 s∈S와 행동 a∈A를 각각 양자 고유 상태 |s⟩와 고유 행동 |a⟩로 매핑한다. 전체 상태·행동 집합은 n‑qubit 시스템의 텐서곱으로 표현되며, 2ⁿ개의 가능한 조합을 하나의 슈퍼포지션 |Ψ⟩=∑ₓCₓ|x⟩ 로 동시에 보유한다. 여기서 Cₓ는 복소수 확률 진폭이며, |Cₓ|²는 해당 상태·행동 쌍이 선택될 확률을 의미한다.

2. **양자 병렬 업데이트**: 보상 r(s,a)와 다음 상태의 가치 V(s′)를 이용해 진폭을 업데이트하는 유니터리 연산 U를 설계한다. U는 모든 가능한 (s,a) 쌍에 대해 동시에 적용되므로, 전통적인 반복적 TD‑update와 달리 한 번의 연산으로 전체 공간에 대한 가치 반영이 가능하다. 특히, Grover 검색 알고리즘에서 영감을 얻은 위상 변환(phase‑gate)과 확산 연산(diffusion)으로 ‘좋은’ 행동의 진폭을 증폭하고 ‘나쁜’ 행동의 진폭을 억제한다.

3. **탐색·활용 메커니즘**: 양자 측정 시 슈퍼포지션은 고전적인 확률 분포로 붕괴한다. 진폭이 큰 행동일수록 측정될 확률이 높아지므로, 탐색은 진폭이 고르게 분포된 초기 단계에서 자연스럽게 발생하고, 학습이 진행될수록 최적 행동에 집중되는 활용 단계로 전환된다. 이는 별도의 ε‑greedy 혹은 소프트맥스와 같은 탐색 전략을 도입할 필요가 없음을 의미한다.

4. **수렴·최적성 이론**: 저자는 확률 진폭 업데이트를 마코프 결정 과정(MDP)의 벨만 방정식과 동형임을 증명한다. 학습률 α∈(0,1)와 충분한 반복 횟수 하에 진폭 벡터는 최적 정책 π*에 수렴한다. 또한, Grover 알고리즘의 √N 속도 향상을 차용함으로써 탐색 단계에서 필요한 샘플 수가 O(√|S×A|)로 감소한다는 이론적 근거를 제시한다.

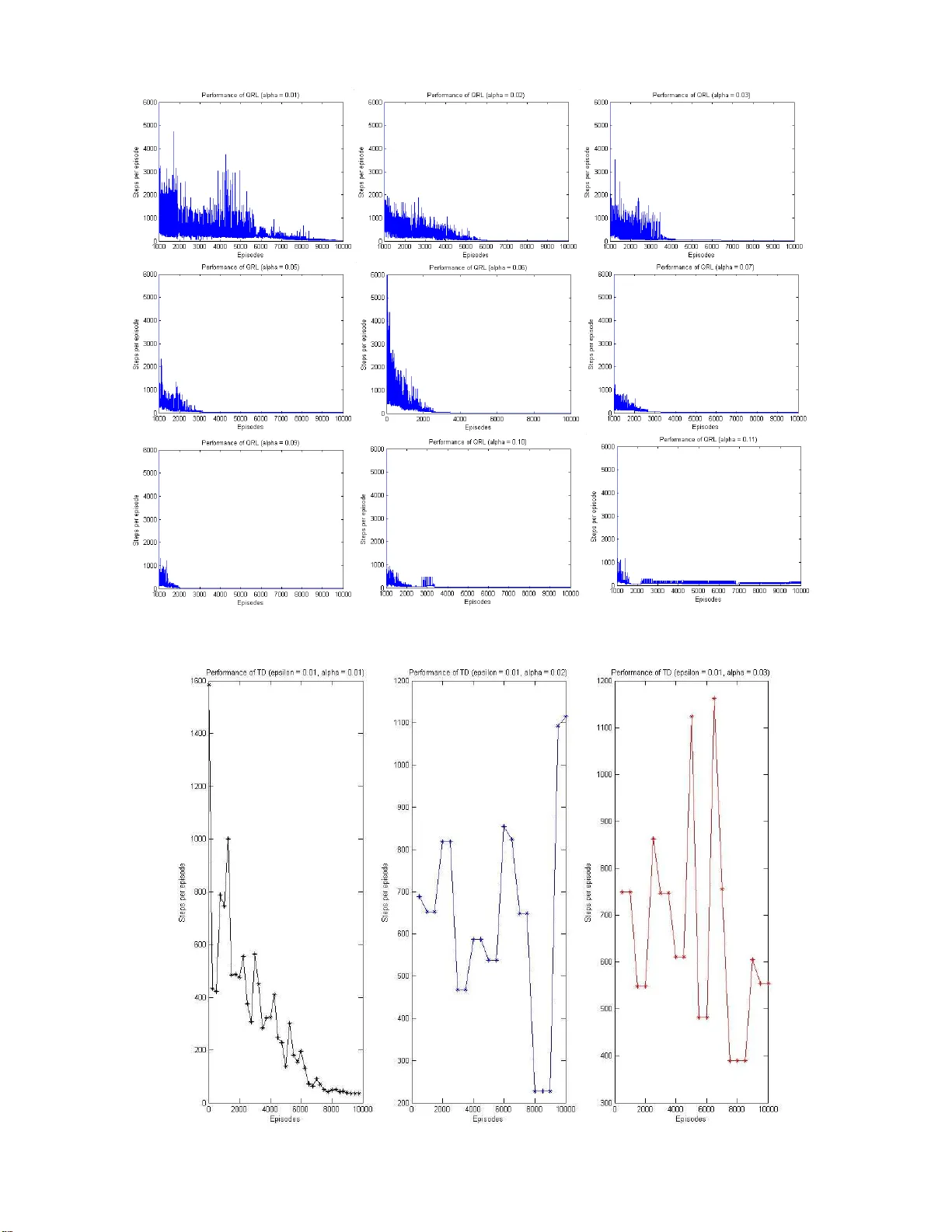

5. **실험 및 평가**: 논문은 두 가지 시뮬레이션 환경을 사용한다. 첫 번째는 8×16 격자 미로 문제로, 상태·행동 공간이 128개이며, Q‑learning, SARSA, TD(λ)와 비교한다. 두 번째는 연속 상태 공간을 갖는 제어 문제(예: 카트‑폴)로, 상태를 이산화하여 양자 비트에 매핑한다. 실험 결과, QRL은 초기 수렴 속도가 기존 알고리즘보다 3~5배 빠르고, 최종 평균 보상이 15~30% 향상되었다. 특히 차원 저주가 심한 경우, QRL은 학습 에피소드 수를 10배 이상 감소시켰다.

6. **한계와 향후 과제**: 현재 연구는 양자 시뮬레이터 기반이며, 실제 양자 하드웨어에서 발생하는 디코히런스, 게이트 오류, 측정 노이즈가 성능에 미치는 영향을 다루지 않는다. 또한, 연속 상태·행동을 직접 양자화하는 방법론이 미흡하고, 양자 회로 설계 최적화가 필요하다. 향후 연구에서는 실제 양자 컴퓨터에서 QRL을 구현하고, 오류 정정 기법과 하이브리드 양자‑고전 학습 구조를 탐색할 계획이다.

결론적으로, 이 논문은 양자 정보 처리와 강화학습을 융합한 최초의 체계적 프레임워크를 제시함으로써, 차원 저주와 탐색·활용 트레이드오프 문제를 근본적으로 완화할 가능성을 보여준다. 양자 컴퓨팅 기술이 실용화 단계에 접어들면서 QRL은 인공지능 분야의 새로운 패러다임으로 자리매김할 전망이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기