ABC PRC 알고리즘의 근본적 결함과 개선 방안

본 논문은 Sissons et al. (2007)의 ABC‑PRC 알고리즘이 가중치를 무시함으로써 사후분포를 정확히 추정하지 못한다는 점을 간단한 정규 평균 예제로 입증하고, 가중치를 도입한 수정 버전을 제시한다.

저자: Mark A. Beaumont

이 논문은 Sissons, Fan, Tanaka가 2007년 PNAS에 발표한 ABC‑PRC(Approximate Bayesian Computation – Population Monte Carlo Rejection) 알고리즘의 근본적인 결함을 실험과 이론을 통해 밝히고, 간단한 정규 평균 추정 예제를 통해 그 문제점을 구체적으로 보여준다.

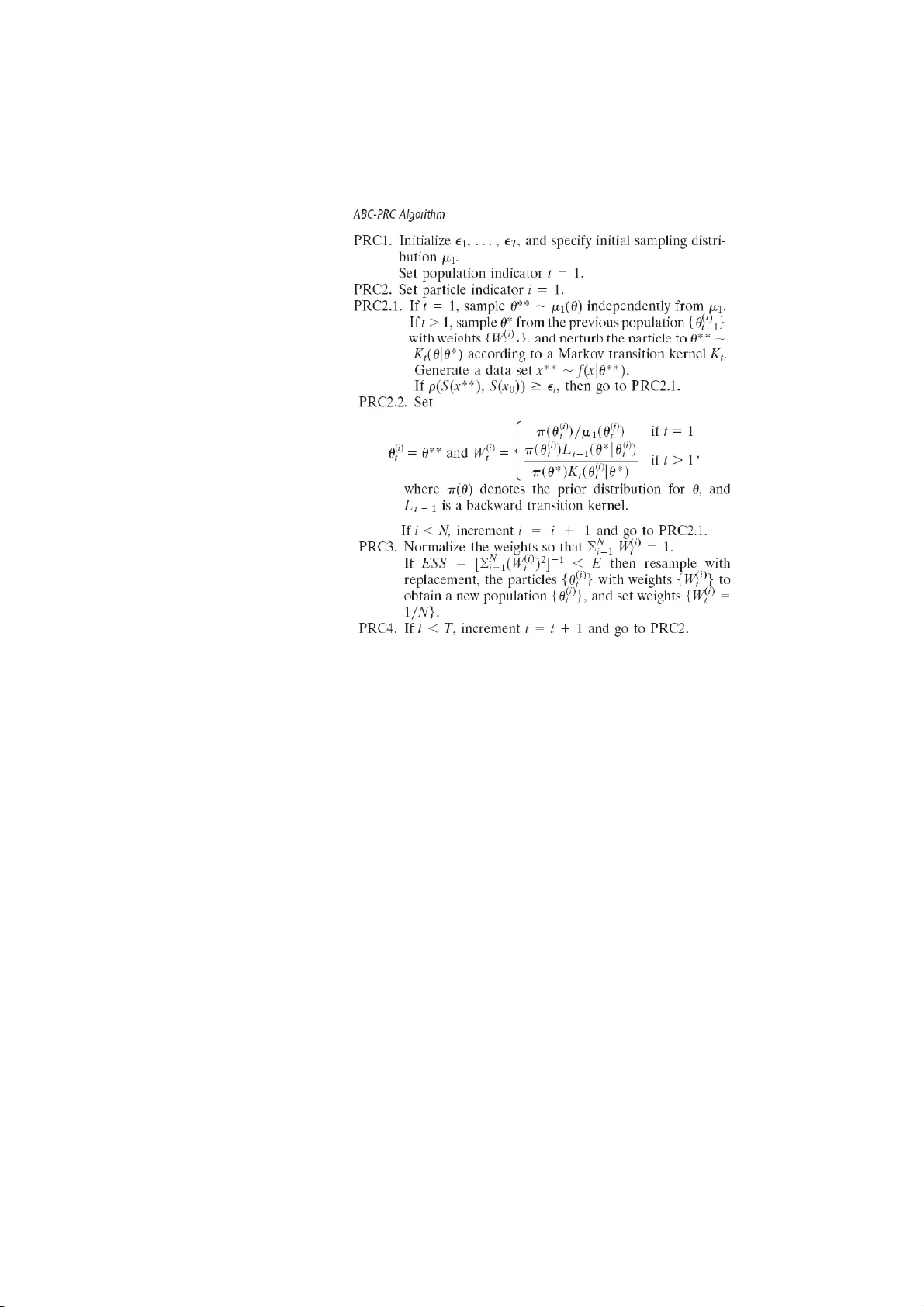

첫 번째 섹션에서는 ABC‑PRC 알고리즘의 기본 구조를 소개한다. 알고리즘은 N개의 파티클을 사용하고, 각 파티클은 요약통계량 S(x)와 관측 요약통계량 S(x₀) 사이의 거리 ρ가 허용 오차 ε 이하가 될 때까지 반복적으로 시뮬레이션한다. 논문에서는 Sissons et al.이 “모든 가중치를 동일하게 두고 무시한다”는 가정을 기반으로 알고리즘을 단순화했으며, 이는 실제 샘플링 과정에서 큰 문제를 일으킨다고 주장한다.

두 번째 섹션에서는 문제점에 대한 직관적인 설명을 제공한다. 전이 커널 K_t(θ_t|θ_{t‑1})의 분산이 작을 경우, 파라미터 샘플이 이전 단계의 사후분포에서 거의 변하지 않는다. 이는 마르조람(2003)의 ABC‑MCMC와는 다르게, 거절될 때까지 무한히 시도하는 구조 때문에 사후분포가 점점 제곱되는 형태(p(θ|x)^i)로 변형된다. 결과적으로 사후분포가 과도하게 좁아져 실제 분산보다 훨씬 작아진다.

세 번째 섹션에서는 구체적인 실험을 제시한다. 평균 μ와 알려진 분산 σ²를 갖는 정규 모델을 사용하고, 평탄한 균등 사전(−15, 15)에서 시작한다. 관측값 평균은 4.786624, 표본 크기 n=10, σ²=9이며, 이론적인 사후분포는 평균 4.786624, 분산 0.9이다. 알고리즘을 100번 반복하면서 ε를 단계적으로 감소시키고, 전이 커널의 분산을 0.01, 0.1, 1, 10 등으로 바꾸어 실험한다.

실험 결과는 다음과 같다. 커널 분산이 0.1일 때 추정된 사후분산은 약 0.26, 0.01일 때는 0.094, 즉 이론값보다 크게 낮다. 커널 분산을 1로 늘리면 추정값이 0.59로 개선되지만 여전히 부족하고, 10으로 늘리면 0.84 정도가 된다. 이는 커널 분산이 클수록 원래 알고리즘이 “거절 기반”에 가까워져 사후분포를 더 잘 근사하지만, 여전히 가중치를 무시한다는 근본적인 오류는 남아 있다.

네 번째 섹션에서는 가중치 보정 방법을 제안한다. 각 파티클 i에 대해 이전 단계 파티클 j로부터의 전이 확률 p(θ_{t,i}|θ_{t‑1,j}, ξ²)를 계산하고, 그 역수를 가중치 W_{t,i}=1/∑_j p(·)로 설정한다. 이 가중치를 적용하면, 동일한 실험에서 커널 분산이 0.01일 때 사후분산이 0.88에 근접해 이론값(0.9)과 거의 일치한다. 즉, 알고리즘 자체는 틀린 것이 아니라 가중치를 누락한 것이 문제였으며, 간단한 가중치 보정만으로 정확한 사후분포 추정이 가능함을 보여준다.

마지막으로 부록에서는 원본 ABC‑PRC와 가중치 보정 버전의 R 구현 코드를 제공한다. 두 구현은 거의 동일하지만, 보정 버전은 샘플링 단계에서 파티클 선택 확률에 가중치를 반영하고, 각 파티클에 대해 위에서 정의한 역확률 가중치를 계산한다. 시각화된 결과(Figure 2~11)는 가중치 적용 전후의 차이를 명확히 보여주며, 특히 Figure 10과 11은 보정된 알고리즘이 원본보다 훨씬 정확하게 사후분산을 복원함을 확인한다.

결론적으로, 본 논문은 ABC‑PRC 알고리즘이 “무가중치 SMC” 형태임을 밝히고, 가중치를 무시함으로써 사후분포가 왜곡되는 메커니즘을 상세히 설명한다. 제안된 가중치 보정은 계산량이 거의 추가되지 않으며, 기존 ABC‑PRC를 그대로 사용하면서도 정확한 베이지안 추정을 가능하게 한다. 따라서 향후 SMC 기반 ABC 연구에서는 반드시 가중치 계산을 포함시켜야 함을 강력히 권고한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기