노이즈 사전학습이 암시적 신경표현에 가져온 놀라운 효과

초록

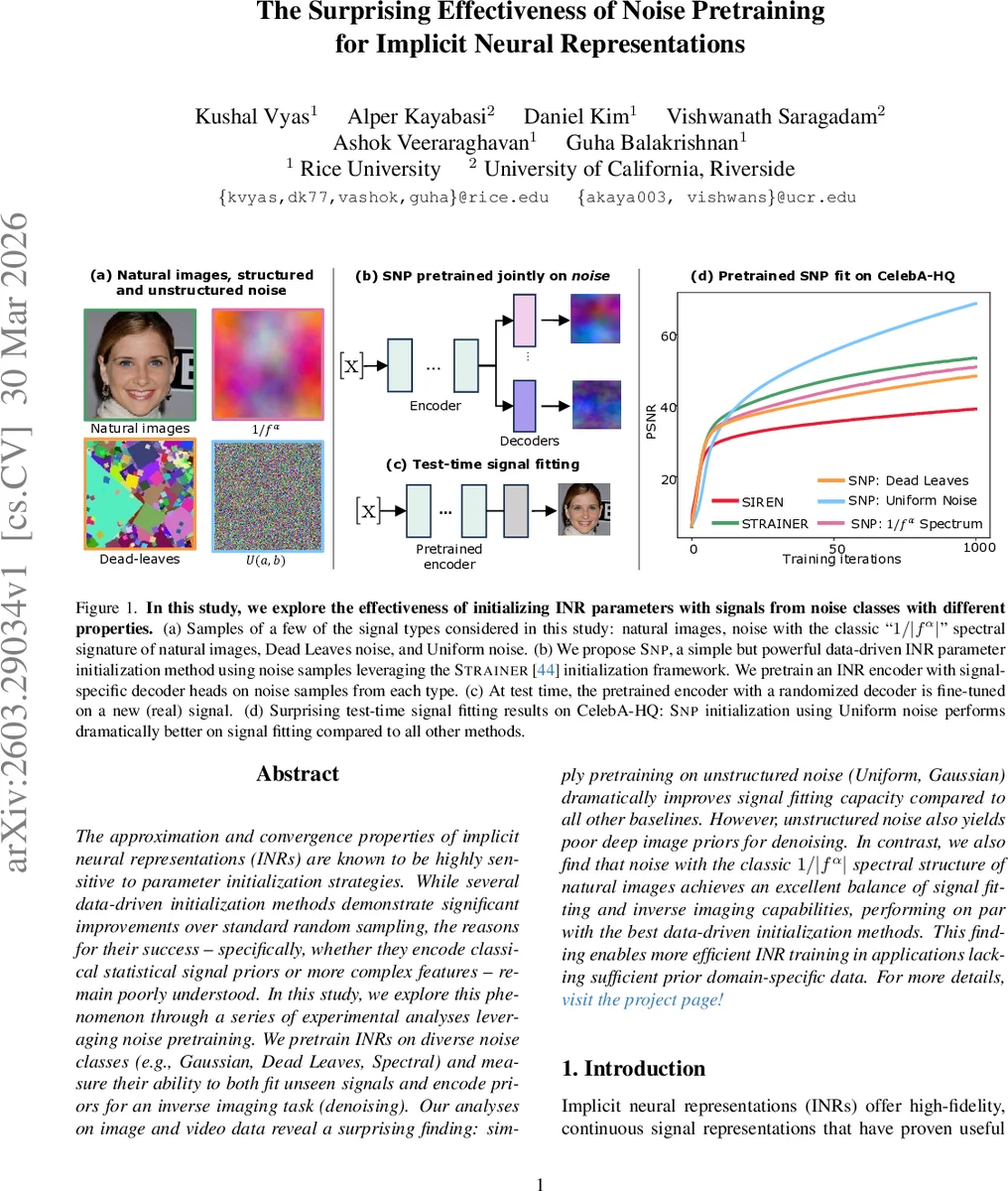

본 연구는 다양한 종류의 노이즈(Uniform, Gaussian, Dead‑Leaves, 1/|f^α| 스펙트럼)를 이용해 암시적 신경표현(INR)을 사전학습한 뒤, 실제 이미지·비디오 신호에 대한 적합성과 역영상(denoising) 성능을 평가한다. 실험 결과, 구조가 없는 Uniform·Gaussian 노이즈로 사전학습한 INR은 신호 적합도(PSNR)에서 기존 데이터‑기반 초기화 방법들을 크게 앞섰지만, 깊은 이미지 프라이어를 활용한 역영상 성능은 떨어진다. 반면, 자연 이미지와 동일한 1/|f^α| 스펙트럼을 가진 구조화된 노이즈는 신호 적합도와 역영상 모두에서 균형 잡힌 우수한 성능을 보여, 실제 데이터가 부족한 상황에서도 효과적인 초기화 전략이 될 수 있음을 시사한다.

상세 분석

본 논문은 INR이 파라미터 초기화에 극도로 민감하다는 기존 연구를 출발점으로, “노이즈 사전학습”이라는 새로운 관점을 제시한다. 저자들은 SIREN 기반의 6‑layer MLP를 사용하고, 인코더와 디코더를 분리한 STRAINER 구조를 변형해 SNP(STRAINER Noise Pretraining)라는 프레임워크를 구축하였다. 사전학습 단계에서는 N≈10개의 노이즈 샘플(Uniform, Gaussian, Dead‑Leaves, 스펙트럼 노이즈 등)을 이용해 인코더를 공동 학습시키고, 테스트 단계에서는 사전학습된 인코더와 무작위 초기화된 디코더를 결합해 실제 이미지·비디오에 2000번 정도의 최적화를 수행한다.

실험 결과는 두 가지 중요한 현상을 드러낸다. 첫째, 구조가 전혀 없는 Uniform·Gaussian 노이즈로 사전학습한 INR은 PSNR이 80 dB 이상에 달할 정도로 빠른 수렴과 높은 재구성 정확도를 보였다. 이는 기존 메타러닝, 트랜스퍼러닝, IPC 등 복잡한 데이터‑기반 초기화 방법들을 모두 능가한다. 그러나 이러한 “무구조” 노이즈는 이미지 디노이징 같은 역영상 작업에서 깊은 이미지 프라이어를 충분히 제공하지 못해, SIREN이나 STRAINER와 비교해 PSNR·SSIM이 현저히 낮았다.

둘째, 1/|f^α| 스펙트럼을 갖는 구조화된 노이즈는 신호 적합도와 역영상 성능 사이에서 최적의 트레이드오프를 제공한다. 스펙트럼 노이즈는 자연 이미지가 보이는 저주파‑고주파 균형을 그대로 유지하면서도, 노이즈 자체가 가진 통계적 규칙성(예: 파워 스펙트럼의 α‑값) 덕분에 인코더가 유용한 저주파와 고주파 특징을 동시에 학습한다. 결과적으로, 이 초기화는 STRAINER와 거의 동등한 PSNR·SSIM을 달성하면서도, 사전학습에 실제 이미지 데이터를 전혀 사용하지 않아도 된다.

이러한 발견은 INR 초기화가 반드시 “고수준 의미적 특징”을 학습해야 하는 것이 아니라, 이미지 통계(특히 스펙트럼 분포)와 같은 저수준 신호 특성을 캡처하는 것이 핵심일 수 있음을 시사한다. 또한, 데이터가 부족한 과학·의료 영상 분야에서 손쉽게 생성 가능한 스펙트럼 노이즈를 활용해 효율적인 사전학습 파이프라인을 구축할 수 있는 실용적 길을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기