텍스트‑이미지 변환기에서 컨텍스추얼 공간 반발을 통한 다양성 향상

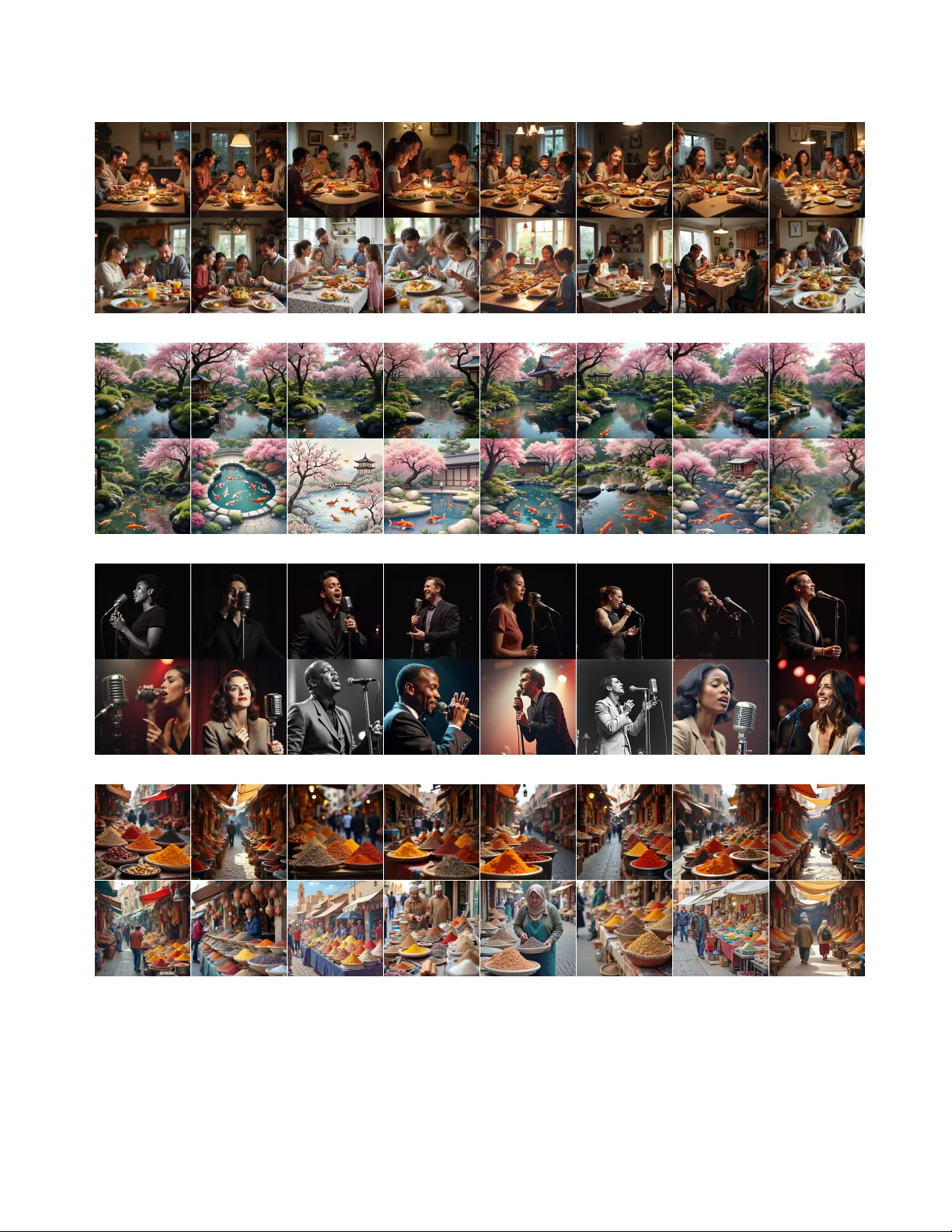

본 논문은 Diffusion Transformer(DiT)의 멀티모달 어텐션 블록에서 생성되는 텍스트 토큰(컨텍스추얼 공간)에 직접 반발(repulsion) 신호를 주입함으로써, 기존의 입력‑또는 라틴트‑공간 조작이 초래하는 품질 저하 없이 풍부한 이미지 다양성을 달성한다. 배치 샘플 간의 von Neumann 엔트로피 기반 손실을 이용해 토큰을 서로 멀어지게 하며, 초기 몇 단계에서만 적용해 계산 비용을 최소화한다. 실험 결과 COCO 벤치마…

저자: Omer Dahary, Benaya Koren, Daniel Garibi

현대 텍스트‑투‑이미지(T2I) 디퓨전 모델은 프롬프트와의 정밀한 의미 정렬을 달성했지만, 동일 프롬프트에 대해 제한된 시각적 해답만을 제공하는 전형성 편향에 시달린다. 이 문제는 창의적 활용에서 다양성이 핵심 요구사항이 되는 상황에서 큰 장애가 된다. 기존 연구는 크게 두 축으로 나뉜다. 첫 번째는 초기 노이즈나 프롬프트 임베딩을 변형하는 업스트림 방식으로, 구조적 피드백이 부족해 다양성을 확보하려면 비용이 많이 드는 최적화가 필요하다. 두 번째는 디노이징 과정 중 이미지 라틴트에 직접 반발을 가하는 다운스트림 방식으로, 시각적 구조가 이미 고정된 뒤에 작동해 데이터 매니폴드를 벗어나 아티팩트를 초래한다.

이 논문은 이러한 딜레마를 해결하기 위해 Diffusion Transformer(DiT) 내부의 멀티모달 어텐션 블록에서 생성되는 ‘컨텍스추얼 공간’을 활용한다. DiT는 텍스트와 이미지 토큰을 동시에 처리하며, 각 블록 l에서 텍스트 토큰 f_T와 이미지 토큰 f_I가 MM‑Attn을 통해 상호작용한다. 이 과정에서 텍스트 토큰은 이미지 토큰으로부터 현재 시각적 구성을 지속적으로 받아들여, 프롬프트 의미와 이미지 구조가 결합된 풍부한 표현 ˆf_T(l)으로 변환된다. 저자들은 이 ˆf_T(l)를 컨텍스추얼 공간의 핵심 요소로 정의하고, 토큰 순서가 의미적으로 고정돼 있어 배치 내 샘플 간 비교가 용이하다고 강조한다.

구체적인 방법은 배치 B개의 샘플을 입자 집합으로 보고, 각 어텐션 블록 내부에서 토큰에 반발(repulsion) 신호를 주입하는 것이다. 이를 위해 von Neumann 엔트로피 기반의 다양성 손실 L_div를 사용한다. 각 샘플 i의 컨텍스추얼 토큰을 평탄화해 벡터 c_i로 만든 뒤, 코사인 유사도로 구성된 커널 행렬 K를 만든다. 정규화된 K의 고유값 λ_k에 대해 −∑λ_k log λ_k를 손실로 정의하고, 토큰에 대한 그래디언트를 계산해 η ∇L_div 만큼 업데이트한다. 이 연산은 모델 파라미터에 대한 역전파를 필요로 하지 않으며, 각 블록마다 M번의 간단한 내부 반복만 수행한다.

시간적 측면에서 저자들은 초기 몇 타임스텝(예: t ∈

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기