선형 탐색을 멈추고 코딩을 시작하라: 선형 프로브와 희소 자동인코더가 조합 일반화에 실패하는 이유

이 논문은 초과표현(superposition) 상황에서 개념이 선형 혼합으로 인코딩되더라도, 투영으로 인해 선형 결정 경계가 비선형으로 변한다는 점을 지적한다. 전통적인 희소 코딩은 샘플별 반복 추론을 통해 압축 센싱 이론을 활용해 잠재 요인을 복구할 수 있지만, 희소 자동인코더(SAE)는 고정 인코더로 추론을 amortize하면서 체계적인 ‘amortisation gap’를 만든다. 실험 결과, 이 격차는 사전학습 데이터 규모, 차원, 희소도…

저자: Vitória Barin Pacela, Shruti Joshi, Isabela Camacho

본 논문은 대형 언어 모델(LLM)의 내부 표현을 해석하기 위한 “선형 표현 가설”(LRH)의 한계를 체계적으로 분석한다. LRH는 모델 활성화 y가 잠재 개념 z의 선형 혼합 y≈Wz 로 표현된다고 주장하지만, 차원 d_z > d_y 인 초과표현(superposition) 상황에서는 W가 고차원 공간을 저차원으로 압축하는 투영 역할을 한다. 이때 z‑space 에서 선형적으로 구분되는 클래스가 y‑space 에서는 비선형 경계가 되므로, 선형 프로브는 OOD 상황에서 급격히 성능이 저하된다(그림 1).

이를 해결하기 위해 논문은 압축 센싱 이론을 도입한다. z 가 k‑sparse 라는 가정 하에, Wh=y 를 만족하는 k‑sparse 코드 h 를 비선형 최적화(예: Basis Pursuit, ISTA, FISTA)로 복구할 수 있다. 핵심은 사전 W 가 RIP 혹은 spark >2k 와 같은 조건을 만족하는데, 이는 d_y ≥ O(k·log(d_z/k)) 차원만 있으면 가능함을 이론적으로 제시한다.

전통적인 희소 코딩은 샘플별 반복 추론을 사용해 위 조건을 만족한다. 반면, 희소 자동인코더(SAE)는 인코더 r(y)를 고정함으로써 추론을 amortise한다. 이 과정에서 두 가지 문제가 발생한다. 첫째, 인코더는 훈련 데이터의 공동출현 구조에 맞춰 학습되므로, 새로운 조합(즉, OOD 조합)에서는 지원 집합을 올바르게 선택하지 못한다. 둘째, 더 근본적인 문제는 사전 W 자체가 학습 과정에서 잘못된 방향을 가리키는 것이다. 실험에서는 SAE‑learned 사전과 동일한 사전 위에 샘플별 FISTA 를 적용해도 성능 차이가 거의 없으며, 이는 “amortisation gap” 가 사전 학습에서 비롯된다는 강력한 증거다.

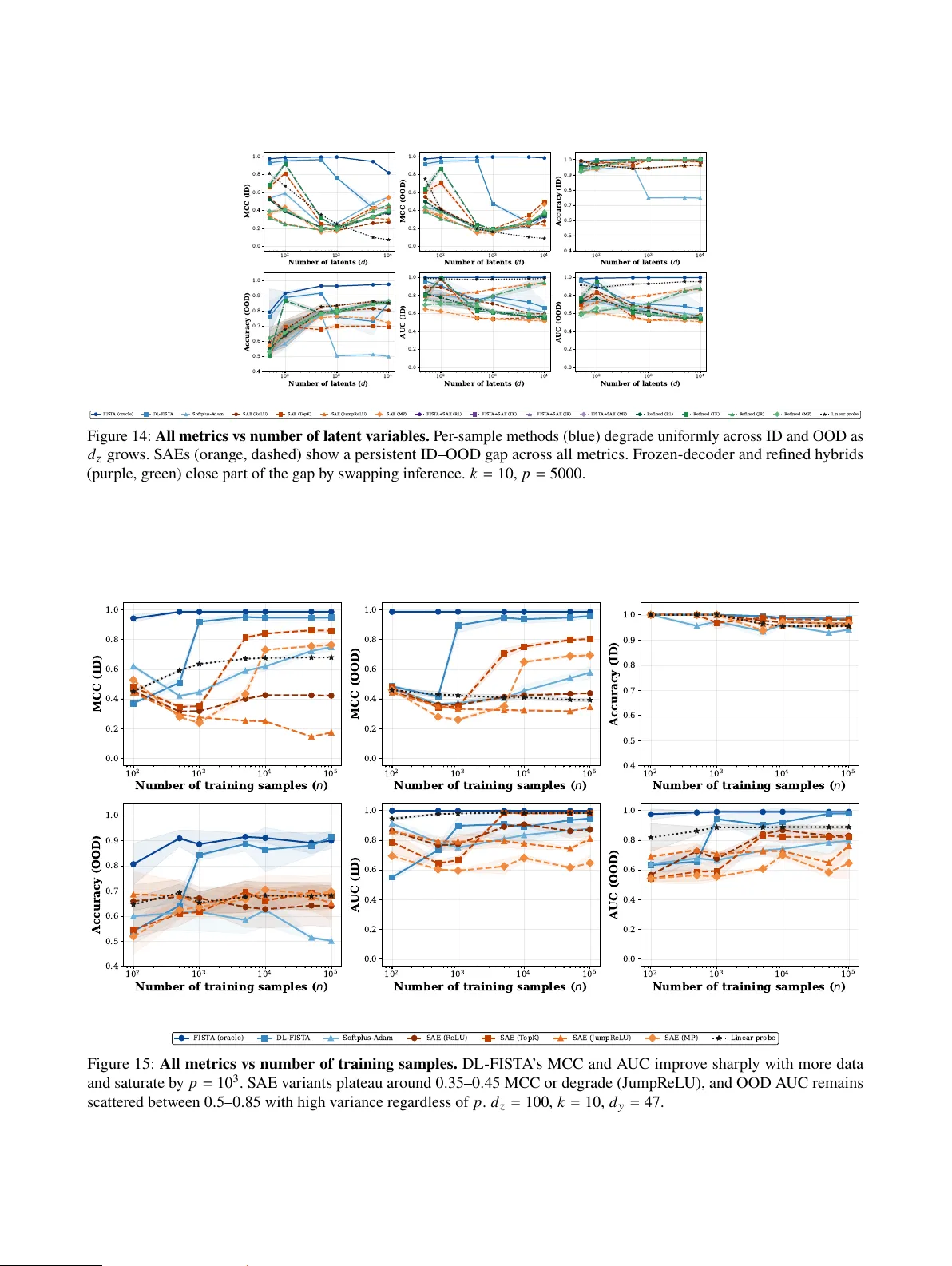

논문은 다양한 실험을 통해 이 주장을 검증한다. (1) 훈련·테스트 데이터 규모, 잠재 차원 d_z, 희소도 k 를 변화시켜도 SAE와 샘플별 추론 간 격차는 지속된다. (2) “oracle baseline” 으로서 진짜 사전(ground‑truth W)과 샘플별 FISTA 를 결합하면 모든 규모에서 거의 완벽한 복구율을 달성한다. (3) 전통적인 사전 학습 방법(DL‑FISTA)도 차원이 커질수록 사전 품질이 급격히 저하되어 OOD 복구가 실패한다.

이러한 결과는 SAE의 실패 원인이 인코더의 amortisation이 아니라 사전 학습의 부정확성에 있음을 명확히 한다. 따라서 향후 연구는 (a) 초과표현 상황에서도 RIP 를 만족하는 대규모 사전을 효율적으로 학습하는 알고리즘 개발, (b) 학습된 사전을 활용한 샘플별 비선형 추론(FISTA 등)의 실시간 적용 가능성 탐구, (c) 사전 학습과 추론을 분리하여 각각 최적화하는 하이브리드 프레임워크 설계에 초점을 맞춰야 한다.

결론적으로, 논문은 (i) 선형 프로브는 초과표현 상황에서 근본적인 한계가 있음을, (ii) SAE의 OOD 실패는 인코더가 아니라 사전 학습의 문제임을, (iii) 압축 센싱 이론에 부합하는 고품질 사전이 확보된다면 샘플별 비선형 추론은 OOD 조합에서도 정확히 작동한다는 점을 입증한다. 이는 대규모 언어 모델 해석에서 희소 코딩을 재도입하고, 사전 학습을 전용 최적화 문제로 다루는 새로운 연구 방향을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기