전이학습에서 보조 데이터가 일반화 오류를 감소시키는 조건과 최적 가중치 설계

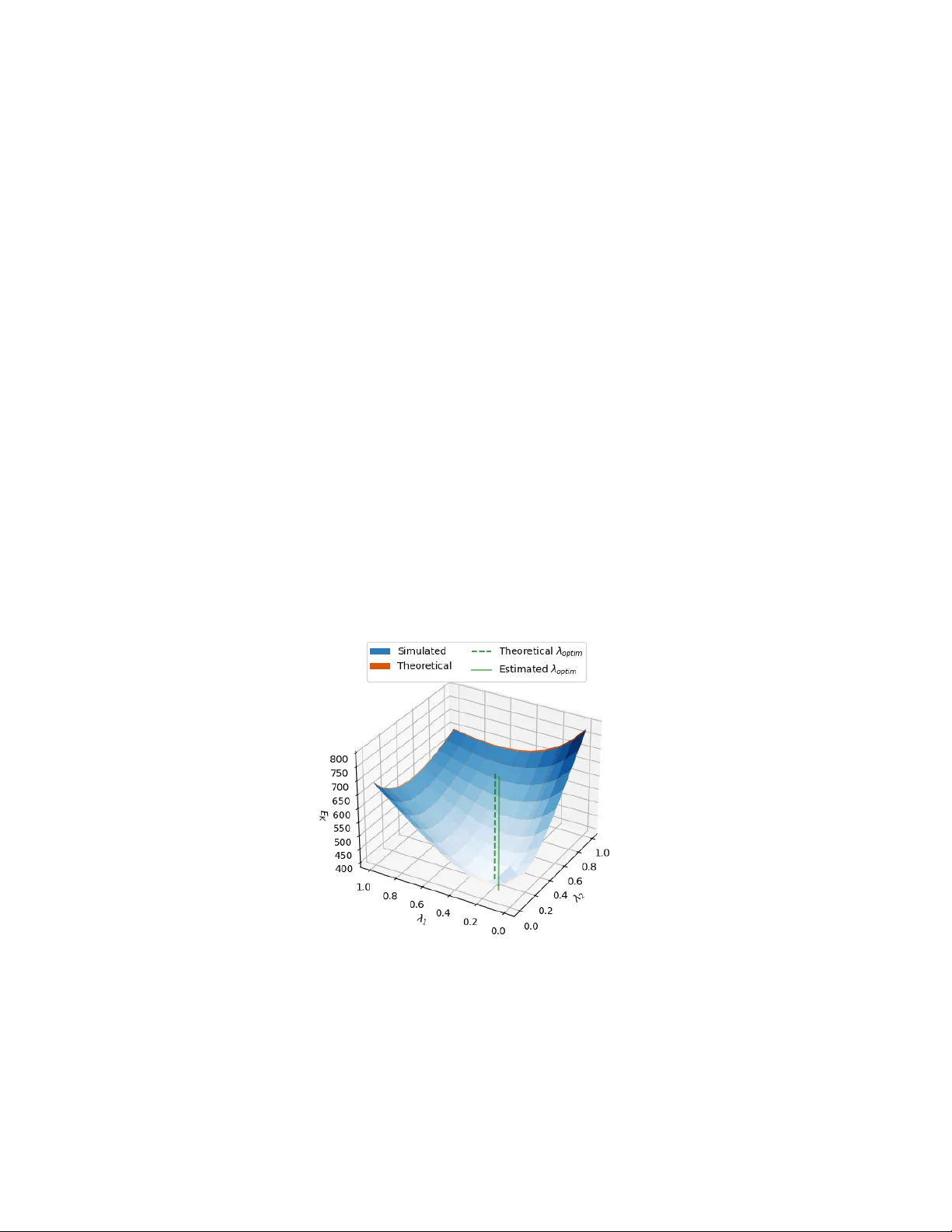

본 논문은 선형 회귀와 차원 제한된 선형 신경망 두 모델에서 보조 작업을 활용한 전이학습의 기대 일반화 오류를 정확히 분석한다. 선형 회귀에서는 편향‑분산 분해를 통해 오류식의 닫힌 형태를 도출하고, 보조 작업의 가중치 총합에 대한 필요충분조건과 최적 가중치를 구한다. 선형 신경망에서는 새로운 열‑별 저랭크 교란 경계치를 이용해 비공백적인 충분조건을 제시하고, 가중치 설계가 오류 감소에 미치는 영향을 정량화한다. 실험은 합성 데이터로 검증한다.

저자: Meitong Liu, Christopher Jung, Rui Li

본 논문은 전이학습에서 보조 데이터가 메인 작업의 일반화 성능을 향상시키는 메커니즘을 선형 회귀와 선형 신경망이라는 두 가지 대표적인 선형 모델을 통해 심층적으로 분석한다.

**1. 문제 설정 및 기본 가정**

- 데이터는 공유 피처 행렬 X∈ℝ^{N×d}와 메인 라벨 Y_m, K개의 보조 라벨 Y_k 로 구성된다.

- X의 각 행은 평균 0, 공분산 Σₓ (‖Σₓ‖=1, 최소 고유값>0)를 갖는 정규분포에서 독립적으로 샘플링된다.

- 라벨은 선형 모델 Y_t = X w*_t + ε_t 로 생성되며, ε_t는 평균 0, 분산 σ_t²인 정규 잡음이다.

- N>d+1 (선형 회귀) 혹은 N>d+3 (선형 신경망) 이며, K+1≪d 로 가정한다.

**2. 선형 회귀 분석**

- 목표는 가중합 손실 L(w)=‖Xw−Y_m‖²+∑_{k=1}^K λ_k‖Xw−Y_k‖² 를 최소화하는 ˆw_D 를 구하는 것이다.

- 해는 ˆw_D = (1+Λ)^{-1}(XᵀX)^{-1}Xᵀ(Y_m+∑λ_k Y_k) 로, 각 작업의 OLS 해의 가중 평균 형태임을 보인다(식 2).

- 기대 일반화 오류 E_K = E_{D,(x,y_m)}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기