다양한 스타일을 포괄하는 듀얼 인코더 음성 텍스트 사전학습 모델 ParaSpeechCLAP

ParaSpeechCLAP은 음성 클립과 풍부한 자연어 스타일 캡션을 동일한 임베딩 공간에 정렬하는 듀얼 인코더 대비학습 모델이다. 내재적(화자 수준)과 상황적(발화 수준) 스타일을 각각 전문화한 Intrinsic·Situational 모델과 두 데이터를 통합한 Combined 모델을 제안하고, 스타일 캡션 검색, 속성 분류, TTS 스타일 가이드 등 세 가지 응용에서 기존 베이스라인을 크게 능가한다.

저자: Anuj Diwan, Eunsol Choi, David Harwath

본 논문은 음성 및 텍스트 스타일 캡션을 동일한 임베딩 공간에 정렬하는 듀얼 인코더 대비학습 모델인 ParaSpeechCLAP을 제안한다. 기존 연구들은 감정이나 몇 가지 톤과 같이 제한된 스타일 레이블만을 다루었으나, 실제 음성은 화자 고유의 피치, 텍스처, 명료도와 같은 내재적 특성뿐 아니라 감정, 억양, 상황적 맥락 등 다양한 속성을 포함한다. 이러한 격차를 메우기 위해 저자들은 풍부한 스타일 태그와 자연어 캡션을 제공하는 대규모 데이터셋 ParaSpeechCaps를 구축하였다. 데이터는 Expresso, EARS, VoxCeleb, Emilia 등 여러 소스로부터 수집되었으며, 내재적 태그(28개)와 상황적 태그(23개)를 포함한다.

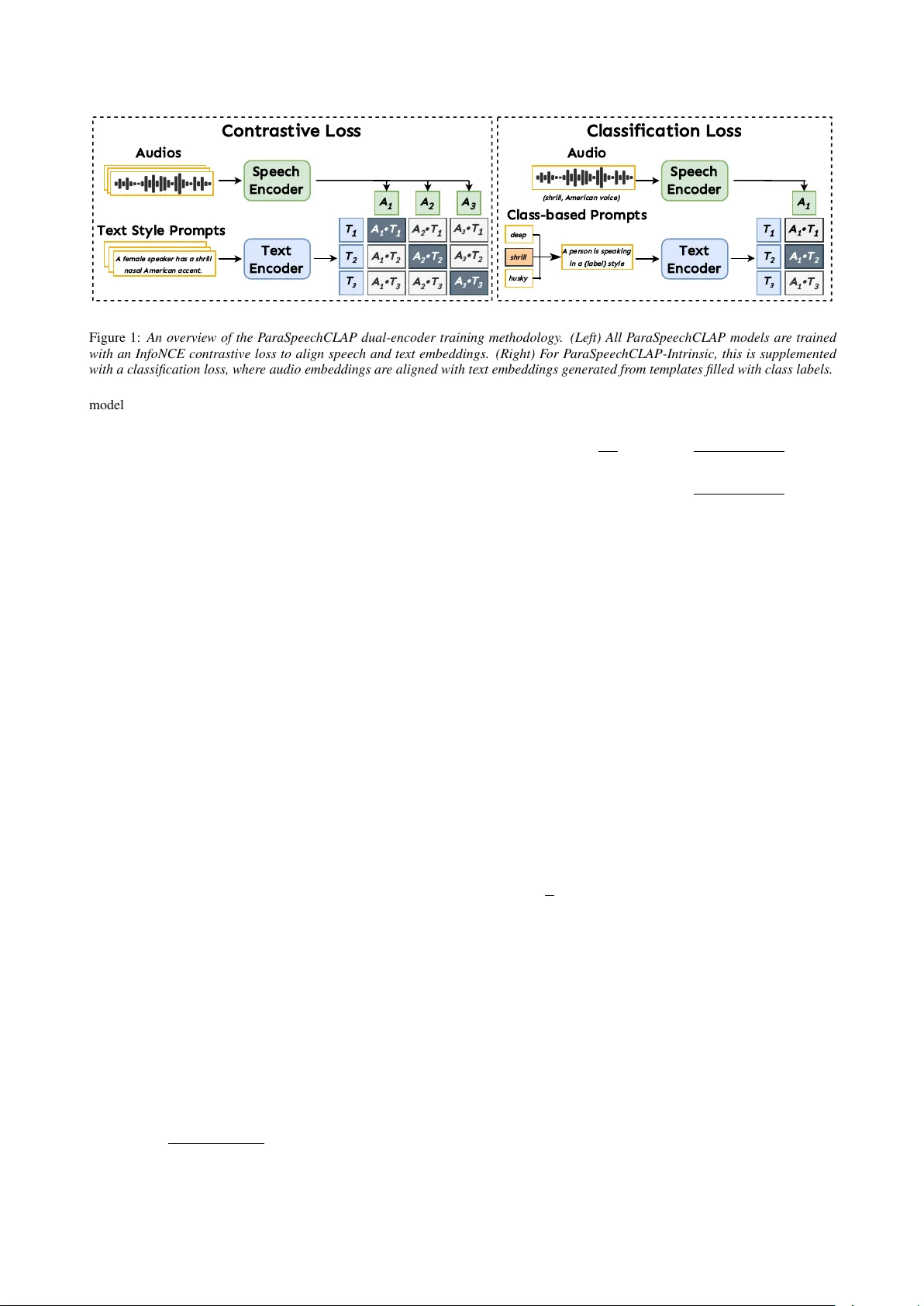

모델 아키텍처는 CLAP(Contrastive Language‑Audio Pretraining)에서 영감을 받아, 음성 인코더와 텍스트 인코더가 각각 트랜스포머 기반 백본을 사용한다. 음성 인코더는 317 M 파라미터의 WavLM‑Large를, 텍스트 인코더는 278 M 파라미터의 Granite‑Embedding‑Multilingual을 사용한다. 두 인코더는 각각 프로젝션 헤드를 거쳐 768 차원 임베딩으로 매핑된다. 학습 목표는 배치 내 모든 음성‑텍스트 쌍을 양방향 InfoNCE 손실로 정렬하는 대비학습이다.

특히 Intrinsic 모델에만 적용된 ‘클래스 기반 분류 손실’은 텍스트 인코더를 이용해 각 스타일 클래스에 대한 텍스트 임베딩을 사전에 생성하고, 음성 임베딩과의 내적을 통해 다중 라벨 BCE 손실을 계산한다. 이 방식은 별도의 분류 헤드를 두지 않으면서도 텍스트 인코더가 지속적으로 스타일 의미를 학습하도록 만든다. 또한 클래스 불균형을 완화하기 위해 희귀 태그를 오버샘플링하는 클래스‑밸런싱 전략을 적용하였다.

세 가지 모델을 훈련하였다. (1) ParaSpeechCLAP‑Intrinsic: 내재적 태그에 특화, 대비학습 + 분류 손실. (2) ParaSpeechCLAP‑Situational: 상황적 태그에 특화, 대비학습만. (3) ParaSpeechCLAP‑Combined: 두 데이터셋을 합쳐 통합 학습, 대비학습만. 모든 모델은 동일한 인코더 구조와 임베딩 차원을 공유한다.

평가에서는 세 가지 응용을 다루었다. 첫째, 스타일 캡션 검색에서는 Recall@1/10과 Median Rank를 사용했으며, ParaSpeechCLAP 모델들은 Random Projection, 기존 ParaCLAP, ParaCLAP‑PSC 등 모든 베이스라인을 크게 앞섰다. Intrinsic와 Situational 각각에 특화된 모델이 해당 도메인에서 최고 성능을 보였으며, Combined 모델은 두 도메인이 혼합된 평가에서 가장 높은 점수를 기록했다. 둘째, 속성 분류에서는 Unweighted Average Recall과 Macro F1을 측정했으며, Intrinsic 모델은 특히 UAR에서 기존 VoxProfile‑Voice Quality 분류기보다 우수했지만, F1에서는 약간 뒤처졌다. 이는 모델이 빈번한 태그를 과다 예측하는 경향을 시사한다. 셋째, TTS 스타일 가이드 실험에서는 사전 학습된 스타일‑프롬프트 TTS 모델에서 10개의 후보 음성을 생성한 뒤, ParaSpeechCLAP 임베딩 유사도로 최고 점수를 선택하는 ‘best‑of‑N’ 방식을 적용했다. 결과적으로 CMOS와 NMOS 점수가 상승하고, 상황·내재 태그 회수율이 개선되었으며, WER은 크게 변동하지 않았다. 이는 사후 보정 방식으로서 별도 파인튜닝 없이도 스타일 일관성을 높일 수 있음을 보여준다.

본 연구의 주요 기여는 다음과 같다. (1) 풍부한 스타일 레이블을 자연어 캡션과 연계한 대규모 데이터 구축, (2) 대비학습과 클래스 기반 분류 손실을 결합한 멀티태스크 학습 설계, (3) 특화 모델과 통합 모델 간의 상보적 성능 분석, (4) TTS 시스템에 대한 실시간 보상 모델 적용. 특히 텍스트 인코더를 직접 활용한 클래스 임베딩 방식은 향후 다른 멀티모달 정렬 작업에서도 확장 가능성이 높다. 한계점으로는 현재 768 차원 고정 임베딩이 초고해상도 억양 변동을 충분히 포착하지 못할 수 있다는 점과, 대규모 모델 파라미터로 인한 학습·추론 비용이 있다. 향후 연구에서는 더 큰 차원의 임베딩, 멀티헤드 교차 정렬, 스트리밍 환경에서의 효율성 검증, 그리고 인간 평가를 통한 스타일 캡션 품질 향상 방안을 탐색할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기