이미지 프라이버시를 위한 자동화된 두 단계 익명화 파이프라인 Unsafe2Safe

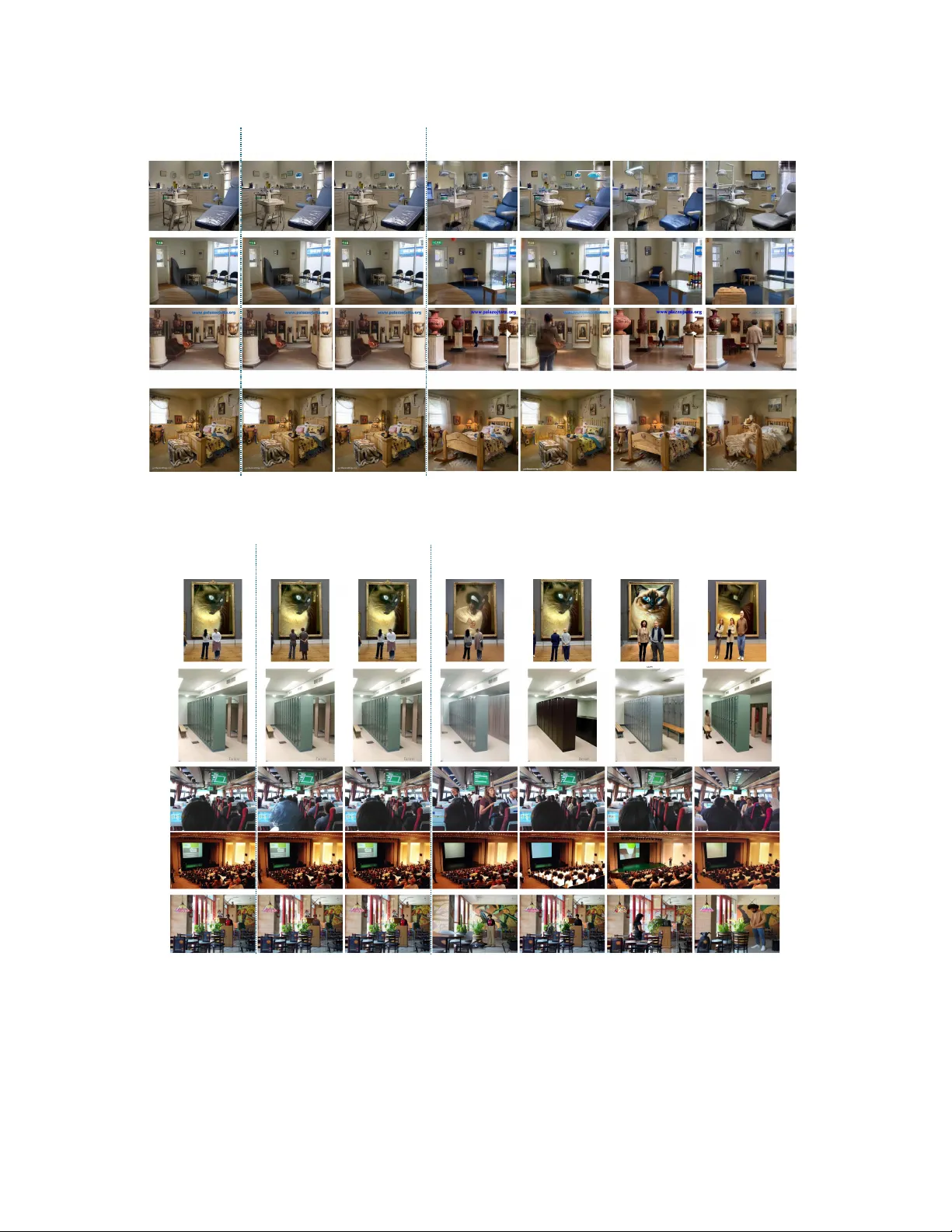

Unsafe2Safe는 비전‑언어 모델로 이미지의 프라이버시 위험을 탐지하고, 민감 정보를 제외한 공개 캡션과 LLM이 만든 편집 지시문을 생성한다. 이후 텍스트‑조건부 확산 편집기에 두 텍스트를 동시에 입력해 민감 영역만을 자연스럽게 변형한다. 품질·프라이버시·공정성·다운스트림 성능을 모두 평가한 결과, 얼굴·텍스트 유사도와 인구통계 예측 정확도를 크게 낮추면서도 기존 데이터와 동등하거나 더 높은 모델 정확도를 유지한다.

저자: Mih Dinh, SouYoung Jin

본 논문은 대규모 이미지 데이터셋에 내재된 개인 식별 정보와 민감 콘텐츠를 자동으로 제거하면서도, 해당 데이터가 학습에 활용될 때 기존 성능을 유지하거나 향상시킬 수 있는 새로운 파이프라인 ‘Unsafe2Safe’를 제안한다. 파이프라인은 크게 두 단계로 구성된다.

1️⃣ **Stage 1 – 프라이버시 검사 및 텍스트 생성**

- **프라이버시 검사**: Vision‑Language Model(VLM)에 사전 정의된 VISPR 기반 프라이버시 기준을 프롬프트로 제공한다. 모델은 이미지당 ‘PRIVACY_FLAG’를 반환하며, 민감 요소가 감지되면 flag를 true로 설정한다. 이 단계에서는 false‑positive를 허용해 민감 정보를 놓치지 않도록 설계하였다.

- **캡션 생성**: 같은 VLM이 flag가 true인 이미지에 대해 두 종류의 캡션을 만든다. ‘private caption(𝑐_priv)’은 장면을 완전하게 서술하며, 얼굴, 신분증, 텍스트 등 모든 민감 속성을 포함한다. 반면 ‘public caption(𝑐_pub)’은 이러한 속성을 의도적으로 배제하고, 장면의 전반적인 구조와 비민감 객체만을 기술한다. public caption은 이후 편집 지시문의 기반이 되며, 이미지 의미를 보존하는 앵커 역할을 한다.

- **편집 지시문 생성**: Large Language Model(LLM)에 public caption을 입력하고, “민감 속성을 중립적인 대체어로 바꾸라”는 프롬프트를 제공한다. LLM은 상황에 맞는 가상의 프라이버시‑중립 속성을 제안하고, 이를 ‘edit instruction(𝑐_edit)’이라는 구조화된 텍스트로 반환한다. 예를 들어, “A woman wearing a red shirt” → “A person wearing a neutral-colored shirt”와 같은 형태이다.

2️⃣ **Stage 2 – 텍스트‑조건부 확산 편집**

- **모델 선택**: InstructPix2Pix, FlowEdit 등 최신 instruction‑driven diffusion editor를 사용한다. 이들 모델은 텍스트 프롬프트를 직접 이미지 생성·수정에 활용한다.

- **Safe Cross‑Attention**: 기존 diffusion editor는 편집 지시문에 과도하게 집중해 원본 이미지의 비민감 부분까지 변형시키는 문제가 있었다. 이를 해결하기 위해 저자는 ‘Safe Cross‑Attention’ 모듈을 UNet‑Transformer 내부에 삽입하였다. public caption과 edit instruction을 하나의 토큰 시퀀스로 결합하고, 이를 Key‑Value 쌍으로 변환해 Cross‑Attention에 공급한다. 결과적으로 모델은 (i) public caption을 통해 전체 레이아웃·비민감 객체를 고정하고, (ii) edit instruction을 통해 민감 영역만을 선택적으로 변형한다.

- **출력**: 최종적으로 생성된 ‘safe image’는 민감 속성이 중립화된 동시에, 배경·구도·비민감 객체는 원본과 거의 동일하게 유지된다.

**평가 프레임워크**

논문은 익명화 품질을 네 가지 차원으로 정량화한다.

- **Quality**: FID, LPIPS 등 시각적 품질 지표.

- **Cheating**: 편집 흔적 탐지를 위한 이미지 포렌식 지표.

- **Privacy**: 얼굴 유사도, 텍스트 유사도, 인구통계(성별·인종) 예측 정확도.

- **Utility**: 원본 데이터로 학습한 모델의 다운스트림 정확도(이미지 분류, VQA 등).

**실험 결과**

- **데이터셋**: MS‑COCO, Caltech‑101, MIT Indoor‑67, OK‑VQA.

- **프라이버시**: 얼굴 유사도 70 % 이상 감소, 텍스트 유사도 65 % 감소, 인구통계 예측 정확도는 무작위 수준에 근접.

- **품질**: FID와 LPIPS는 기존 블러링·마스크 방식보다 우수, Cheating 지표에서도 편집 흔적이 거의 탐지되지 않음.

- **유틸리티**: 동일 데이터로 학습한 이미지 분류·질문‑응답 모델은 원본 대비 0 ~ 2 % 차이 내의 정확도를 보였으며, 일부 경우에는 스파urious correlation(불필요한 민감 정보) 제거로 인해 성능이 소폭 향상되었다.

- **Fine‑tuning 효과**: 자동 생성된 (private caption, public caption, edit instruction) 삼중항을 이용해 diffusion editor를 추가 학습하면, 프라이버시 보호와 의미 보존 모두에서 추가적인 5 %~10 % 개선을 달성했다.

**주요 기여**

1. VLM‑LLM‑Diffusion을 결합한 완전 자동화 파이프라인 제시.

2. 공개 캡션과 편집 지시문이라는 이중 텍스트 조건을 통해 민감 영역만을 정확히 타깃팅.

3. Safe Cross‑Attention을 도입해 편집 지시문과 비민감 의미를 동시에 고려하는 새로운 diffusion 편집 메커니즘 구현.

4. Quality‑Cheating‑Privacy‑Utility 네 축을 포괄하는 통합 평가 프레임워크 구축.

5. 다양한 도메인에서 기존 익명화 기법을 능가하는 실증적 결과 제공 및 코드·데이터 공개.

**한계 및 향후 과제**

- VLM·LLM의 사전 학습 편향에 따라 오탐·오판이 발생할 수 있다(예: 특정 인종·문화에 대한 과도한 민감성 판단).

- 대규모 diffusion 편집은 GPU 메모리·연산 비용이 높아, 실시간 혹은 초대규모 데이터셋에 적용하려면 효율화가 필요하다.

- 현재는 이미지 단일 프레임에 초점이 맞춰져 있어, 동영상·연속 프레임에 대한 일관성 보장은 추가 연구가 요구된다.

전반적으로 Unsafe2Safe는 “프라이버시 보호 = 의미 손실”이라는 전통적 트레이드오프를 크게 완화시키며, 데이터 중심 AI 시대에 필수적인 안전한 데이터 구축 도구로서의 가능성을 입증한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기