프랙탈 보간을 이용한 다중 스케일 KAN

본 논문은 기존 KAN이 사용하는 B‑스플라인 기반이 비정상(비‑스무스) 함수에 비효율적이라는 점을 지적하고, IFS(Iterated Function System) 이론에서 유도된 프랙탈 보간 함수(FIF)를 학습 가능한 기반으로 도입한 FI‑KAN을 제안한다. Pure FI‑KAN은 B‑스플라인을 완전히 대체하고, Hybrid FI‑KAN은 B‑스플라인 경로에 프랙탈 보정항을 추가한다. 수직 수축 파라미터 d를 통해 각 엣지의 프랙탈 차원을 …

저자: Gnankan L, ry Regis N'guessan

본 논문은 Kolmogorov‑Arnold Networks(KAN)가 B‑스플라인을 고정 격자 위에 배치해 학습 가능한 일변량 함수를 구현함으로써, 스무스 함수 근사에 최적화된 구조를 제공하지만, 비‑스무스 혹은 프랙탈 특성을 가진 데이터에 대해서는 효율성이 떨어진다는 문제점을 지적한다. 이를 해결하기 위해 저자들은 IFS(Iterated Function System) 이론에서 유도된 프랙탈 보간 함수(FIF)를 학습 가능한 기반으로 도입한 FI‑KAN을 제안한다. FI‑KAN은 두 가지 변형으로 설계되었다.

1. **Pure FI‑KAN (Barnsley 프레임워크)**

- 기존 KAN의 B‑스플라인 경로를 완전히 프랙탈 보간 기반(φ_m(x; d))으로 교체한다.

- 각 구간 i에 대한 수직 수축 파라미터 d_i∈(-1,1)를 학습함으로써, 엣지 함수의 프랙탈 차원(dim B)을 연속적으로 조절한다.

- d_i=0이면 φ_m은 전통적인 hat 함수가 되며, d_i가 커질수록 그래프는 자기유사 구조를 띠어 dim B>1이 된다.

- 이 구조는 프랙탈 차원 정규화(L1 penalty on |d_i|)를 통해 불필요한 복잡도를 억제하고, 학습된 d_i 값이 목표 함수의 실제 프랙탈 차원과 높은 상관관계를 보인다.

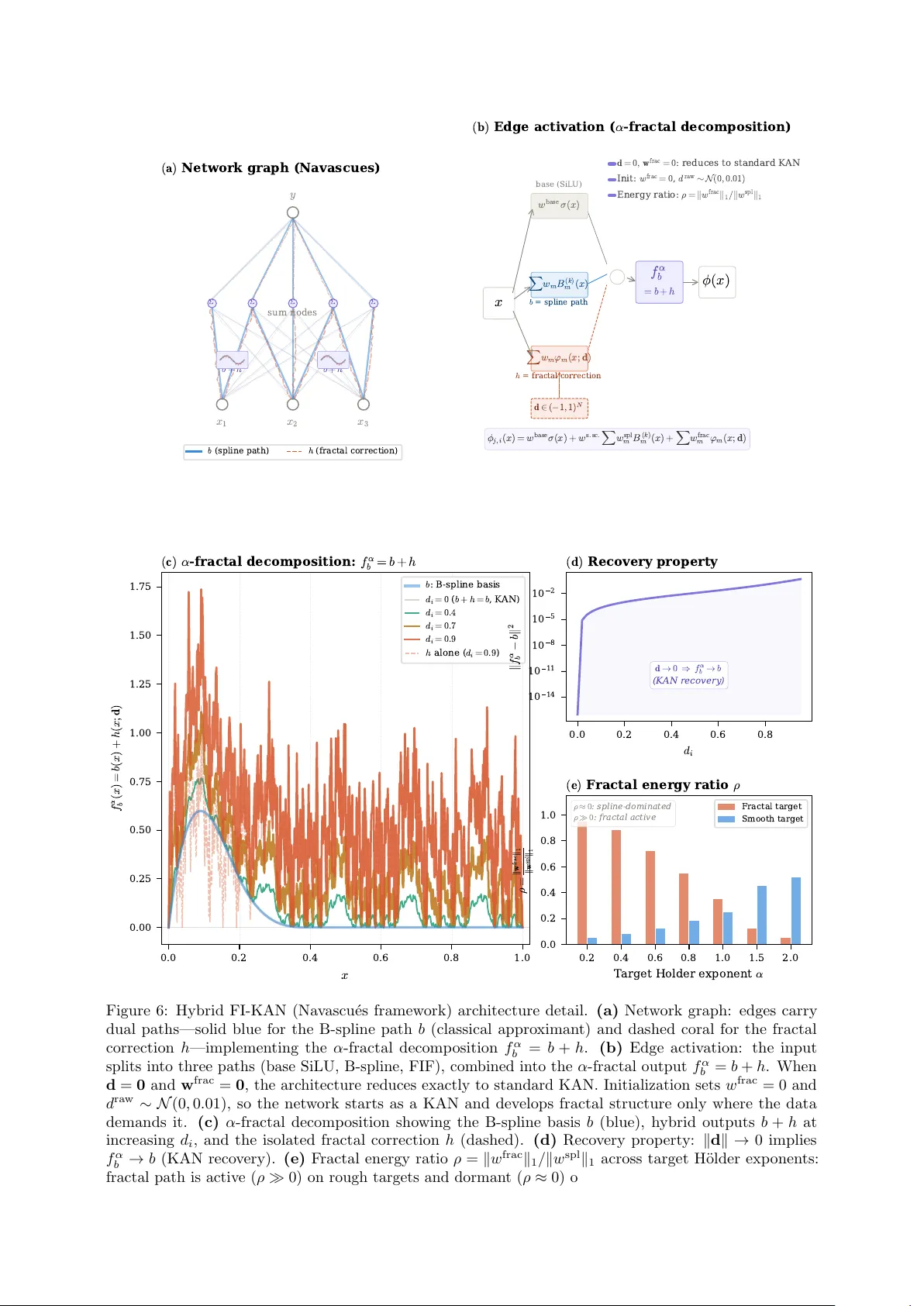

2. **Hybrid FI‑KAN (Navascués 프레임워크)**

- 기존 B‑스플라인 경로를 유지하면서, 프랙탈 보정항 h를 추가한다.

- α‑프랙탈 연산자를 이용해 f_αb = b + h 형태로 표현되며, 여기서 b는 스플라인 기반의 “베이스” 함수, h는 프랙탈 잔차이다.

- α_i=0이면 h가 사라져 순수 KAN과 동일해지고, α_i를 학습함으로써 h가 목표 함수의 비‑스무스 성분을 정확히 포착한다.

- 이 설계는 스무스와 비‑스무스 두 영역을 동시에 커버할 수 있어, 실험 전반에 걸쳐 가장 일관된 성능 향상을 제공한다.

**수학적 배경**

- KAN은 Kolmogorov‑Arnold 정리를 기반으로, 각 엣지를 B‑스플라인 전개 형태 ϕ(x)=w_base·σ(x)+w_scale·G+∑w_spline·B_k,m(x) 로 구현한다. B‑스플라인은 C^{k‑2} 연속성을 갖고, 차수 k‑1 다항식을 정확히 재현한다.

- 프랙탈 보간 함수는 IFS {w_i}를 정의하고, 수직 수축 파라미터 d_i를 통해 고정점 함수 f*를 얻는다. 이때 f*는 Read‑Bajraktarević(RB) 방정식 f*(L_i(x)) = c_i x + d_i f*(x) + f_i 를 만족한다. c_i=0으로 단순화하면 f*(L_i(x)) = d_i f*(x) + f_i 가 되며, 이는 선형적으로 y_i에 의존한다.

- 프랙탈 차원은 dim B = 1 + log(∑|d_i|)/log N 으로 표현되며, d_i가 0이면 dim B=1(선형), d_i가 1에 가까워질수록 차원이 증가한다.

**알고리즘**

- 프랙탈 기반 함수를 효율적으로 계산하기 위해 재귀 깊이 K까지 RB 연산을 트렁케이션한다. 트렁케이션 오차는 O(d_max^K) 로 지수적으로 감소한다.

- 수직 수축 파라미터는 tanh 재파라미터화(d_i = d_max·tanh(d_raw_i))를 통해 무제한 실수 공간에서 최적화한다.

- 자동 미분이 가능한 형태로 구현되어 PyTorch와 같은 딥러닝 프레임워크에 쉽게 통합된다.

**실험**

1. **Hölder 정규성 벤치마크**

- α∈

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기