비용 매칭 기반 모델 예측 제어로 효율적인 인간형 로봇 강화학습 구현

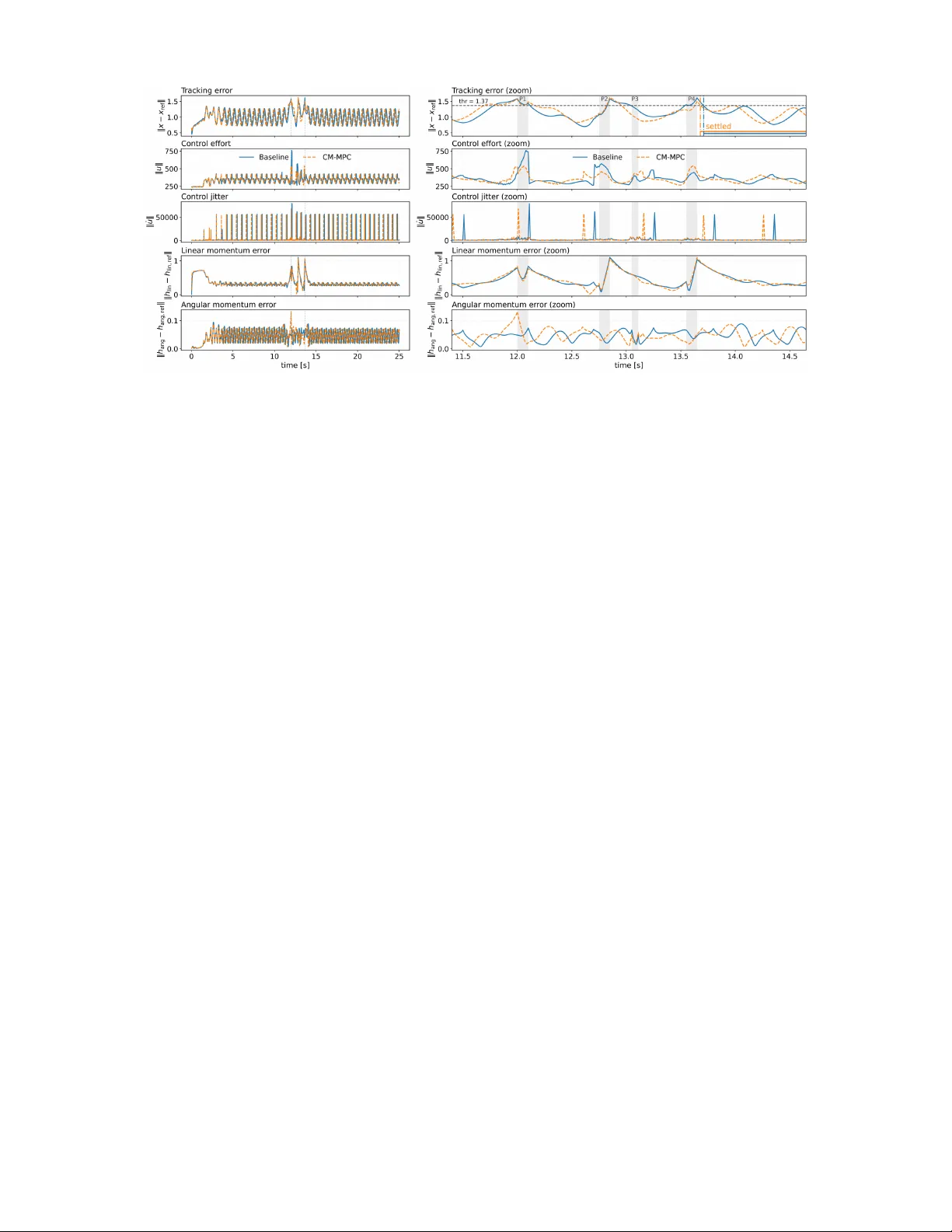

본 논문은 인간형 로봇의 보행 제어를 위해, 파라미터화된 모델 예측 제어(MPC)를 행동‑가치 함수 근사기로 활용하고, 실제 실행 데이터에서 얻은 장기 반환값과 MPC가 예측하는 비용‑투‑고를 최소화하는 비용‑매칭 학습 프레임워크를 제안한다. 반복적인 MPC 최적화 없이 롤아웃 기반으로 그래디언트를 계산함으로써 학습 효율을 크게 높였으며, 시뮬레이션 실험에서 기존 수동 튜닝 대비 향상된 보행 성능과 외란·모델 불일치에 대한 강인성을 보였다.

저자: Wenqi Cai, Kyriakos G. Vamvoudakis, Sébastien Gros

**1. 연구 배경 및 동기**

인간형 로봇의 보행 제어는 간헐적인 접촉, 높은 자유도, 엄격한 안전 제약 등 복합적인 어려움을 안고 있다. 모델 예측 제어(MPC)는 목표와 제약을 명시적으로 최적화할 수 있어 보행 제어에 널리 사용되지만, 실시간성을 확보하기 위해 종종 저차원 모델이나 단순화된 비용을 사용한다. 이 경우 실제 로봇에서 발생하는 관성 결합, 접촉 실현, 구동기 비선형성 등을 놓치게 되어 성능 저하와 전문가에 의존한 비용 가중치 튜닝이 필요해진다. 반면 강화학습(RL)은 데이터 기반으로 복잡한 동작을 학습할 수 있지만, 샘플 효율성이 낮고 물리적 제약을 직접 보장하기 어렵다. 따라서 두 접근법의 장점을 결합하면서 단점을 보완하는 방법이 요구된다.

**2. 문제 정의 및 시스템 모델**

논문은 인간형 로봇의 중심동역학(centroidal dynamics)을 기반으로 상태 x ∈ ℝ^{12+n_j}와 입력 u ∈ ℝ^{12+n_j}를 정의한다. 여기서 x는 선형·각운동량과 관절 구성을 포함하고, u는 양발 접촉력·모멘트와 관절 속도를 포함한다. 동역학 방정식(1a‑1c)은 질량 M, 중력 g, 접촉점 r_{c,i} 등을 고려한다. 제약은 관절 한계, 발 충돌 방지, 마찰 원뿔, 지면 압력(COP) 등으로 구성되며, 스탠스·스윙 단계별로 속도·힘 제약이 추가된다.

**3. 최적 제어 문제(OCP) 설계**

예측 Horizon N 에 대해 비용 함수 J_MPC = T(x_N) + ∑_{i=0}^{N-1} L(x_i,u_i) 로 정의한다. 단계 비용 L은 트래킹(L_trac), 베이스 자세(L_base), 무게중심(L_com), 스윙 발(L_swin), 토크(L_torq) 등 다섯 가지 항목으로 구성되며, 각각 가중치 행렬 Q,R 등으로 조정된다. 터미널 비용 T는 최종 상태와 목표 상태와의 차이를 제곱 가중치 Q_f 로 penalize한다. 이 OCP는 제약을 만족하는 최적 입력 시퀀스를 제공하지만, 모델 불일치와 파라미터 설정 오류로 인해 실제 성능이 저하될 수 있다.

**4. 비용 매칭 기반 학습 프레임워크**

핵심 아이디어는 파라미터 θ (예측 모델 f_θ, 단계 비용 L_θ, 터미널 비용 T_θ)를 포함하는 유한‑시간 MPC를 행동‑가치 함수 Q_MPC^θ(s,a_{0:N-1}) 로 해석하는 것이다. 실제 로봇이 수행한 행동 시퀀스 a_{0:N-1} 를 그대로 사용해 f_θ 로 전방 롤아웃을 수행하고, 각 단계에서 L_θ와 제약 위반 페널티 ϕ(r_i) 를 누적한다. 여기서 r_i는 부등식·등식 제약 위반 정도를 나타내며,

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기