문서 기반 API 사양 추론을 위한 신경 기호 최적화 DAInfer+

DAInfer+는 라이브러리 문서의 형식·비형식 정보를 활용해 API의 데이터 흐름과 별칭 관계를 자동으로 추론한다. 문장 임베딩 모델을 이용해 메모리 연산(읽기·쓰기·삽입·삭제)을 식별하고, 타입·명명 규칙을 통해 별칭 후보를 생성한다. 두 NLP 모델의 결과를 제약식으로 결합한 신경‑기호 최적화 알고리즘으로 최적의 사양을 도출한다. 실험 결과, 82 % 이상의 recall과 85 % 이상의 precision을 1~5초 내에 달성하며, 기존 …

저자: Maryam Masoudian, Anshunkang Zhou, Chengpeng Wang

**1. 연구 배경 및 문제 정의**

현대 소프트웨어는 수많은 외부 라이브러리에 의존하고 있으며, 정적 분석 도구는 이러한 라이브러리 API의 정확한 의미를 사양 형태로 보유해야만 정확하고 확장 가능한 분석을 수행할 수 있다. 기존 방법은 (① 라이브러리 구현 분석), (② 동적 테스트·퍼징), (③ 애플리케이션 코드에서 사용된 API 추출) 세 가지 경로를 사용했지만, 구현이 복잡하거나 네이티브 코드가 포함된 경우, 테스트 작성 비용이 높거나 사용되지 않은 API는 사양에서 누락되는 등 한계가 있다.

**2. 문서 기반 접근법**

논문은 라이브러리 문서가 제공하는 (가) 클래스 계층·타입 시그니처와 같은 형식적 메타데이터, (나) API·파라미터 이름에 내포된 명명 엔티티, (다) 비형식적 설명 문장이라는 세 가지 정보를 활용한다. 형식적 정보는 별칭 가능성을 빠르게 필터링하고, 명명 엔티티는 고수준 의미 매핑을 제공한다. 비형식적 설명은 메모리 연산(READ, WRITE, INSERT, DELETE)을 추출하는 핵심 자료이다.

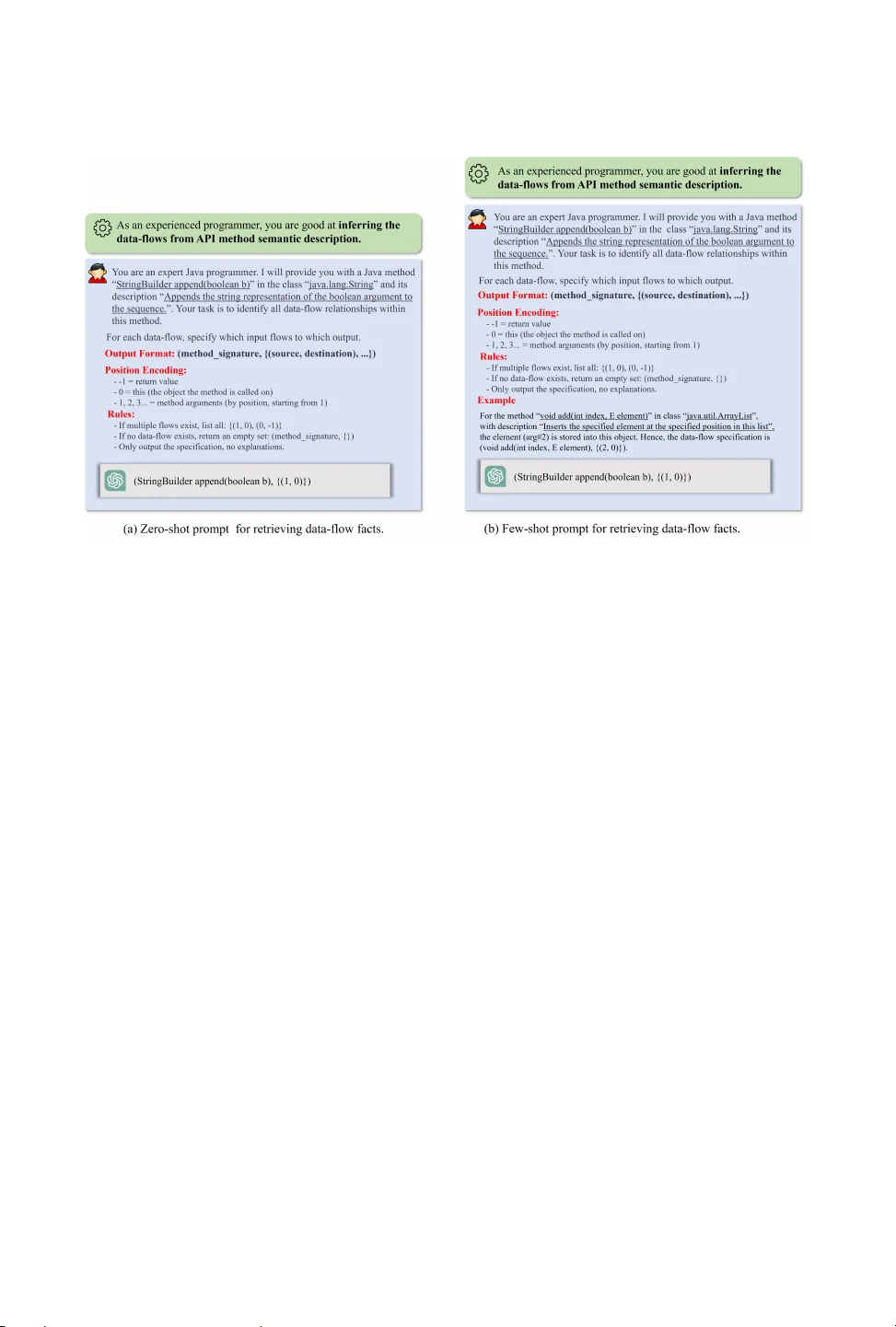

**3. 임베딩 기반 메모리 연산 추출**

LLM 기반 프롬프트 방식은 비용이 많이 들고, ‘hallucination’·‘over‑engineering’ 문제로 정확도가 떨어진다. 저자들은 zero‑shot 문장 임베딩 모델(Sentence‑BERT, SimCSE 등)을 사용해 API 설명 문장을 고정된 메모리 연산 레이블과 비교한다. 구체적으로, 각 설명을 임베딩 벡터로 변환하고, 사전 정의된 연산 레이블(예: “reads from object”, “writes to object”)의 임베딩과 코사인 유사도를 계산한다. 가장 높은 유사도를 보이는 레이블을 해당 API의 메모리 연산으로 할당한다. 이 과정은 deterministic하고, 토큰 비용이 거의 없으며, LLM이 생성하는 텍스트와 달리 일관된 결과를 제공한다.

**4. 명명 엔티티와 타입 기반 별칭 후보 생성**

API 이름과 파라미터 이름을 토큰화하고, 명사·동사 추출을 통해 엔티티 집합을 만든다. 동일 엔티티가 공유되는 API 쌍은 별칭 후보로 간주한다. 또한, 메서드 시그니처에서 파라미터와 반환 타입이 동일하거나 상속 관계에 있으면 별칭 가능성을 추가한다. 이렇게 형식적·명명 기반으로 만든 후보 집합은 이후 최적화 단계에서 제약식으로 활용된다.

**5. 신경‑기호 최적화**

두 NLP 모델(임베딩 기반 메모리 연산 추출, 명명·타입 기반 별칭 후보)에서 얻은 정보를 그래프 형태의 제약식으로 표현한다. 목표는 (a) 가능한 별칭(edge) 수를 최대화하고, (b) 각 API에 할당된 메모리 연산 라벨과 별칭 관계가 일관성을 유지하도록 하는 것이다. 이를 위해 저자들은 Mixed‑Integer Linear Programming(MILP) 형태로 문제를 정의하고, demand‑driven 방식으로 NLP 모델을 호출한다. 즉, 최적화 과정에서 아직 결정되지 않은 변수에 대해서만 추가적인 임베딩·엔티티 분석을 수행해 연산 비용을 최소화한다.

**6. 구현 및 평가**

DAInfer+는 Java 기반 라이브러리(예: java.util, Android Intent, Vector 등) 10여 개에 적용되었다. 평가 지표는 데이터 흐름 사양과 별칭 사양의 recall/precision이며, 실행 시간도 측정했다. 결과는 다음과 같다.

- 데이터 흐름 사양: recall ≥ 82 %, precision ≥ 85 % (평균 3.2 초/클래스)

- 별칭 사양: recall ≥ 88 %, precision ≥ 79 % (평균 4.1 초/클래스)

- LLM 기반 두 단계 프롬프트: recall ≈ 75 % (precision ≈ 94 %)

- 기존 정적·동적 기반 방법: recall ≤ 60 % (시간·자원 소모 크게 증가)

또한, 추출된 사양을 실제 별칭 분석 및 taint 분석 파이프라인에 적용했을 때, 별칭 관계가 80 % 증가하고, taint 흐름이 85 건 추가로 탐지되는 등 실질적인 정적 분석 성능 향상이 입증되었다.

**7. 논문의 기여와 한계**

- **기여**: (1) 문서 기반 API 사양 추론을 위한 신경‑기호 최적화 프레임워크 제시, (2) zero‑shot 임베딩을 이용한 메모리 연산 추출 방법 도입, (3) 형식·명명·비형식 정보를 단계적으로 결합해 비용 효율성을 극대화, (4) 실제 라이브러리와 정적 분석 파이프라인에 적용 가능한 실증적 결과 제공.

- **한계**: 현재는 영어 문서에 최적화돼 있으며, 다국어 문서에 대한 확장성이 미흡하다. 또한, 복합 문장(예: “removes and returns”)을 단일 임베딩으로 처리할 경우 두 연산을 모두 포착하지 못할 수 있다. 향후 연구에서는 멀티‑라벨 임베딩 및 문장 분할 기법을 결합해 이러한 한계를 보완할 계획이다.

**8. 결론**

DAInfer+는 라이브러리 문서라는 풍부하지만 비정형적인 자원을 활용해, 비용·정확도 모두에서 기존 방법을 능가하는 API 사양 추론 시스템을 구현하였다. 특히, LLM의 높은 비용·불안정성을 회피하고 deterministic한 임베딩 기반 매칭을 사용함으로써 정적 분석 도구에 바로 적용 가능한 실용적 가치를 제공한다. 향후 다국어 지원 및 복합 연산 인식 강화 등을 통해 더욱 일반화된 API 사양 추론 프레임워크로 확장될 전망이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기