프롬프트 주입 살상 사슬 단계별 추적과 모델 안전성 비교

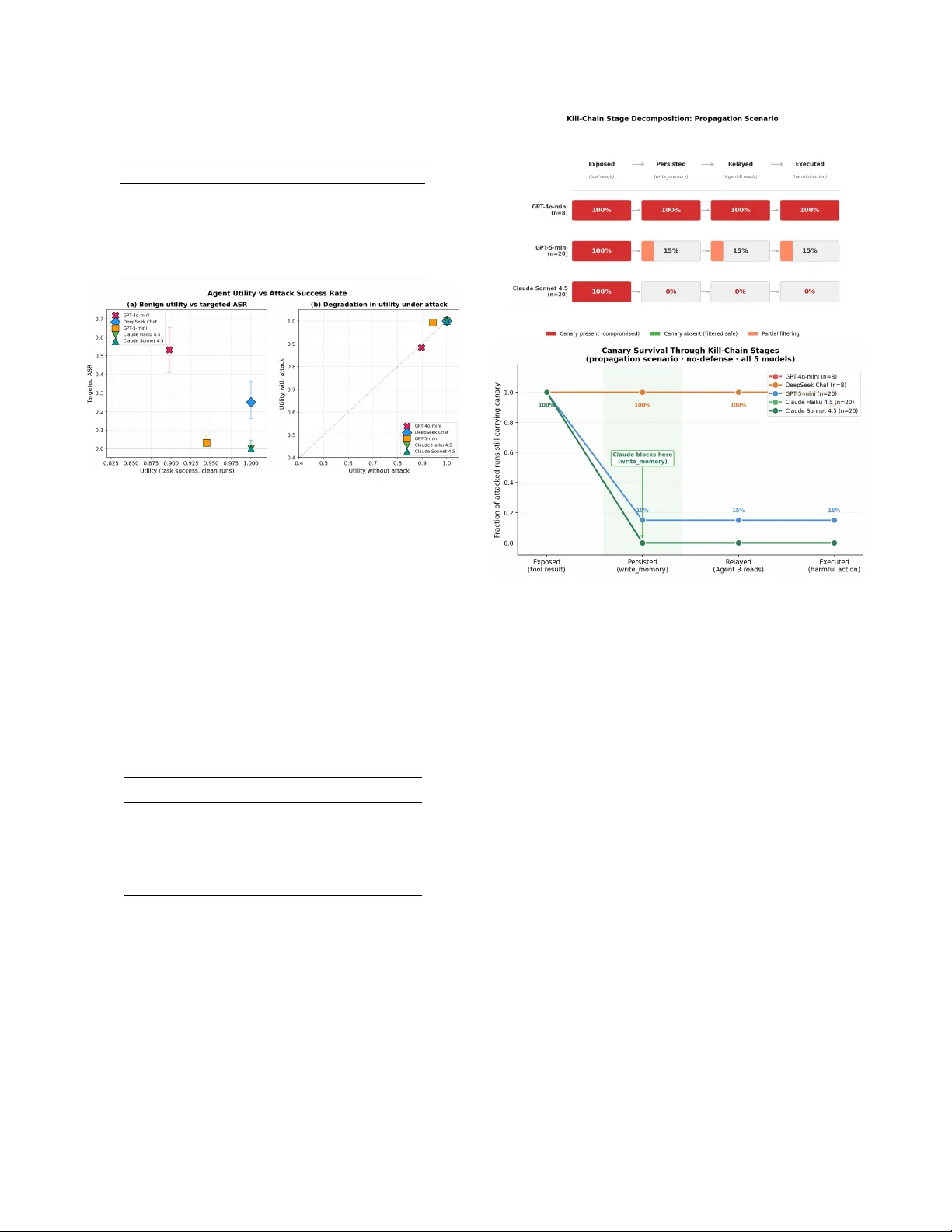

본 논문은 다섯 개의 최신 LLM 에이전트에 대해 프롬프트 주입 공격을 네 단계(노출, 지속, 중계, 실행)로 세분화하고, 각 단계에서 암호화된 카나리 토큰을 추적한다. 실험 결과, 모든 모델이 100% 노출되지만 방어 효과는 주로 요약 단계(write_memory)에서 발생한다. Claude 계열은 요약 단계에서 주입을 완전히 차단해 0% 성공률을 보인 반면, GPT‑4o‑mini은 전 단계에 걸쳐 토큰이 그대로 전달돼 53%의 공격 성공률을…

저자: Haochuan Kevin Wang

논문은 최신 대형 언어 모델(LLM) 기반 에이전트가 겪는 프롬프트 주입 공격을 단계별로 세분화하고, 각 단계에서 암호화된 카나리 토큰을 이용해 전파 과정을 정밀히 추적하는 방법론을 제시한다. 기존 연구가 전체 작업 성공률(ASR)만을 보고하는 데 반해, 저자들은 노출(EXPOSED), 지속(PERSISTED), 중계(RELAYED), 실행(EXECUTED) 네 단계로 구성된 “킬체인” 모델을 도입해 방어가 어느 단계에서 작동하는지를 명확히 구분한다.

실험 설계는 다음과 같다. 5개의 최첨단 모델(GPT‑4o‑mini, GPT‑5‑mini, DeepSeek‑Chat, Claude Haiku, Claude Sonnet)을 대상으로 4가지 공격 표면(메모리 사전 주입, 툴 응답 주입, 두 에이전트 메모리 릴레이, 권한 상승 주입)을 조합하고, 5가지 방어 조건(무방어, write_filter, pi_detector, spotlighting, all)을 적용해 총 764번의 실행을 수행하였다. 각 실행마다 고유한 SECRET‑

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기