구조 인식 강화학습 라벨프리 추론 토폴로지 보상

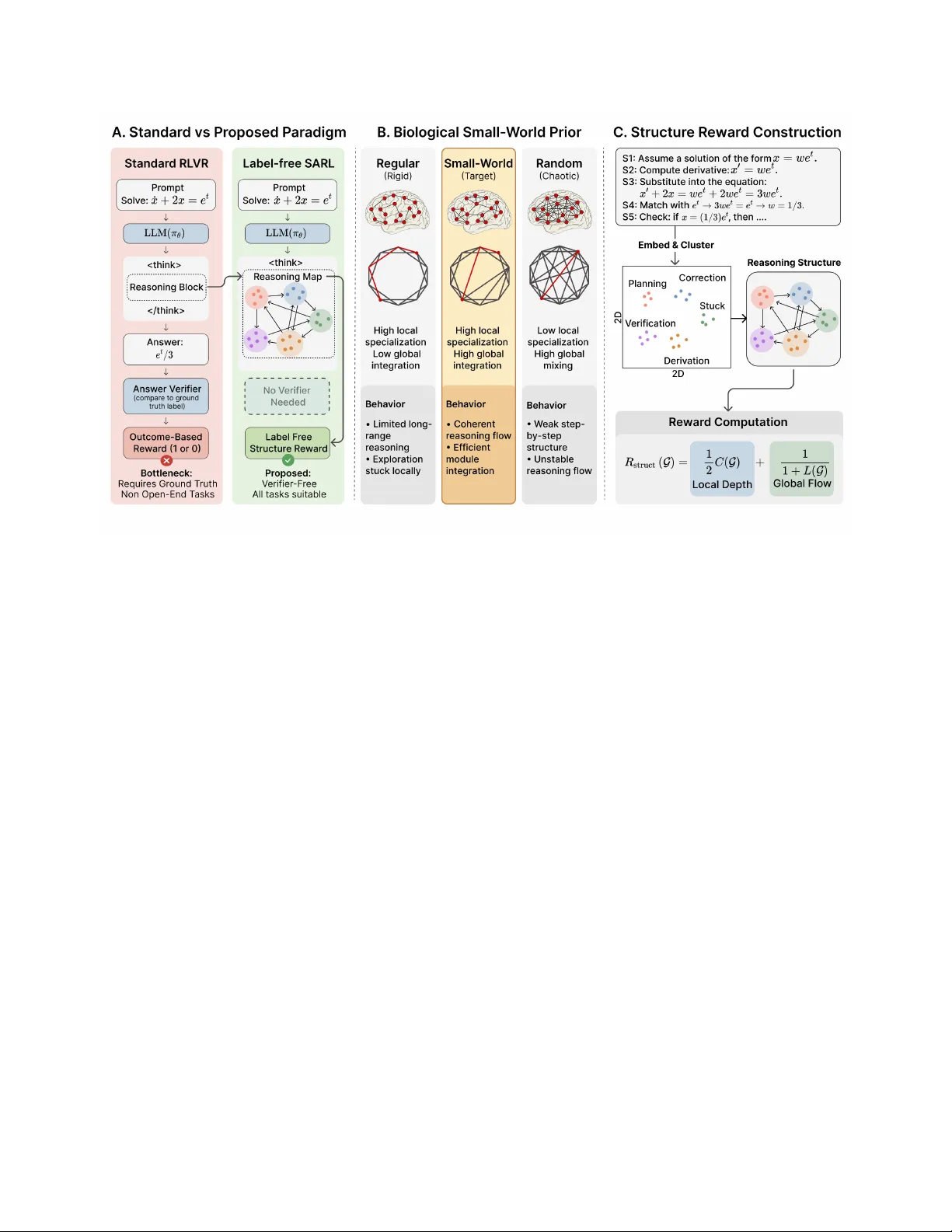

** SARL은 라벨이 없는 환경에서도 대형 추론 모델의 사고 과정을 개선하기 위해, 중간 사고 단계들을 그래프로 변환하고 그 그래프가 작은 세계(small‑world) 특성을 가질 때 보상을 주는 강화학습 프레임워크이다. 수학 문제와 개방형 추론 과제 모두에서 기존 라벨‑프리 방법과 검증 가능한 RL보다 높은 성능을 보이며, 정책의 KL 발산 감소와 엔트로피 증가를 통해 학습 안정성과 탐색성을 향상시킨다. **

저자: Yifan Wang, Bolian Li, David Cho

**

### 1. 서론

대형 추론 모델(LRM)은 체인‑오브‑쓰(Chain‑of‑Thought, CoT) 방식을 통해 복잡한 문제를 단계별로 풀어내는 능력을 보여왔다. 그러나 현재 대부분의 성능 향상은 검증 가능한 정답에 기반한 강화학습(RL‑VR)이나 대규모 라벨링된 데이터에 의존한다. 이런 접근법은 정답이 명확하지 않거나 자동 검증이 어려운 개방형 도메인(전략 기획, 철학적 논의 등)에서는 적용이 제한된다. 또한 기존 RL은 최종 정답에만 보상을 주어, 중간 사고 과정의 구조적 품질을 간과한다.

### 2. 관련 연구

- **뇌의 작은 세계 토폴로지**: 인간 뇌는 높은 지역 클러스터링과 짧은 전역 경로 길이를 동시에 갖는 작은 세계 네트워크 구조를 가지고 있다. 이는 효율적인 정보 통합과 전문화된 처리에 기여한다.

- **추론 그래프 분석**: 이전 연구들은 LRM의 숨겨진 상태 흐름을 그래프로 추출해, 사이클성, 지름, 작은 세계 지수 등이 성능과 상관관계가 있음을 보였다. 그러나 이들은 사후 분석에 머물렀다.

- **라벨‑프리 RL**: TTRL(다수결 기반), EMPO(엔트로피 최소화), Intuitor(RLIF) 등은 라벨 없이 보상을 생성하지만, 대부분 출력 형태나 모델 자체 불확실성에 의존한다.

### 3. SARL 프레임워크

#### 3.1 문제 정의

입력 x와 정책 πθ가 생성하는 사고 궤적 τ = (s₁,…,s_T, a) 에 대해, 기존 RL은 최종 정답 a와 정답 y*의 일치 여부를 보상으로 사용한다. SARL은 이를 대체해, τ 로부터 **Reasoning Map** G(τ) = (V, E)를 만든 뒤, 그래프의 작은 세계 특성을 측정한 **Structure Reward (SR)** 로 보상을 정의한다.

#### 3.2 Reasoning Map 구축

1. **단계 추출**: 블록을 줄바꿈 기준으로 분리해 단계 s_t 를 얻는다.

2. **임베딩**: 경량 텍스트 임베딩 모델 M을 사용해 각 단계를 정규화된 벡터 e_t 로 변환한다.

3. **클러스터링**: e_t 를 KMeans 혹은 HDBSCAN으로 클러스터링해 K개의 잠재 추론 유형 v₁…v_K 를 만든다. 같은 클러스터에 속한 단계는 동일 노드에 매핑된다.

4. **전이 엣지**: 연속된 단계가 서로 다른 클러스터에 속하면 무방향 엣지 (v_i, v_j)를 추가한다. 중복 전이는 하나의 엣지만 유지한다.

#### 3.3 구조 보상 정의

- **평균 클러스터링 계수 C(G)**: 지역적 응집성을 측정한다.

- **평균 최단 경로 길이 L(G)**: 전역적 효율성을 측정한다.

보상은 `SR(G) = 0.5 * C(G) + 1 / (1 + L(G))` 로 정의되어, 높은 C와 낮은 L을 동시에 달성하도록 유도한다. 이는 기존 작은 세계 지수와 달리 무한대가 되지 않으며, 보상 변동성을 줄인다.

#### 3.4 학습 절차

Algorithm 1에 따라 매 학습 단계마다 배치에서 질문을 샘플링하고, 각 질문에 대해 G개의 rollout을 생성한다. 각 rollout에 대해 Reasoning Map을 만들고 SR을 계산한 뒤, PPO 혹은 GRPO와 같은 정책 최적화 알고리즘에 보상-샘플 쌍을 전달한다.

### 4. 실험

#### 4.1 설정

- **모델**: Qwen‑3‑4B (CoT 지원)

- **데이터**: 검증 가능한 수학 문제(AIME 1983‑2024)와 라벨이 없는 OpenRubic‑v2(다양한 개방형 과제)

- **비교 대상**: EMPO, TTRL, DPO(선호 기반) 등 라벨‑프리 베이스라인, 그리고 기존 RL‑VR(ground‑truth 보상)

- **알고리즘**: PPO와 GRPO 두 가지 정책 최적화 기법

#### 4.2 결과

- **수학 영역**: PPO 기준 평균 정확도 9.1% 상승, GRPO 기준 11.6% 상승.

- **개방형 영역**: PPO 기준 34.6% 상승, GRPO 기준 30.4% 상승.

- **학습 안정성**: KL 발산이 기존 방법 대비 15~20% 감소, 정책 엔트로피가 10~12% 증가. 이는 SARL이 더 탐색적인 정책을 유지하면서도 급격한 파라미터 변동을 억제함을 의미한다.

#### 4.3 분석

- **클러스터링 민감도**: K값을 5~15 사이에서 조정했을 때 성능 차이가 미미했으며, HDBSCAN은 자동으로 클러스터 수를 결정해 라벨‑프리 환경에 유리했다.

- **임베딩 모델 영향**: 경량 Sentence‑Transformer 기반 임베딩이 충분히 의미론적 구분을 제공했으며, 대형 언어 모델 자체 임베딩을 사용해도 비슷한 결과를 얻었다.

- **보상 구성**: C와 L을 동일 가중치(0.5)로 결합했을 때 가장 안정적인 학습 곡선을 보였으며, C에 과도한 가중치를 주면 과도한 지역 집중 현상이 나타났다.

### 5. 논의 및 한계

- **구조 보상의 일반화**: 작은 세계 토폴로지는 인간 인지에 영감을 받았지만, 모든 추론 과제에 최적이라고 단정할 수는 없다. 복잡한 논증이나 비선형 사고 흐름에서는 다른 그래프 특성이 더 유리할 수 있다.

- **계산 비용**: 매 rollout마다 임베딩·클러스터링·그래프 계산을 수행해야 하므로, 대규모 배치 학습 시 추가 연산 비용이 발생한다. 저자는 경량 임베딩과 배치 수준 캐싱을 통해 이를 완화했지만, 실시간 서비스 적용에는 여전히 과제가 남는다.

- **노드 정의의 주관성**: 클러스터링 기준에 따라 동일한 사고 단계가 다른 노드에 할당될 수 있어, 보상의 일관성이 떨어질 위험이 있다. 향후 메타‑학습 기반 클러스터링 혹은 인간 피드백을 활용한 노드 정제 방법이 필요하다.

### 6. 결론

SARL은 라벨이 없는 상황에서도 ‘생각하는 방식’ 자체를 보상함으로써 대형 추론 모델의 성능을 크게 향상시킨다. 작은 세계 토폴로지를 활용한 구조 보상은 지역적 응집과 전역적 효율성을 동시에 촉진해, 기존 라벨‑프리 RL 방법보다 높은 정확도와 더 안정적인 학습을 달성한다. 향후 연구는 보상 함수를 다변화하고, 클러스터링 자동화 및 멀티모달 임베딩을 결합해 다양한 도메인에 적용하는 방향으로 진행될 것이다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기