대규모 시각언어 모델 효율적 추론 기술 총정리

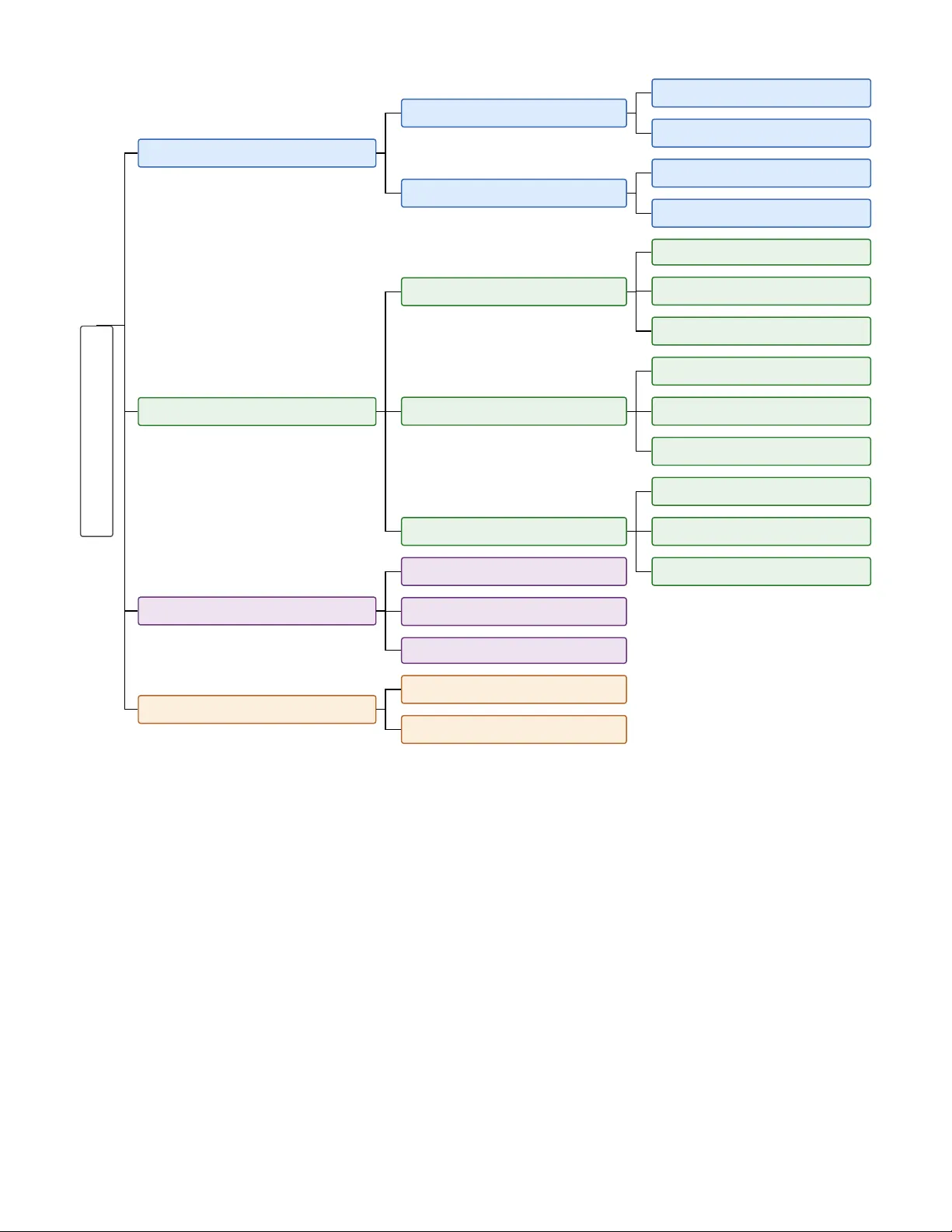

본 논문은 대규모 시각언어 모델(LVLM)의 추론 비용을 낮추기 위한 최신 최적화 기법들을 체계적으로 조사한다. 시각 토큰 압축, 메모리·서빙 관리, 효율적 아키텍처 설계, 고급 디코딩 전략 네 가지 축으로 분류하고, 각 방법의 원리와 한계를 분석한다. 또한 향후 연구 과제로 남은 문제들을 제시한다.

저자: Surendra Pathak

본 논문은 대규모 시각언어 모델(LVLM)의 추론 효율성을 높이기 위한 최신 연구들을 포괄적으로 정리한다. 서론에서는 LVLM이 이미지·비디오와 텍스트를 결합해 뛰어난 멀티모달 추론 능력을 보이지만, 고해상도 입력으로 인한 시각 토큰 수가 급증하고, 어텐션 연산의 O(N²) 복잡도와 KV‑Cache 메모리 증가가 실시간 서비스와 대규모 배포를 저해한다는 문제를 제시한다. 이를 해결하기 위해 연구 커뮤니티는 네 가지 주요 차원으로 최적화 기법을 분류한다.

첫 번째 차원인 시각 토큰 압축은 이미지와 비디오 입력에서 중복·불필요한 토큰을 제거하거나 병합한다. 이미지 토큰 프루닝에서는 FastV가 어텐션 점수가 낮은 토큰을 일괄 삭제하고, SparseVLM·TRIM이 쿼리‑기반 중요도 평가를 도입해 작업 특이성을 반영한다. 다양성 기반 방법으로는 Divprune이 최대‑최소 거리 문제를 풀어 특징 간 거리를 최대화하고, CDPruner가 DPP를 이용해 조건부 다양성을 확보한다. 토큰 머징에서는 ToMe가 bipartite soft‑matching으로 유사 토큰을 결합하고, VisionZip·PuMer·ASAP 등이 프루닝과 머징을 혼합해 압축 효율을 높인다. 비디오 토큰 압축은 시공간 중복을 다루며, 초기에는 프레임‑단위 클러스터링(예: Chat-UniVi, LLaMA‑VID)으로 두 개 토큰만 남겼지만, 동적·다중‑그레인 전략(HoliTom·FastVID·DyCoke·Dynamic‑VLM·Multi‑Granular Spatio‑Temporal Merging)으로 복잡도에 따라 압축 비율을 조절한다. 또한 LongVU·FlexSelect·LangDC와 같이 사용자 질의와 텍스트 정보를 활용해 중요한 비디오 구간을 선택하는 교차‑모달 접근도 제시된다.

두 번째 차원인 메모리 관리와 서빙은 KV‑Cache의 급격한 성장에 대응한다. 알고리즘적 관리에서는 정적 선택(SnapKV·L2Compress)과 동적 선택(StreamingLLM·H2O)으로 중요한 토큰을 유지한다. 예산 할당 기법은 전체 메모리 사용량을 제한하면서 중요한 시각 토큰에 우선순위를 부여한다. KV‑Cache 병합 기법은 유사 토큰을 합쳐 메모리 사용량을 감소시킨다. 시스템‑레벨에서는 연속 배치, 프리필‑디코드 분리, 분산·시퀀스 병렬화, 이기종 스토리지 활용 등을 통해 GPU HBM 대역폭과 용량 한계를 완화한다.

세 번째 차원인 효율적 아키텍처 설계는 모델 구조 자체를 경량화한다. 교차‑모달 프로젝터와 리샘플러를 경량화해 토큰 수를 사전에 감소시키고, Sparse‑Mixture‑of‑Experts(MoE)와 하드웨어‑인식 어텐션(예: FlashAttention, Longformer‑style)으로 연산 복잡도를 낮춘다. 이러한 구조적 변형은 토큰 압축과 병행될 때 시너지 효과를 기대한다.

마지막 차원인 고급 디코딩 전략은 자동 회귀 생성 단계의 지연을 줄인다. 멀티모달 스펙큘러티브 디코딩은 작은 가벼운 모델이 후보 토큰을 미리 생성하고, 큰 LVLM이 이를 검증함으로써 토큰당 연산을 감소시킨다. Early‑Exit·Layer‑Skipping 기법은 특정 레이어에서 충분히 확신이 서면 디코딩을 중단한다. 이러한 전략은 전체 토큰 수를 줄이면서도 성능 저하를 최소화한다.

논문은 각 카테고리별 기존 연구들의 장점과 한계를 비판적으로 검토하고, 현재 기술이 아직 해결하지 못한 문제점—예를 들어, 압축 기준의 일반화, 동적 메모리 관리와 분산 서빙의 통합, 하드웨어‑특화 최적화와 모델 정확도 간의 트레이드오프—을 제시한다. 마지막으로, 표준화된 벤치마크, 멀티모달 프루닝·머징의 공동 최적화, 실시간 서비스 환경을 고려한 end‑to‑end 파이프라인 설계 등을 향후 연구 과제로 제안한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기